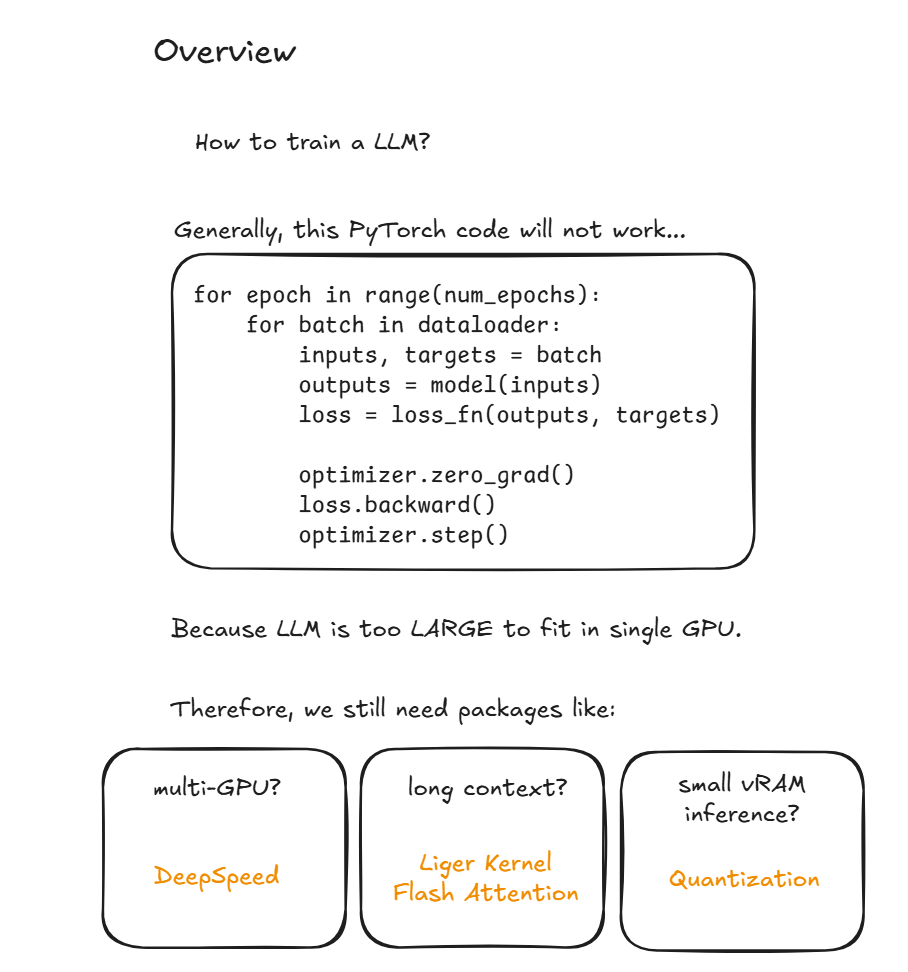

在只有单张GPU的条件下训练语言模型(如GPT、BERT等),虽然资源受限,但仍然是可行的。下面是一些实用的策略和方法,可以最大化利用单卡资源:

✅ 1. 选择合适规模的模型

- 从小模型开始:比如 GPT-2 small(117M)、DistilBERT 等。

- 定制模型规模:用 Hugging Face 的

transformers自定义层数、隐藏层大小、注意力头数等,减少参数数量。

from transformers import GPT2Config, GPT2LMHeadModel

config = GPT2Config(

n_layer=6,

n_head=6,

n_embd=384,

vocab_size=50257

)

model = GPT2LMHeadModel(config)

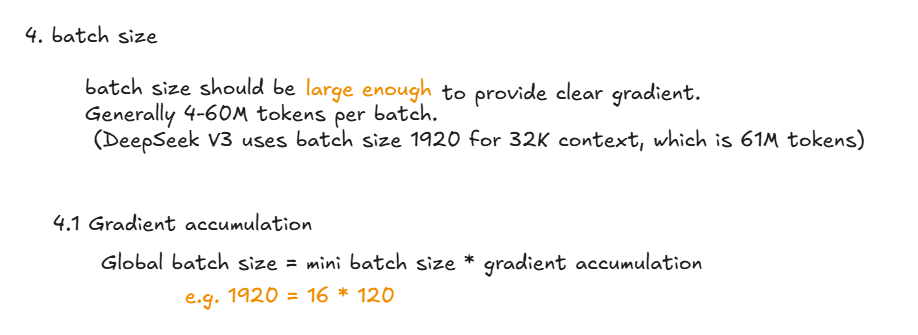

✅ 2. 减小 batch size

- 将

batch_size调小,如设置为1或2,避免 GPU OOM(out-of-memory)。 - 搭配 梯度累积(gradient accumulation) 实现大 batch 效果:

gradient_accumulation_steps = 8 # 相当于把 batch size 扩大 8 倍

✅ 3. 混合精度训练(FP16)

- 使用

torch.cuda.amp或transformers中的Trainer支持:

from torch.cuda.amp import autocast, GradScaler

scaler = GradScaler()

with autocast():

output = model(input_ids)

- 或使用

Trainer:

from transformers import Trainer, TrainingArguments

training_args = TrainingArguments(

fp16=True,

...

)

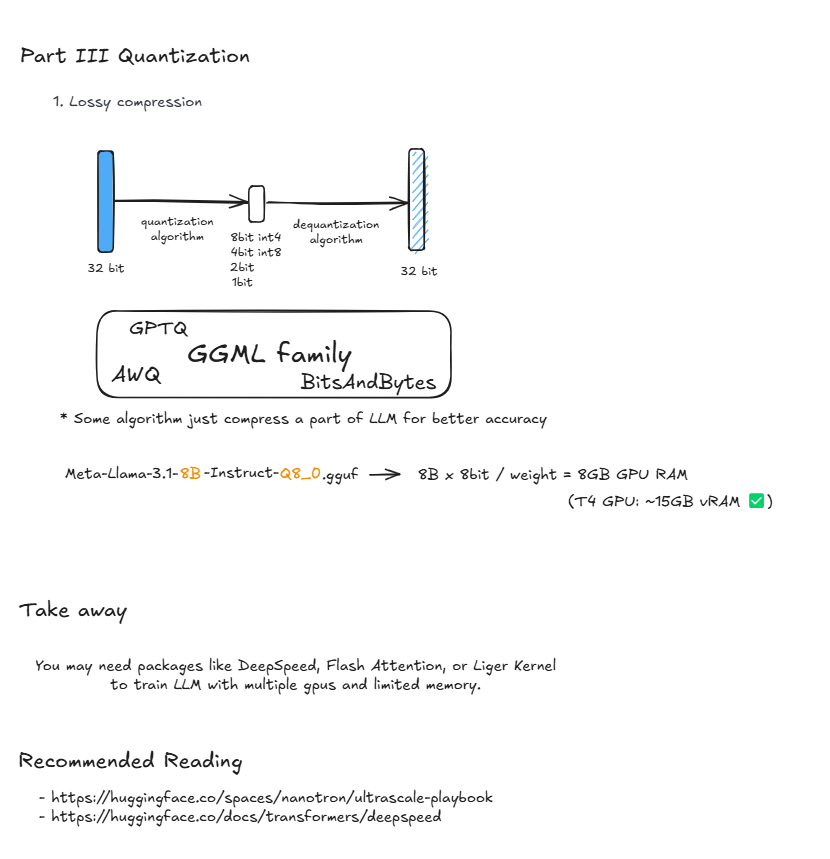

✅ 4. 模型裁剪与量化

- 使用 Hugging Face

bitsandbytes进行 8-bit 或 4-bit 量化:

from transformers import AutoModelForCausalLM

import bitsandbytes as bnb

model = AutoModelForCausalLM.from_pretrained(

"gpt2",

load_in_8bit=True,

device_map="auto"

)

✅ 5. 使用高效训练框架

- 使用以下框架提升效率:

- Hugging Face

transformers+datasets - Deepspeed(也支持单卡优化)

- LoRA(Low Rank Adaptation):只训练少量参数,显著降低内存占用。

- Hugging Face

pip install peft # 用于LoRA训练

✅ 6. 多阶段训练策略

- 预训练阶段: 用小数据集、低模型规模快速训练。

- 微调阶段: 使用已有预训练模型,在特定任务数据上微调。

✅ 7. 使用小数据集或分批加载

- 避免一次性加载大数据集,使用

datasets库中的流式加载:

from datasets import load_dataset

dataset = load_dataset("wikitext", "wikitext-2-raw-v1", streaming=True)

🛠 推荐配置建议(单卡 12GB GPU):

PyTorch 是一个开源的深度学习框架,由 Facebook AI Research 开发。它基于 Python,提供了灵活、动态的计算图,广泛应用于学术研究与工业界。

torch.nn 构建模型结构清晰,易于扩展1. torch.Tensor

- 类似 NumPy 的多维数组,支持 GPU 加速和自动求导。

import torch

x = torch.tensor([[1., 2.], [3., 4.]], requires_grad=True)

你可以通过 .cuda() 把张量转移到 GPU:

x = x.cuda()

2. 自动求导 autograd

- PyTorch 会自动构建计算图并进行反向传播:

y = x.pow(2).sum()

y.backward()

print(x.grad) # 输出 dy/dx

3. 神经网络模块 torch.nn

- 用于定义和构建神经网络:

import torch.nn as nn

class MyModel(nn.Module):

def __init__(self):

super().__init__()

self.linear = nn.Linear(10, 5)

def forward(self, x):

return self.linear(x)

4. 优化器 torch.optim

- 管理模型参数更新:

optimizer = torch.optim.Adam(model.parameters(), lr=1e-3)

5. 数据加载 torch.utils.data

- 用于处理数据集和数据加载:

from torch.utils.data import DataLoader, Dataset

class MyDataset(Dataset):

def __getitem__(self, index):

return torch.tensor([index], dtype=torch.float32)

def __len__(self):

return 100

loader = DataLoader(MyDataset(), batch_size=4)

import torch

import torch.nn as nn

import torch.optim as optim

from torch.utils.data import DataLoader, TensorDataset

# 数据准备

x = torch.randn(100, 10)

y = torch.randint(0, 2, (100,))

dataset = TensorDataset(x, y)

dataloader = DataLoader(dataset, batch_size=16)

# 模型定义

model = nn.Sequential(

nn.Linear(10, 32),

nn.ReLU(),

nn.Linear(32, 2)

)

# 损失函数和优化器

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=1e-3)

# 训练循环

for epoch in range(5):

for xb, yb in dataloader:

preds = model(xb)

loss = criterion(preds, yb)

optimizer.zero_grad()

loss.backward()

optimizer.step()

print(f"Epoch {epoch}, Loss: {loss.item():.4f}")

- 语言模型(GPT、BERT)

- 图像识别、生成模型(GANs、CNNs)

- 强化学习(DQN、A3C)

- 多模态模型(如图文结合)

- 自定义科学计算模拟器(利用动态图)

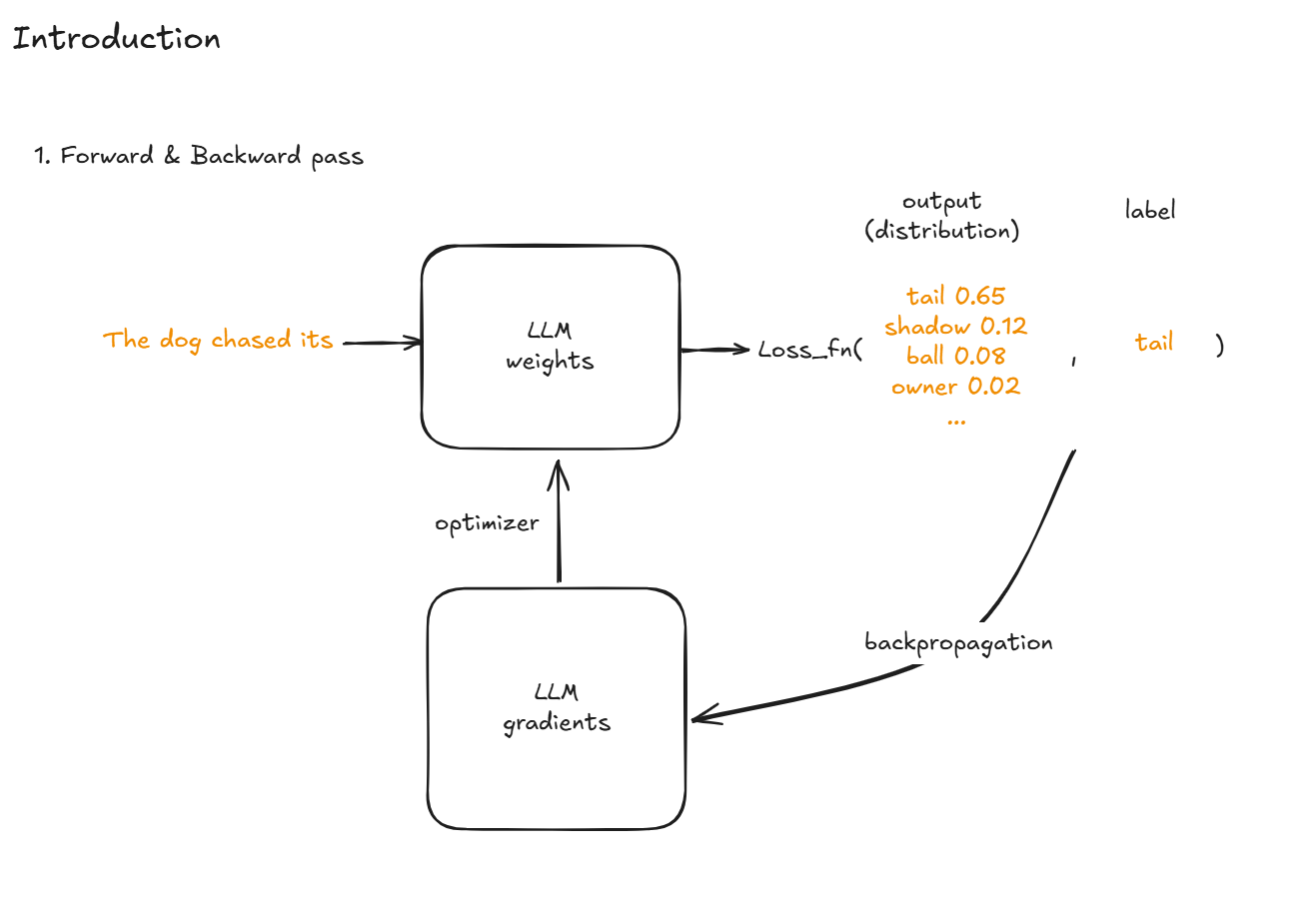

正向传播(Forward Propagation)和反向传播(Backward Propagation)是神经网络训练的两个核心步骤,它们是深度学习模型的工作原理和优化过程的基础。下面我将详细介绍这两个过程,并解释它们在训练神经网络中的重要性。

🔥 正向传播(Forward Propagation)

正向传播 是神经网络中信息流动的过程,它将输入数据从网络的输入层传递到输出层,计算出预测值或输出。

1. 计算过程

正向传播的过程可以分为以下几个步骤:

-

输入层接收数据:输入层接收到外部输入数据(例如图像、文本等)。

-

加权求和:每一层神经元计算输入数据与权重的加权和。对于每一层的每个神经元:

[

z^{(l)} = W^{(l)} x^{(l-1)} + b^{(l)}

]

其中:- ( W^{(l)} ) 是当前层的权重矩阵,

- ( x^{(l-1)} ) 是前一层的输出(或者输入层的数据),

- ( b^{(l)} ) 是当前层的偏置项,( z^{(l)} ) 是加权求和的结果。

-

激活函数:激活函数(如 ReLU、Sigmoid、Tanh 等)作用于每个神经元的加权和,增加非线性特性,使网络能够拟合复杂的函数关系:

[

a^{(l)} = sigma(z^{(l)})

]

其中,( a^{(l)} ) 是当前层的输出,( sigma ) 是激活函数。 -

输出层:最终,神经网络的输出层给出预测结果(例如分类结果、回归值等)。

2. 示例

假设你有一个简单的三层神经网络(输入层 -> 隐藏层 -> 输出层),正向传播过程如下:

- 输入数据通过输入层传入网络。

- 输入数据乘以权重矩阵,加入偏置项,得到加权和。

- 加权和通过激活函数(如 ReLU)进行非线性变换。

- 经过隐藏层处理后,最终通过输出层生成网络的预测结果。

在这个过程中,计算得到的是 预测值(或输出),这是神经网络对输入数据的“前向推断”。

🔄 反向传播(Backward Propagation)

反向传播 是神经网络训练的核心,目的是通过计算损失函数的梯度,更新模型的参数(权重和偏置),以减小预测误差。反向传播是利用 链式法则 计算各层参数的梯度,并根据梯度调整参数。

1. 反向传播的步骤

-

计算损失函数:反向传播的起点是损失函数,它衡量了网络预测值和真实值之间的差异。对于分类任务,常见的损失函数是 交叉熵损失;对于回归任务,常见的损失函数是 均方误差(MSE)。假设损失函数为 ( L ),则:

[

L = frac{1}{2}(y_{ ext{pred}} – y_{ ext{true}})^2

]

其中 ( y_{ ext{pred}} ) 是网络的预测值,( y_{ ext{true}} ) 是真实标签。 -

计算输出层的梯度:首先,计算损失函数相对于输出层激活值(比如,softmax 输出的概率分布)的梯度。对损失函数求导,得到输出层的误差(即梯度):

[

frac{partial L}{partial a^{(L)}} = frac{partial L}{partial z^{(L)}} cdot frac{partial z^{(L)}}{partial a^{(L)}}

]

其中 ( a^{(L)} ) 是输出层的激活值,( z^{(L)} ) 是输出层的加权和。 -

反向传播到每一层:利用链式法则,从输出层开始,逐层向输入层传播误差,并计算每一层的梯度。对于隐藏层,误差的传播依赖于当前层的激活函数导数和后面一层的误差:

[

delta^{(l)} = left( W^{(l+1)}

ight)^T delta^{(l+1)} cdot sigma’(z^{(l)})

]

其中 ( delta^{(l)} ) 是第 ( l ) 层的误差项,( sigma’(z^{(l)}) ) 是激活函数的导数。 -

计算梯度:计算每一层的参数梯度,用来更新权重和偏置:

[

frac{partial L}{partial W^{(l)}} = delta^{(l)} (a{(l-1)})T

]

其中 ( delta^{(l)} ) 是第 ( l ) 层的误差,( a^{(l-1)} ) 是前一层的激活值。 -

更新权重和偏置:使用梯度下降(或其他优化算法)更新网络的参数:

[

W^{(l)} := W^{(l)} – eta frac{partial L}{partial W^{(l)}}

]

其中 ( eta ) 是学习率。

2. 反向传播的关键点

- 链式法则:反向传播利用链式法则,依次计算每一层的梯度,将误差逐层反向传播,直至输入层。

- 梯度下降:计算梯度后,使用梯度下降法更新模型参数,减小误差。

3. 反向传播示例

假设你有一个简单的神经网络,它有输入层、一个隐藏层和一个输出层,输出层的激活函数是 Sigmoid。反向传播的过程大致如下:

- 计算损失:首先,计算损失函数 ( L )。

- 计算输出层梯度:计算损失函数相对于输出层激活值的梯度。

- 反向传播误差:将输出层的误差逐层传递给隐藏层。

- 计算隐藏层梯度:使用链式法则计算隐藏层的梯度。

- 更新参数:使用梯度下降更新权重和偏置。

🧑💻 正向传播与反向传播结合

在神经网络的训练过程中,正向传播和反向传播是交替进行的。具体流程如下:

- 正向传播:输入数据经过网络计算得到预测结果。

- 计算损失:根据预测结果与真实标签计算损失。

- 反向传播:根据损失函数计算各层梯度,并利用反向传播更新网络参数。

- 参数更新:使用梯度下降等优化算法调整网络的权重和偏置。

这种正向传播与反向传播交替进行,通常通过多个批次(batch)和多个 epoch 完成模型训练。

🏁 总结

- 正向传播:是数据从输入层到输出层的传播过程,计算出模型的预测值。

- 反向传播:是通过计算损失函数的梯度,更新模型的参数,优化网络性能。

正向传播与反向传播是神经网络训练中的两个核心步骤,它们通过交替进行,使得模型逐步提高预测的准确性,并优化模型的参数。

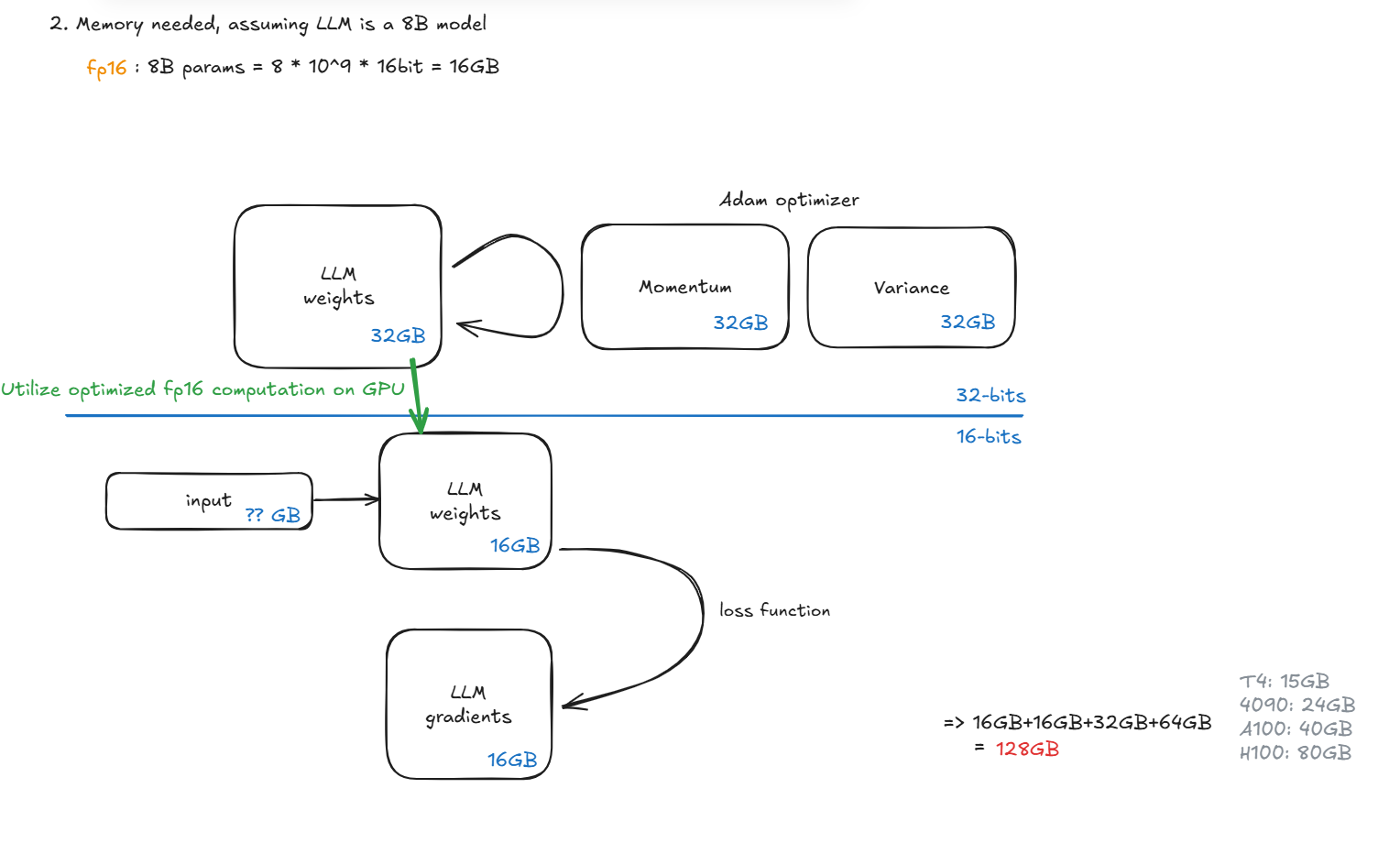

这是一个非常重要而又常被忽视的问题!我们来详细聊聊:

1. 默认情况下(PyTorch)

在 训练 模型时,PyTorch 默认使用 float32(也叫 FP32)格式 来存储参数。

float32(默认)float16bfloat16int8/uint8🔢 计算举例:

- 模型有 1000万个参数(1千万)

- 使用默认的

float32格式:

[

1000 000 imes 4 ext{bytes} = 4 ext{MB}

]

但这只是 模型参数本身,训练时的实际内存使用要大得多。

在训练中,每个参数会产生额外的内存占用,主要包括以下几项:

举个例子:使用 Adam 优化器训练时:

每个参数共需内存 ≈

[

参数本身(4B) + 梯度(4B) + 一阶动量(4B) + 二阶动量(4B) = 16B

]

✅ 所以:

float32 + Adam 时,一个参数在训练时约占 16 字节内存!

1. 使用混合精度训练(FP16)

- 减少模型参数和梯度占用到 2B

- 可通过 NVIDIA Apex、PyTorch AMP 或 DeepSpeed 实现:

from torch.cuda.amp import GradScaler, autocast

⚠️ 但注意:优化器状态(如 Adam)仍可能是 float32,除非做额外处理。

2. 使用优化器状态优化(ZeRO)

- DeepSpeed ZeRO Stage 1/2/3 可以:

- 分布优化器状态到多个 GPU

- 减少每张卡上的显存压力

3. 参数量化(int8、4bit)

- 使用

bitsandbytes等库将参数压缩为 8-bit 或更小精度 - 用于 推理 更常见,但也可以用于 微调

from transformers import AutoModelForCausalLM

model = AutoModelForCausalLM.from_pretrained(

"gpt2",

load_in_8bit=True, # 使用 int8 参数

device_map="auto"

)

存储是计算机系统中非常关键的部分,涉及到数据的持久化、读取、写入等操作。在计算机体系结构中,存储一般指的是 存储介质(如硬盘、内存、缓存等)用于存储数据、程序和指令。下面我将为你介绍存储的基本概念,并对常见的存储类型和技术做一些详细讲解。

📂 存储的分类

存储可以根据不同的角度进行分类,主要有以下几种方式:

1. 根据访问速度

-

主存(Primary Storage):也叫内存,是计算机中的临时存储器,存放当前正在处理的程序和数据。主存的访问速度非常快,通常由**RAM(随机存取存储器)**构成。主存的缺点是没有持久性,一旦断电,数据会丢失。

-

辅存(Secondary Storage):也叫外存,是用于长期存储数据的设备。它的访问速度较慢,但存储容量非常大。常见的辅存设备包括硬盘(HDD)、固态硬盘(SSD)、光盘、U盘等。辅存具备持久性,断电后数据依然保持。

-

缓存(Cache):缓存是一种介于 CPU 和主存之间的超高速存储器,主要用于存储经常访问的数据或指令。缓存的访问速度比内存快很多,但容量较小。常见的缓存有 L1、L2 和 L3 缓存。

-

外部存储(Tertiary Storage):这是为存储大数据量或者备份数据设计的存储设备。外部存储通常包括磁带、光盘等,它们存取速度较慢,但成本较低,适用于长期数据存储。

2. 根据存储介质

-

电子存储:这种存储方式使用电子设备保存数据,常见的存储介质包括 硬盘(HDD)、固态硬盘(SSD)、闪存、光盘等。

-

机械存储:这类存储设备基于物理运动来存储和读取数据,例如传统的 硬盘驱动器(HDD)。

-

光存储:如 CD、DVD 等,这些存储设备利用激光读取和写入数据。

💾 常见存储类型

1. 内存(RAM)

- RAM(随机存取存储器)是计算机的主存储,存放正在运行的程序和数据。

- 类型:

- DRAM(动态随机存储器):常见类型,成本低,但速度较慢,必须周期性刷新。

- SRAM(静态随机存储器):速度快,通常用于CPU的缓存,但成本较高且功耗较大。

2. 硬盘(HDD)

- HDD(硬盘驱动器) 是一种传统的磁性存储设备,使用磁头在旋转的盘片上读写数据。

- 优点:

- 容量大且价格相对便宜,适合大容量存储。

- 存储的耐久性较高,适合长时间存储数据。

- 缺点:

- 速度较慢,访问时间长。

- 机械部件易损耗,可靠性较低。

3. 固态硬盘(SSD)

- SSD(固态硬盘) 是一种使用闪存芯片存储数据的设备,几乎没有机械部件。

- 优点:

- 速度远超 HDD,访问时间短,数据读写速度快。

- 没有机械部件,更加耐用。

- 缺点:

- 成本较高,单位存储价格比 HDD 贵。

- 写入次数有限,使用一段时间后会磨损(虽然现代 SSD 有很强的耐用性)。

4. 闪存(Flash Memory)

- 闪存 是一种非易失性的存储技术,数据在断电后依然保留,广泛应用于 USB 闪存盘、存储卡、SSD 中。

- 优点:

- 较高的读写速度,广泛应用于便携式设备。

- 体积小、抗震动。

5. 光盘(Optical Discs)

- CD、DVD、Blu-ray 等光盘存储技术利用激光读取存储在光盘上的数据。光盘通常用于数据备份、媒体播放等用途。

- 优点:

- 便于存储和传播数据,且价格较低。

- 容量适中,可以用来存储音乐、电影、软件等。

- 缺点:

- 读写速度较慢,易受损伤。

🔑 存储的基本工作原理

1. 存储介质如何工作

-

HDD(硬盘):硬盘的核心工作原理是 磁记录。硬盘由多个旋转的磁盘盘片和一个磁头组成,磁头在盘片上读取或写入数据。由于其机械部件,硬盘的读写速度相对较慢,且具有较大的延迟。

-

SSD(固态硬盘):SSD 使用的是 闪存 存储,通过电子方式存储数据,没有机械部件,因此速度更快。SSD 存储的单元是 NAND Flash,它采用了类似的页(Page)和块(Block)的组织方式。

-

RAM(内存):内存是一种基于 半导体 的电子存储,工作原理是通过电荷在存储单元中的存储和释放来表示数据。内存具有极高的读写速度,但一旦电源关闭,数据就会丢失。

📈 存储的性能指标

-

存取时间:存储设备开始处理数据请求所需的时间。对于硬盘来说,存取时间由 寻道时间 和 旋转延迟 组成,而对于 SSD,几乎没有这些延迟。

-

带宽/吞吐量:单位时间内可以读取或写入的数据量。对于 SSD 和内存,带宽通常较高。

-

IOPS(每秒输入输出操作次数):衡量存储设备处理输入输出操作的能力,SSD 在这方面通常优于硬盘。

-

耐用性:存储设备的寿命,尤其是对于 SSD,它的写入次数有限,超过一定次数后会出现性能下降。

🧑💻 存储的现代趋势

-

云存储:随着互联网的发展,越来越多的个人和企业将数据存储迁移到云平台。云存储可以提供几乎无限的存储空间,支持随时随地访问。

-

分布式存储:为了提高数据存储的可靠性和性能,很多公司采用了分布式存储系统,如 HDFS(Hadoop 分布式文件系统)、Ceph、Amazon S3 等。

-

存储虚拟化:通过软件层实现多种存储资源的抽象和集中管理,允许不同的物理存储设备像一个统一的存储池一样被使用。

-

硬盘与 SSD 混合使用:很多服务器和高性能计算机使用硬盘与 SSD 混合存储。常用的策略是将频繁访问的数据存储在 SSD 中,而将冷数据存储在硬盘中。

📝 总结

- 存储设备分为 主存(RAM) 和 辅存(HDD、SSD),它们的特点是访问速度和持久性不同。

- 现代计算中,SSD 正逐渐取代 HDD,成为更高效的存储方案。

- 存储的关键性能指标包括 存取时间、带宽、IOPS 和 耐用性。

- 云存储 和 分布式存储 是未来存储发展的重要趋势。

在计算机系统中,存储的基本单位是指计算机如何组织和管理数据的最小单元。理解这些基本单位有助于我们更好地理解计算机存储的结构、容量和性能。

下面,我将为你详细介绍存储的基本单位,从最小单位(比特)到更大的单位(TB、PB等)一一解释。

📊 存储基本单位

1. 比特(bit)

- 比特是计算机中数据的最基本单位,代表二进制的“0”或“1”。

- 比特是 存储和传输信息 的最小单元。在物理层面,它通常由电流的有无、高低电压、光信号的有无等状态来表示。

- 比特可以组合成更大的单位,如字节(Byte)。

2. 字节(Byte)

- 字节是计算机中常见的存储单位,通常由 8 个比特 组成。

- 字节通常用来表示 一个字符,例如在 ASCII 编码中,一个字节存储一个字符。

- 字节是计算机存储、文件系统和内存中的常用单位。

3. 千字节(Kilobyte, KB)

- 千字节(KB) 是一个较大的存储单位,表示 1024 字节。

- 在早期的计算机系统中,通常以 KB 为单位表示内存或文件大小。

- 1 KB = 1024 B

4. 兆字节(Megabyte, MB)

- 兆字节(MB) 是比千字节更大的存储单位,表示 1024 KB,即 1,048,576 字节。

- 在现代计算机中,1 MB 常用于表示文件、文档、图片等的数据大小。

- 1 MB = 1024 KB = 1,048,576 B

5. 千兆字节(Gigabyte, GB)

- 千兆字节(GB) 是 1024 MB,也就是 1,073,741,824 字节。

- GB 常用来表示存储设备(如硬盘、SSD)和计算机内存的大小。

- 1 GB = 1024 MB = 1,073,741,824 B

6. 太字节(Terabyte, TB)

- 太字节(TB) 是 1024 GB,即 1,099,511,627,776 字节。

- 1 TB 常用于表示较大容量的硬盘、存储阵列等设备的存储能力。

- 1 TB = 1024 GB = 1,099,511,627,776 B

7. 拍字节(Petabyte, PB)

- 拍字节(PB) 是 1024 TB,即 1,125,899,906,842,624 字节。

- 在数据中心和大型云存储服务中,1 PB 是常见的存储单位,用于衡量海量的数据存储能力。

- 1 PB = 1024 TB = 1,125,899,906,842,624 B

8. 艾字节(Exabyte, EB)

- 艾字节(EB) 是 1024 PB,即 1,152,921,504,606,846,976 字节。

- 1 EB 通常用于表示极大规模的数据存储,如全球云服务和数据中心的存储容量。

- 1 EB = 1024 PB = 1,152,921,504,606,846,976 B

9. 泽字节(Zettabyte, ZB)

- 泽字节(ZB) 是 1024 EB,即 1,180,591,620,717,411,303,424 字节。

- ZB 常用于描述全球级别的存储或数据总量,通常在互联网数据流量和大数据领域中使用。

- 1 ZB = 1024 EB = 1,180,591,620,717,411,303,424 B

10. 尧字节(Yottabyte, YB)

- 尧字节(YB) 是 1024 ZB,即 1,208,925,819,614,629,174,706,176 字节。

- Yottabyte 是目前最大的数据存储单位,理论上已经超出了大多数人类所能接触的数据量,更多用于未来的技术发展中,特别是涉及到 全球数据存储 和 大规模互联网数据流量 的讨论。

- 1 YB = 1024 ZB = 1,208,925,819,614,629,174,706,176 B

⚡ 存储单位转换

在实际应用中,我们常常需要在这些单位之间进行转换。下面是常用的存储单位转换关系:

🖥️ 存储结构和组织

在存储系统中,数据并不是简单地线性存储的。数据通常以特定的方式进行组织和结构化,以提高存储和检索效率。下面是几种常见的存储结构:

1. 块存储(Block Storage)

- 数据被存储在固定大小的块中,每个块都有一个唯一的地址。

- 常见于硬盘驱动器(HDD)、固态硬盘(SSD)等设备。

- 例如,传统的文件系统(如 NTFS 或 ext4)就是基于块存储。

2. 文件存储(File Storage)

- 数据按文件组织,通常包含目录和文件名。文件系统提供了文件的层次结构。

- 适用于日常文件管理,如操作系统的文件系统(例如 FAT、NTFS 等)。

3. 对象存储(Object Storage)

- 数据被组织为 对象,每个对象由数据、元数据和唯一标识符(ID)组成。

- 适用于大规模、非结构化数据存储,如 Amazon S3、Google Cloud Storage 等。

4. 数据库存储(Database Storage)

- 数据按照表格的形式存储,并通过数据库管理系统(DBMS)进行索引和查询。

- 适用于结构化数据,广泛用于事务处理系统。

💡 小结

- 比特(bit) 是数据存储的最小单位,通常用 0 和 1 来表示。

- 字节(Byte) 是计算机中数据存储的基本单位,1 字节由 8 个比特组成,通常用于表示一个字符。

- 存储单位依次增大,从 KB 到 YB,适用于描述不同规模的数据存储。

- 数据存储的组织结构可以是块存储、文件存储、对象存储等,不同的存储方式适用于不同的应用场景。

这些基本单位和存储结构是计算机系统中管理和处理数据的基础,理解它们对于设计高效的存储系统、选择合适的存储介质、以及在大数据和云计算等领域应用非常重要。

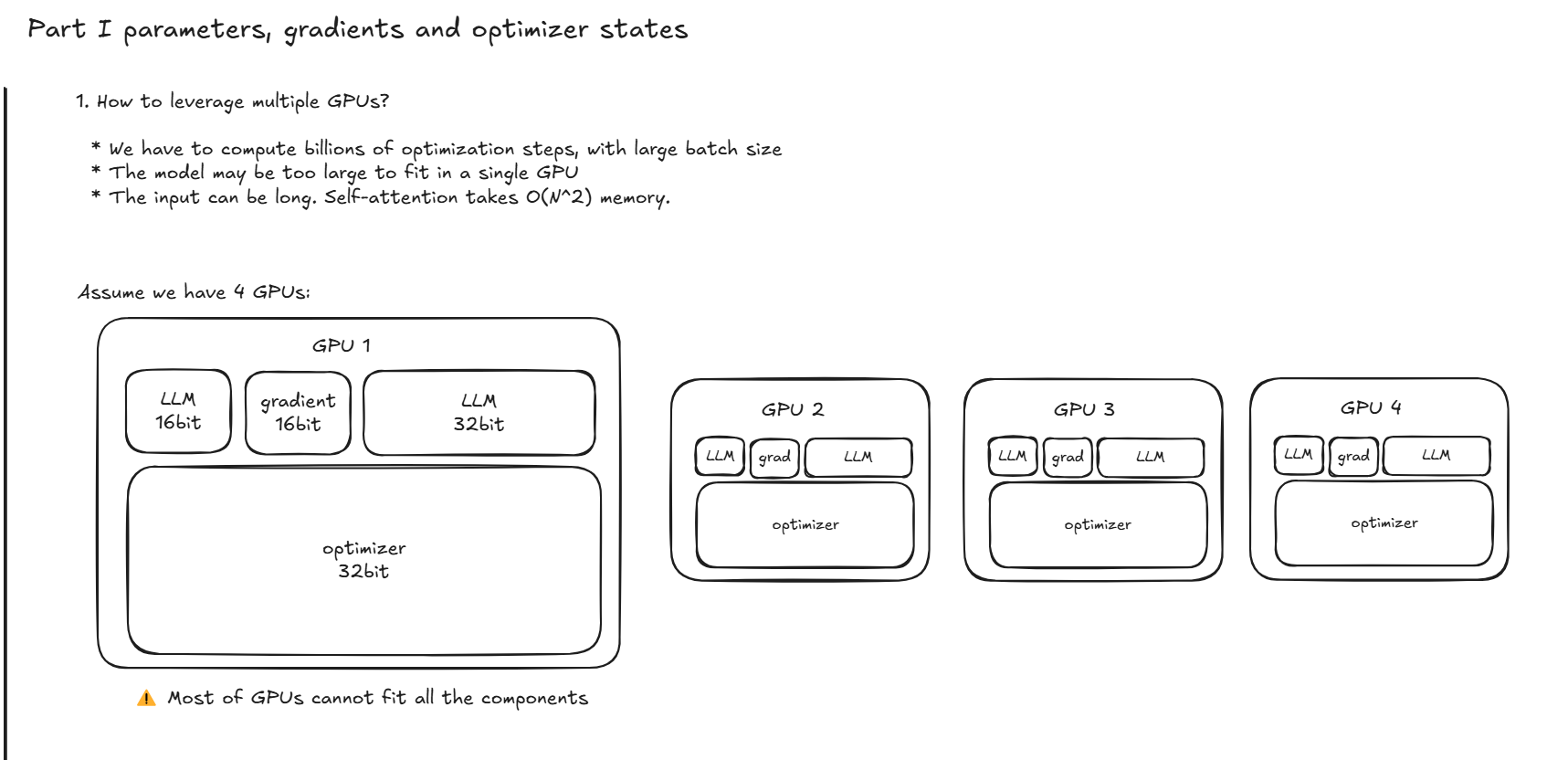

将大语言模型放入多个 GPU 中是训练和推理过程中常见的操作,尤其是在深度学习模型越来越复杂时。通过合理地将模型分配到多个 GPU 中,可以显著提高计算效率,缩短训练时间,并允许处理更大的模型和数据。常见的技术包括 数据并行(Data Parallelism)、模型并行(Model Parallelism) 和 混合并行(Hybrid Parallelism)。下面我会详细讲解如何在多个 GPU 中部署大语言模型。

🚀 1. 数据并行(Data Parallelism)

数据并行 是最常见的多 GPU 使用方式,特别适用于训练模型时。数据并行将数据集分成若干批次,每个批次在不同的 GPU 上并行处理。每个 GPU 维护模型的副本,并通过分布式通信同步梯度,确保每个 GPU 上的模型都能得到一致的更新。

基本原理

- 每个 GPU 拷贝一份模型。

- 数据分成多个 mini-batch,分别送入不同的 GPU 进行处理。

- 训练过程中,每个 GPU 会计算梯度,并通过 All-Reduce 等算法将梯度同步到其他 GPU 上,最后更新模型的参数。

实现方式

- 在 PyTorch 中,可以使用

torch.nn.DataParallel或者更高效的torch.distributed包。

示例:使用 DataParallel

import torch

import torch.nn as nn

# 假设 model 是你已经定义好的大语言模型

model = MyLargeModel()

# 使用 DataParallel 将模型并行化到多个 GPU 上

if torch.cuda.is_available():

device_ids = [0, 1] # 使用两个 GPU

model = nn.DataParallel(model, device_ids=device_ids)

# 将模型移动到 GPU 上

model = model.cuda()

# 在训练过程中,PyTorch 会自动将数据划分到多个 GPU,并进行梯度同步

output = model(input_data)

优点:

- 实现简单,能够快速将模型并行化。

- 支持自动的梯度同步和数据分配。

缺点:

- 当模型非常大时,复制模型到每个 GPU 可能会占用过多内存,导致内存瓶颈。

DataParallel的并行效率可能受到 CPU 和 GPU 之间数据传输带宽的限制,尤其在跨节点时。

🛠️ 2. 模型并行(Model Parallelism)

模型并行 是将模型的不同部分(如层、模块等)分配到不同的 GPU 上。这种方式适用于 模型过大,单个 GPU 无法容纳时。

基本原理

- 将模型切分成多个部分(例如,将不同层分配给不同的 GPU)。

- 计算时,数据会在各个 GPU 之间传递(例如,传递激活值和梯度),从而跨设备计算模型的每个部分。

实现方式

- 你需要手动设计模型的分割方式,将不同的层或模块放到不同的设备上。你可以使用

torch.nn.Module的.to(device)或torch.cuda.device来指定每一层的设备。

示例:使用模型并行

import torch

import torch.nn as nn

class MyLargeModel(nn.Module):

def __init__(self):

super(MyLargeModel, self).__init__()

self.layer1 = nn.Linear(100, 100)

self.layer2 = nn.Linear(100, 100)

self.layer3 = nn.Linear(100, 100)

def forward(self, x):

x = self.layer1(x)

x = x.cuda(1) # 将中间结果移动到第二个 GPU

x = self.layer2(x)

x = x.cuda(2) # 将结果移到第三个 GPU

x = self.layer3(x)

return x

# 创建模型并将其分布到不同的 GPU

model = MyLargeModel()

model = model.cuda(0) # 将模型的第一层放到 GPU 0

优点:

- 适合处理大规模的模型,能够将模型切分到不同的 GPU 上,从而避免单个 GPU 内存不足。

- 可以有效地处理非常大的模型(如 GPT、BERT 等)。

缺点:

- 手动划分模型各部分,需要在模型设计时小心规划。

- 各部分 GPU 之间的通信可能成为瓶颈,特别是在跨多个节点时。

- 内存使用可能不如数据并行高效。

⚡ 3. 混合并行(Hybrid Parallelism)

混合并行 是将 数据并行 和 模型并行 结合起来的方式,通常用于大规模训练任务中,尤其是当模型和数据集都非常大时。

基本原理

- 将 数据并行 用于处理训练数据,将 模型并行 用于处理模型的各部分。

- 这种方法可以有效地减轻单个 GPU 的内存压力,同时保持训练效率。

实现方式

- 通常采用

torch.distributed与DataParallel或DistributedDataParallel相结合的方式。 - 模型会被切分到不同的 GPU 上,同时在每个 GPU 上使用数据并行策略来加速训练。

示例:结合模型并行与数据并行

import torch

import torch.nn as nn

from torch.nn.parallel import DistributedDataParallel as DDP

class MyLargeModel(nn.Module):

def __init__(self):

super(MyLargeModel, self).__init__()

self.layer1 = nn.Linear(100, 100).cuda(0)

self.layer2 = nn.Linear(100, 100).cuda(1)

def forward(self, x):

x = self.layer1(x)

x = x.cuda(1)

x = self.layer2(x)

return x

# 假设你已经设置了分布式环境

torch.distributed.init_process_group(backend="nccl")

model = MyLargeModel()

# 使用 DDP 和模型并行

model = DDP(model, device_ids=[0, 1])

# 训练过程中,数据会被分配到不同的 GPU 并进行同步

output = model(input_data)

优点:

- 可以处理极大规模的模型和数据集,优化了内存使用。

- 高效利用多个 GPU,提高了训练的速度。

缺点:

- 实现起来较为复杂,需要配置分布式训练环境。

- 需要小心设计数据和模型的切分方式,以避免通信瓶颈。

📡 4. 分布式训练(Distributed Training)

分布式训练通过多个节点和多个 GPU 来并行化训练任务,尤其适用于超大规模的语言模型。

实现方式

- 使用

torch.distributedAPI,可以在多个节点和多个 GPU 上运行训练任务。 - PyTorch 提供了

DistributedDataParallel(DDP) 来加速分布式训练,它会在多个 GPU 上同步梯度。

示例:使用 DistributedDataParallel

import torch

import torch.nn as nn

import torch.distributed as dist

from torch.nn.parallel import DistributedDataParallel as DDP

def setup(rank, world_size):

dist.init_process_group("nccl", rank=rank, world_size=world_size)

def cleanup():

dist.destroy_process_group()

class MyModel(nn.Module):

def __init__(self):

super(MyModel, self).__init__()

self.fc = nn.Linear(100, 100)

def forward(self, x):

return self.fc(x)

def train(rank, world_size):

setup(rank, world_size)

model = MyModel().to(rank)

model = DDP(model, device_ids=[rank])

# 训练代码

optimizer = torch.optim.SGD(model.parameters(), lr=0.01)

input_data = torch.randn(100, 100).to(rank)

target = torch.randn(100, 100).to(rank)

output = model(input_data)

loss = nn.MSELoss()(output, target)

loss.backward()

optimizer.step()

cleanup()

# 假设你有两个 GPU

world_size = 2 # 使用两个 GPU

train(rank=0, world_size=world_size)

优点:

- 高效支持多 GPU 和多节点的训练。

DistributedDataParallel相比于DataParallel更高效,能够减少通信开销。

缺点:

- 配置较复杂,特别是在跨多个节点时,需要配置网络、集群等。

- 需要额外的硬件资源。

🧑💻 总结

将大语言模型放入多个 GPU 中,主要依赖于 数据并行 和 模型并行。数据并行简单易用,但对于非常大的模型,模型并行更为有效。更复杂的 混合并行 方法结合了数据并行和模型并行,以便更高效地利用硬件资源。分布式训练适用于更大规模的训练任务,通过多个节点和 GPU 加速模型训练。

DeepSpeed 是由 Microsoft 提供的开源深度学习训练优化库,专为大规模分布式训练、大模型训练和高效推理而设计。它的目标是显著提高深度学习模型的训练速度和效率,减少内存消耗,并支持在单机和多机、多 GPU 环境下进行大规模训练。随着深度学习模型变得越来越复杂和庞大,DeepSpeed 提供了一个非常有效的解决方案,帮助研究人员和工程师更好地应对这些挑战。

下面将详细介绍 DeepSpeed 的基本概念、功能、工作原理及其核心优势。

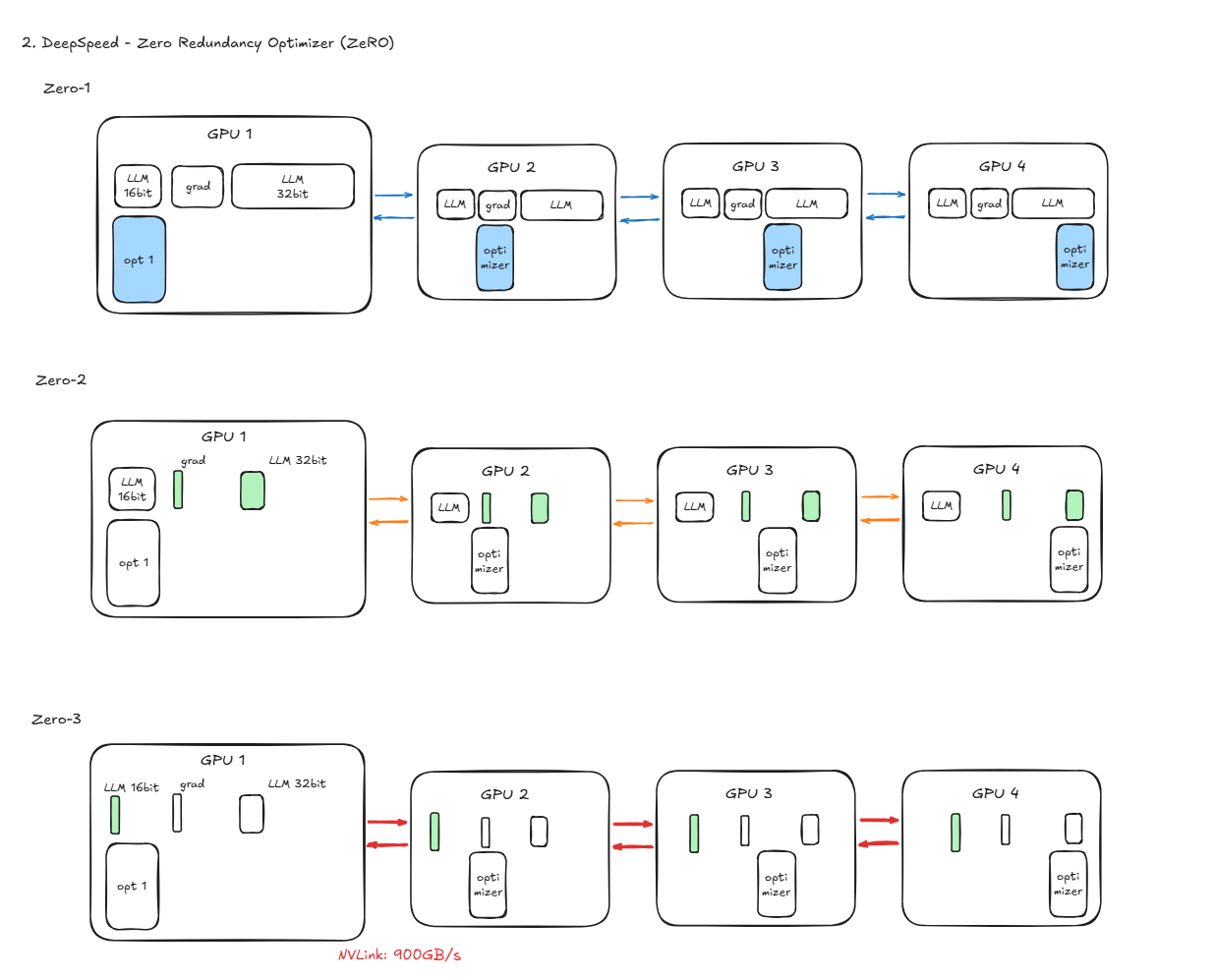

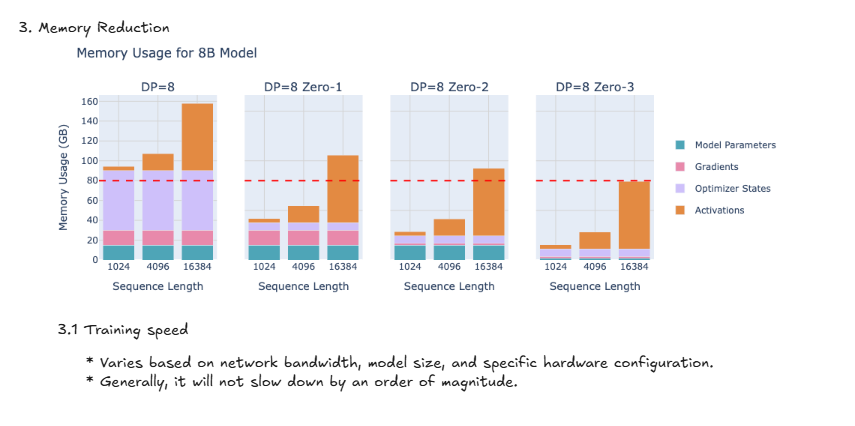

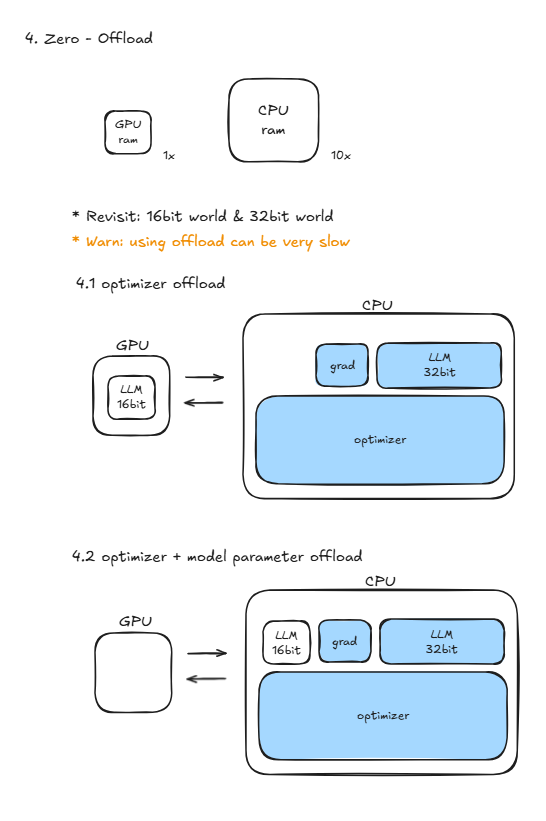

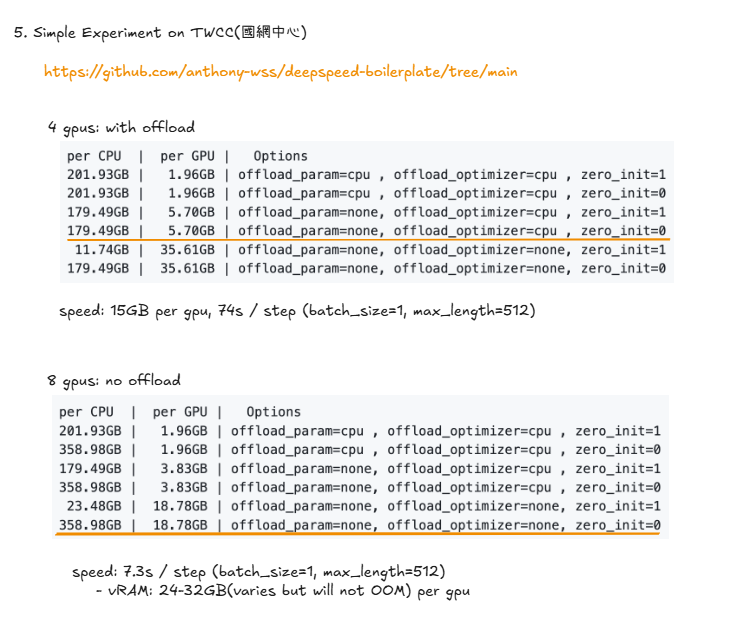

1. 内存优化

-

ZeRO(Zero Redundancy Optimizer):ZeRO 是 DeepSpeed 的核心技术之一,旨在优化大模型的内存消耗,尤其在分布式训练中。ZeRO 分阶段优化模型参数、梯度和优化器状态的存储,显著减少了每个 GPU 的内存占用。

- ZeRO Stage 1:优化梯度存储。每个 GPU 存储部分梯度,避免冗余。

- ZeRO Stage 2:优化梯度和模型参数的存储,进一步减少内存占用。

- ZeRO Stage 3:优化所有状态(包括梯度、参数和优化器状态),使得模型可以被大幅度分割存储到多个设备上。

-

这种内存优化技术允许训练比以前更大的模型,并减少了每个节点所需的内存。

2. 混合精度训练(FP16)

DeepSpeed 支持混合精度训练(FP16),即使用 16-bit 浮点数 代替传统的 32-bit 浮点数。这样不仅可以节省内存,还可以提高计算效率。DeepSpeed 利用 NVIDIA Apex 和 NVIDIA Tensor Cores 提供的支持,加速了训练过程。

- 优点:

- 更快的训练速度。

- 更低的内存占用。

- 在不影响模型精度的前提下,通过减少计算精度来提升性能。

3. 高效的分布式训练

DeepSpeed 提供了出色的分布式训练能力,可以扩展到数百甚至数千个 GPU。它的分布式训练通过 数据并行(Data Parallelism) 和 模型并行(Model Parallelism) 等策略,能够有效地利用多个 GPU 来加速训练。

-

弹性训练:DeepSpeed 支持动态扩展或缩减训练节点,使得训练过程更加灵活。如果某些 GPU 或节点掉线,训练过程不会中断,极大增强了容错性。

-

Zero Communication Overhead:DeepSpeed 通过高效的梯度通信策略,减少了网络带宽的使用,避免了传统多节点训练中的瓶颈。

4. 高效的梯度更新与优化器

DeepSpeed 提供了自定义的优化器(如 Adam, Adafactor 等),在处理大模型时具有显著的内存和计算优势。

- 优化器状态分布:在传统的 Adam 优化器中,存储每个参数的梯度、动量等信息需要占用大量内存,而 DeepSpeed 的 ZeRO 技术允许将优化器状态分布到多个 GPU 中,避免了内存瓶颈。

5. 推理加速

除了训练,DeepSpeed 还在推理方面做出了优化。通过采用 量化(Quantization) 技术和 知识蒸馏(Knowledge Distillation),它能够大幅度提升推理速度并减少推理时的内存需求。

- 量化:通过降低模型参数的精度(如从 FP32 降到 INT8),可以减少存储需求并加速推理。

- 蒸馏:通过蒸馏技术,从一个大模型训练出一个小模型,减小计算负担,适用于推理阶段。

1. 安装 DeepSpeed

DeepSpeed 依赖于 PyTorch,因此你需要先安装 PyTorch。安装 DeepSpeed 的最简单方法是通过 pip:

pip install deepspeed

如果你希望从源代码安装以进行自定义修改或支持特定功能(如自定义优化器或加速),可以通过以下命令进行安装:

DS_BUILD_OPS=1 pip install deepspeed

2. 配置文件

DeepSpeed 使用 JSON 格式的配置文件来指定训练过程中的各种参数,包括优化器、学习率、梯度累积步骤等。配置文件是 DeepSpeed 启动训练时的重要部分。

示例配置文件(deepspeed_config.json):

{

"train_batch_size": 16,

"gradient_accumulation_steps": 8,

"zero_optimization": {

"stage": 2,

"offload_optimizer": {

"device": "cpu",

"pin_memory": true

}

},

"fp16": {

"enabled": true

}

}

这个配置文件做了以下几件事:

- 设置了每个 GPU 上的训练 batch 大小为 16。

- 设置了梯度累积为 8,这意味着模型每 8 次更新后才会进行一次梯度计算和参数更新。

- 启用了 ZeRO Stage 2 来优化内存占用。

- 启用了 FP16 训练来提高计算效率并减少内存需求。

3. 使用 DeepSpeed 进行训练

在训练时,我们可以通过 deepspeed 命令启动训练脚本:

deepspeed --num_gpus=4 train.py

在这个命令中,train.py 是你的训练脚本,--num_gpus=4 表示使用 4 个 GPU 来并行训练。

代码示例:使用 DeepSpeed

import deepspeed

import torch

import torch.nn as nn

# 定义模型

class MyModel(nn.Module):

def __init__(self):

super(MyModel, self).__init__()

self.linear = nn.Linear(512, 512)

def forward(self, x):

return self.linear(x)

# 初始化模型

model = MyModel()

# 配置 DeepSpeed

deepspeed_config = {

"train_batch_size": 32,

"gradient_accumulation_steps": 4,

"zero_optimization": {

"stage": 2,

"offload_optimizer": {"device": "cpu", "pin_memory": True}

},

"fp16": {"enabled": True},

}

# 初始化 DeepSpeed

optimizer = torch.optim.Adam(model.parameters(), lr=1e-3)

model_engine, optimizer, _, _ = deepspeed.initialize(config=deepspeed_config, model=model, optimizer=optimizer)

# 假设你有输入数据

input_data = torch.randn(32, 512).cuda()

# 训练

output = model_engine(input_data)

loss = output.mean() # 假设的损失函数

model_engine.backward(loss)

model_engine.step()

- 内存优化:通过 ZeRO 和混合精度训练,DeepSpeed 可以有效地减少内存使用,允许训练比之前更大的模型。

- 大规模训练:支持数千个 GPU 的分布式训练,能够处理海量数据和复杂模型。

- 训练速度:通过减少通信开销、优化器状态分布和混合精度训练,DeepSpeed 大幅加快了训练过程。

- 推理加速:量化和蒸馏技术使得模型推理速度大幅提升,适合生产环境。

- 易于集成:DeepSpeed 兼容 PyTorch,支持与现有的训练代码无缝集成。

DeepSpeed 是一个非常强大的工具,专门针对大规模深度学习模型的训练和推理进行优化。它通过 ZeRO 技术、混合精度训练、高效分布式训练 等多个创新方案,显著提升了训练效率并降低了内存使用。DeepSpeed 不仅支持超大规模的模型训练,还能够在推理阶段提供加速,尤其适用于在资源受限的情况下训练大型语言模型(如 GPT-3、Turing-NLG 等)。

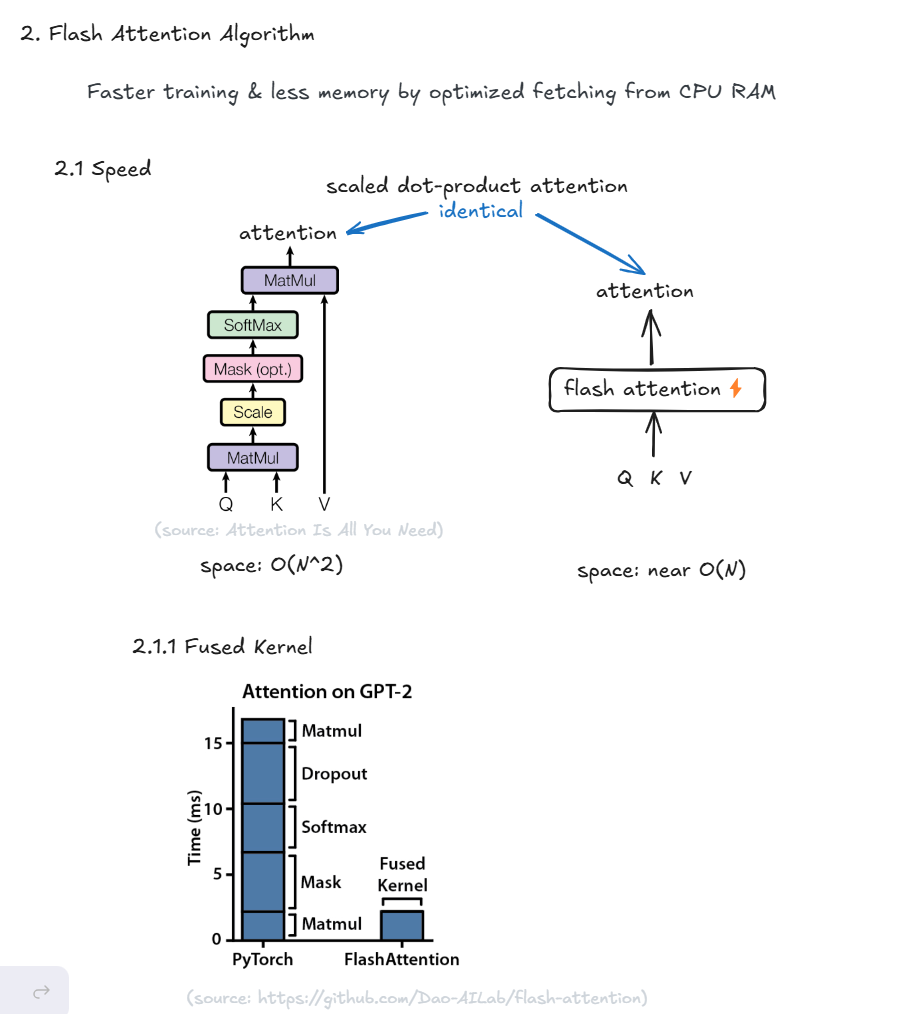

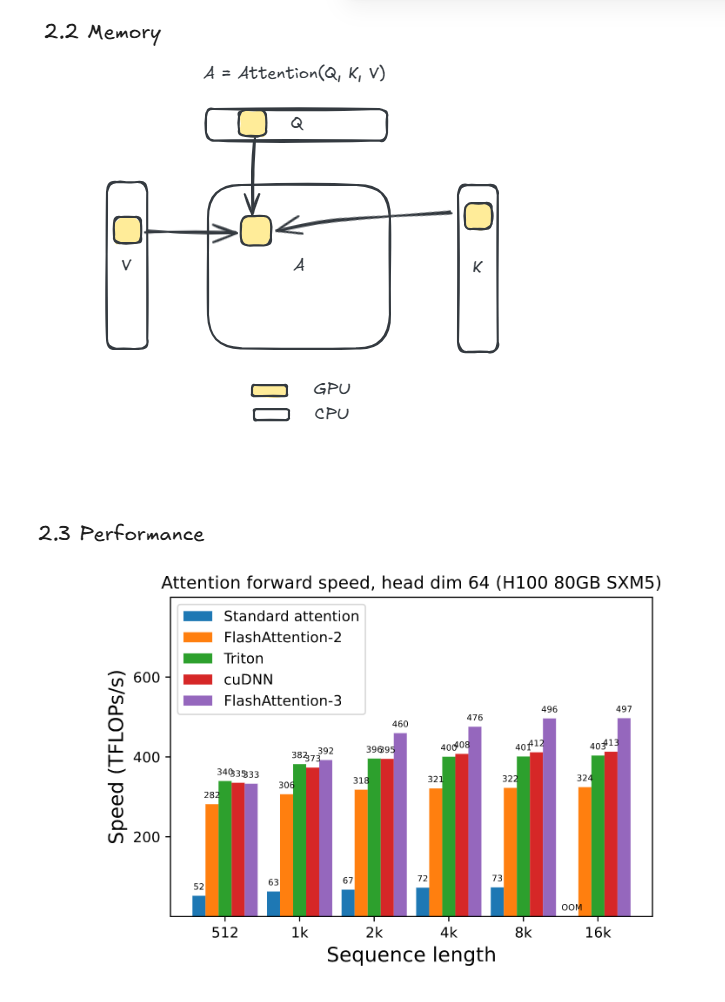

FlashAttention 是一种高效的 注意力机制 实现,旨在提升 Transformer 模型的训练和推理速度,尤其是在处理大规模数据时。它专为 自注意力(Self-Attention) 机制进行优化,减少了内存占用并加速了计算过程,特别适用于具有长序列的任务,如自然语言处理(NLP)和计算机视觉(CV)中的 Transformer 模型(如 BERT、GPT、ViT 等)。

FlashAttention 主要通过 CUDA 核心 的优化和 矩阵计算 的精简来提高效率,同时保持计算精度和模型性能。它是近年来深度学习框架中在处理注意力机制时的一个重要突破。

下面将详细介绍 FlashAttention 的背景、工作原理、优势、应用场景和实现方式。

1. 自注意力机制的计算挑战

在 Transformer 模型中,自注意力机制是核心部分,它计算了所有输入的加权和,其中每个输入都与其他所有输入建立联系。具体而言,给定输入序列 ( X )(长度为 ( N ),每个输入是一个向量),其注意力计算通常包括以下步骤:

- 计算 查询(Query)、键(Key) 和 值(Value):将输入序列通过线性变换得到查询、键和值。

- 计算注意力得分:计算查询和键的点积,并通过 softmax 函数得到归一化的注意力权重。

- 加权求和:将注意力权重与值相乘,得到最终的输出。

其计算复杂度为 ( O(N^2) ),因为每个查询与所有键进行点积操作。这导致在处理长序列时,内存和计算资源需求极为庞大。

2. 传统实现的瓶颈

- 内存瓶颈:由于每个查询都需要与所有键进行点积,因此需要存储一个 ( N imes N ) 的注意力矩阵,这对于长序列非常占用内存。

- 计算瓶颈:尤其是在长序列上,注意力计算的复杂度是 ( O(N^2) ),在现代硬件上效率较低。

- 分布式训练挑战:在多 GPU 训练时,大规模的注意力矩阵的计算和传输开销会导致显存瓶颈和通信瓶颈。

FlashAttention 通过以下几种技术和方法来优化传统自注意力机制:

1. 内存优化与块处理

FlashAttention 通过将 注意力矩阵 分成更小的 块(block) 进行计算,从而避免了传统实现中全矩阵计算时的内存压力。在计算时,FlashAttention 动态调整矩阵块的大小,使得每个块的计算和内存需求都能在 GPU 中有效管理。

- 传统实现中,整个矩阵需要被加载到 GPU 内存中,FlashAttention 通过分块的方式将计算分摊开来,减少了内存占用。

- 分块计算的方式能够在不牺牲计算精度的前提下,提高计算效率。

2. 矩阵乘法优化

FlashAttention 将 点积计算 转换成更加高效的矩阵乘法操作,利用 CUDA 核心 对矩阵乘法进行优化。通过对内存访问模式和计算流程的调整,FlashAttention 可以加速点积计算,并减少显存带宽的使用。

3. 减少全局内存访问

FlashAttention 减少了对全局内存的访问。通常,传统自注意力机制需要大量的内存读写操作,而 FlashAttention 使用高效的 局部内存(shared memory) 和 寄存器 来缓存中间计算结果,从而减少了对全局内存的依赖。

4. 精确的内存对齐

通过精确的内存对齐和计算调度,FlashAttention 可以最大化 GPU 的计算吞吐量。通过优化内存访问模式,数据可以更加高效地传输到 GPU 的计算单元,进一步提高了性能。

5. 混合精度计算

FlashAttention 支持 混合精度计算(Mixed Precision),即使用 16-bit 浮点数(FP16) 替代传统的 32-bit 浮点数(FP32),从而减少计算和内存需求,同时保持精度。这使得它特别适合在现代硬件(如具有 Tensor Cores 的 NVIDIA GPUs)上运行。

1. 提高计算效率

FlashAttention 可以显著提高自注意力机制的计算效率,尤其是在处理长序列时。传统的 ( O(N^2) ) 复杂度被优化为更加高效的 矩阵乘法 和 块处理,使得在大规模数据集上训练的速度大大提升。

2. 减少内存使用

通过分块计算和优化的内存访问方式,FlashAttention 显著减少了计算过程中对显存的需求。它通过减少全局内存访问、优化内存对齐等手段,能够让大模型在相同的硬件上得到更好的训练体验。

3. 降低训练成本

减少内存使用和提高计算速度不仅提升了训练效率,还能够让研究人员和工程师在有限的硬件资源下训练更大规模的模型。特别是在大规模分布式训练时,FlashAttention 带来的性能提升能显著降低训练的时间和成本。

4. 支持长序列

对于传统的 Transformer 模型,处理长序列时存在显著的内存和计算瓶颈。FlashAttention 通过优化计算过程和内存使用,能够更有效地处理长序列,避免了传统方法中的内存溢出问题。

1. 在 PyTorch 中使用 FlashAttention

FlashAttention 通常作为一个高效的注意力模块来集成到现有的 Transformer 模型中。如果你使用的是基于 PyTorch 的 Transformer 实现,可以通过安装和配置 FlashAttention 来加速计算。

安装 FlashAttention

首先,你需要安装 FlashAttention 库。你可以通过以下命令从 GitHub 上获取它:

pip install flash-attn

2. 集成到模型中

FlashAttention 是基于 CUDA 的,可以直接集成到现有的 PyTorch Transformer 模型中。假设你使用的是一个标准的 Transformer 模型,替换掉其中的自注意力部分,使用 FlashAttention 实现:

import flash_attn

import torch

from torch import nn

class FlashAttentionModel(nn.Module):

def __init__(self, hidden_size, num_heads):

super(FlashAttentionModel, self).__init__()

self.attn_layer = flash_attn.FlashAttention(hidden_size, num_heads)

def forward(self, x):

return self.attn_layer(x)

在这个例子中,我们使用 FlashAttention 来替代传统的自注意力层,从而加速训练过程。

3. 训练和推理加速

FlashAttention 可以无缝集成到现有的训练和推理过程中,不仅能提升模型的训练速度,还能加速推理过程。在长序列的 NLP 和 CV 任务中,尤其是在 Transformer 模型中,FlashAttention 能显著减少计算时间和内存消耗。

-

大规模 Transformer 模型训练:

FlashAttention 在训练大型语言模型(如 GPT-3、BERT)和计算机视觉模型(如 ViT)时,能够有效加速训练并降低内存消耗,适用于需要处理长序列的大规模数据集。 -

长序列处理:

对于 NLP 中的长文本输入,或者 CV 中的长图像序列,传统的注意力机制计算会面临显著的性能瓶颈,而 FlashAttention 能够高效处理这些长序列任务。 -

分布式训练与推理:

FlashAttention 在多 GPU 环境下训练和推理时,能显著减少显存占用和通信开销,适用于大规模的分布式训练。 -

资源受限的环境:

在显存较小的硬件设备(如较小的 GPU 或边缘设备)上,FlashAttention 的内存优化特性能够帮助更大的模型和更长的序列得以运行。

FlashAttention 是一种针对 Transformer 模型中自注意力机制的高效实现,通过内存优化、矩阵乘法优化和精确的内存对齐等技术,极大地加速了计算过程并减少了内存需求。它特别适用于处理长序列和大规模的模型训练,可以显著提升训练效率并降低训练成本。

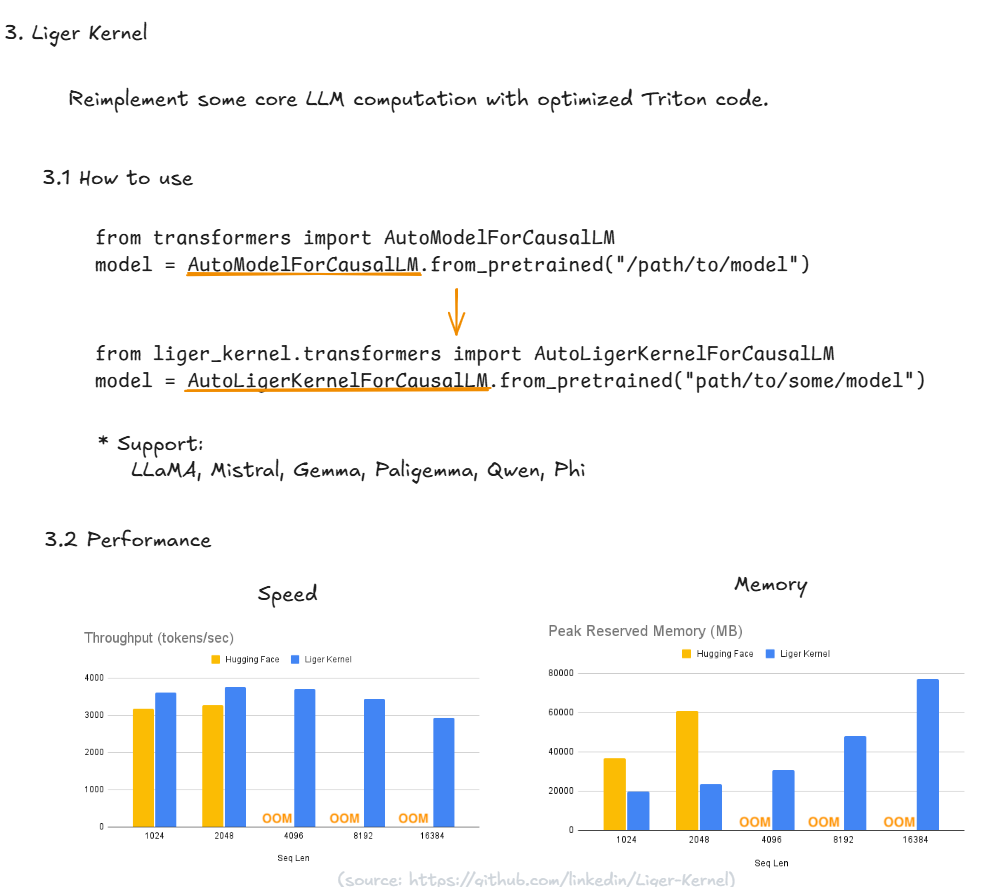

Liger Kernel 是一种为深度学习优化的计算内核(Kernel),其设计旨在提高在多处理器系统上的训练效率,尤其是在大规模数据和长序列模型(如 Transformer)处理中。Liger Kernel 是针对 注意力机制 和 矩阵乘法 等计算密集型任务优化的,旨在通过硬件加速来提升模型训练和推理的效率,特别是在利用现代 GPU 加速时。

Liger Kernel 的出现可以帮助缓解传统计算方式中出现的瓶颈,如显存瓶颈、带宽瓶颈等问题。通过专门的优化和内存管理策略,Liger Kernel 能显著提高计算效率,支持大规模深度学习模型的训练,尤其适用于诸如自然语言处理(NLP)和计算机视觉(CV)中 Transformer 和自注意力(Self-Attention)模型的训练。

📚 背景和动机

在深度学习中,特别是在 Transformer 等模型中,自注意力机制的计算是非常密集的,计算复杂度通常是 (O(N^2)),其中 (N) 是输入序列的长度。计算的主要瓶颈来源于:

- 计算瓶颈:每个查询都需要与所有的键进行点积计算,导致了矩阵计算的高计算量。

- 内存瓶颈:需要存储 (N imes N) 的注意力矩阵以及中间结果,这使得长序列时显存需求极高。

- 带宽瓶颈:传统的 GPU 内存和计算带宽的使用效率不高,尤其在数据传输和并行计算时出现延迟。

Liger Kernel 针对这些问题进行了专门的设计和优化,特别是针对 自注意力(Self-Attention) 和 矩阵乘法(Matrix Multiplication) 的加速。

Liger Kernel 通过以下几个关键技术来提升效率和加速计算:

1. 矩阵乘法优化

Liger Kernel 优化了 矩阵乘法 计算,特别是在 查询(Query) 和 键(Key) 的点积运算中,通过专门的 CUDA 内核设计来加速矩阵乘法操作。这样一来,Liger Kernel 可以高效地执行多次矩阵乘法运算,并在保持精度的同时显著减少计算时间。

2. 内存优化

Liger Kernel 利用 高效的内存管理 策略来降低 GPU 内存占用。传统的注意力机制需要为每个输入的查询和键生成一个 (N imes N) 的矩阵,并计算所有查询与键的相似度。而 Liger Kernel 则采用 分块计算(block-wise computation) 和 内存缓存(memory buffering) 技术,确保每次只计算一小部分矩阵,避免了全矩阵计算所带来的内存负担。

- 内存重用:在处理注意力矩阵时,Liger Kernel 优化了内存访问模式,最大程度地减少了对全局内存的访问。

- 局部存储优化:使用 共享内存(shared memory) 和 寄存器 来存储中间结果,减少了全局内存访问的需求,从而加快了计算过程。

3. 块处理与分块并行

Liger Kernel 通过 分块处理(block processing)来并行计算注意力矩阵。每个块对应一个小的子矩阵,Liger Kernel 会并行处理这些块,在每个 GPU 核心中执行计算任务。由于每个块的计算可以独立进行,因此有效地减少了不同 GPU 核心之间的依赖,最大化了并行计算效率。

4. 混合精度计算

为了提高计算效率并减少内存消耗,Liger Kernel 支持 混合精度计算(Mixed Precision)。通过使用 16 位浮点数(FP16) 代替 32 位浮点数(FP32) 进行计算,Liger Kernel 能减少内存占用并加快计算速度,同时保持足够的数值精度。

在很多现代 GPU 上,Tensor Cores 已经专门针对 FP16 计算进行了优化,Liger Kernel 利用这一特性进一步加速矩阵乘法和注意力计算。

5. 高效的数据流管理

Liger Kernel 优化了数据在 GPU 内的流动和存储方式,最大化了 GPU 的计算吞吐量。通过合理调度计算任务和数据访问,Liger Kernel 避免了在 GPU 内存和计算核心之间进行过多的无用数据传输,从而提高了数据传输和计算的整体效率。

1. 加速自注意力机制

Liger Kernel 通过高效的矩阵乘法优化和内存管理,显著加速了 Transformer 模型中的自注意力机制计算。在处理长序列或大规模模型时,Liger Kernel 能减少计算时间并降低显存占用,显著提升训练和推理速度。

2. 减少内存消耗

通过分块计算和内存缓存策略,Liger Kernel 有效地减少了对显存的需求,尤其在处理长序列时,可以避免内存溢出问题。这使得 Liger Kernel 在 内存受限的硬件(如高性能计算机的 GPU)上非常有用。

3. 提高计算效率

Liger Kernel 优化了数据流和内存访问,通过 块处理 和 混合精度 计算,能够利用现代 GPU 的 Tensor Cores 提升计算效率。对于深度学习任务,尤其是在大规模模型和数据集上,Liger Kernel 可以显著加速训练过程。

4. 支持长序列处理

Liger Kernel 使得处理长序列的任务变得更加高效。传统的自注意力机制在处理长序列时会面临计算和内存瓶颈,而 Liger Kernel 通过内存优化和并行计算,支持长序列的高效处理。

5. 支持分布式训练

Liger Kernel 可以和 分布式训练框架(如 PyTorch、TensorFlow 和 DeepSpeed)结合使用,以支持在多 GPU 环境中进行高效的分布式训练。通过合理的任务划分和内存管理,Liger Kernel 可以在多个 GPU 之间平衡计算负载,提高分布式训练的效率。

1. 大规模 Transformer 模型训练

Liger Kernel 适用于训练大型的 Transformer 模型,如 BERT、GPT、T5 等。这些模型通常需要处理大规模的数据和长序列,Liger Kernel 的高效计算和内存优化使得它们能够在有限的硬件资源下顺利训练。

2. 长序列任务

在许多 NLP 和 CV 任务中,长序列的处理(如长文本的处理、视频序列的分析)是常见的挑战。Liger Kernel 通过优化注意力计算,显著提高了长序列的处理能力,适用于这些任务。

3. 分布式训练与推理

Liger Kernel 支持在分布式环境中进行训练和推理。它能有效地减少每个 GPU 的计算压力,同时保证多 GPU 系统之间的高效数据传输,适合大规模分布式训练任务。

4. 边缘设备和资源受限环境

由于 Liger Kernel 的内存优化特性,它非常适合在 边缘计算设备 或 GPU 显存有限的环境 中运行。尤其在处理较大模型或复杂任务时,Liger Kernel 能在资源有限的情况下高效运行。

Liger Kernel 是针对深度学习中自注意力机制优化的计算内核,旨在解决传统自注意力计算中面临的内存和计算瓶颈。通过矩阵乘法优化、内存管理、块处理、混合精度计算等技术,Liger Kernel 能显著提升计算效率,降低内存占用,支持大规模和长序列的深度学习任务。

它的优势包括加速 Transformer 模型训练、减少内存消耗、提高计算效率、支持分布式训练等,特别适用于 NLP、CV 等任务中的长序列处理和大规模模型训练。

量化(Quantization) 是深度学习中的一种技术,旨在通过将模型的高精度参数(如权重、激活值等)转换为低精度格式,从而降低模型的内存占用和计算开销,同时尽量保持模型的性能。量化通常应用于 模型压缩(Model Compression) 和 推理加速,尤其是在边缘设备或资源受限的环境中(如移动设备、嵌入式设备等)。

量化的核心目标是减少模型的存储需求和计算复杂度,以便在不显著影响精度的情况下加速模型的推理过程。

🎯 量化的目的和动机

-

减少存储需求:

- 模型的存储需求通常是基于 浮点数(Floating-point) 存储格式,尤其是 32 位浮点数(FP32)。每个参数需要 4 字节来存储。而 8 位整数(INT8) 或更低精度的格式只需要 1 字节,从而显著减少内存占用。

-

加速计算:

- 低精度计算(如使用 INT8 或 FP16)能够利用现代硬件(如 GPU 或专用的推理加速器)的高效计算单元,减少计算所需的时间,进而提高推理速度。

-

提高能源效率:

- 低精度计算可以减少硬件在计算过程中的能耗,这对于移动设备和其他低功耗设备至关重要。

-

降低硬件要求:

- 低精度运算不仅能够在普通的 CPU 或 GPU 上加速计算,还能使得模型在专用硬件(如 TPU、NPU、FPGA 等)上运行时更加高效。

🔥 量化的类型

量化可以在不同的粒度上进行,包括 权重量化(Weight Quantization)、激活量化(Activation Quantization) 和 梯度量化(Gradient Quantization),每种量化方式有不同的应用和效果。

1. 权重量化(Weight Quantization)

权重量化 是量化最常见的类型,目标是将模型的 权重参数 从高精度浮点数转换为低精度的整数或定点数。最常见的量化格式是 INT8(8 位整数)。

- INT8 权重量化:将 32 位浮点数权重压缩为 8 位整数(1 字节),从而减少存储需求。

- 方法:可以采用 对称量化 或 非对称量化。

- 对称量化:量化时采用相同的比例因子(scaling factor)对输入和输出进行缩放。

- 非对称量化:采用不同的比例因子,适用于处理零点(zero point)不是对称的情况。

2. 激活量化(Activation Quantization)

激活量化 是指对 激活值(即经过网络各层的输入数据)进行量化。激活量化通常是在推理阶段进行的,因为训练时保持浮点数的精度有助于优化模型。

- 方法:激活量化和权重量化类似,也可以采用 INT8 或 FP16 等低精度格式。常见的激活量化方法包括对称量化、非对称量化等。

3. 梯度量化(Gradient Quantization)

梯度量化 主要用于训练过程中,通过将 梯度 转换为低精度格式来节省内存和计算资源。梯度量化的目的是在保持训练精度的情况下减少对内存的需求,尤其是在分布式训练时可以显著降低通信开销。

- 方法:类似于权重量化,常见的量化方法包括 INT8 和 FP16。

4. 全面量化(Full Quantization)

全面量化 是同时量化 权重、激活 和 梯度 等所有部分。它需要更多的精度控制,通常在推理时进行。

🧑💻 量化的过程

量化通常包括以下几个步骤:

-

量化训练(Quantization-Aware Training, QAT)

- 量化训练是指在训练过程中加入量化的过程,模拟量化对模型的影响,从而在训练阶段就适应量化带来的误差。

- QAT 通常能获得更好的精度,因为它让模型在训练过程中逐步调整,以便在量化后仍保持良好的性能。

- QAT 的训练过程会模拟低精度运算的影响,从而使得量化后的模型尽可能保持与全精度模型相近的精度。

-

后处理量化(Post-Training Quantization, PTQ)

- 后处理量化 是在训练完成后对模型进行量化。该方法不需要重新训练,适合已经训练好的模型。

- 后处理量化的步骤包括:

- 计算每个层的最大值(或均值)并找到量化的 比例因子(scale)。

- 对权重和激活进行量化,转换为低精度格式。

- 进行 误差校正,以补偿量化带来的精度损失。

-

混合精度量化(Mixed Precision Quantization)

- 这种方法结合了不同位宽的量化技术。比如,对于权重使用 INT8 量化,而对于某些层的激活使用 FP16。

- 这种方法能在保持精度的同时,进一步优化计算性能。

🚀 量化的挑战与解决方案

尽管量化能够带来显著的存储和计算效率提升,但它也面临一些挑战:

-

精度损失:将高精度的浮点数转换为低精度整数可能导致模型精度下降,特别是在对模型进行激烈量化时。

- 解决方案:量化训练(QAT)通过模拟低精度运算的影响,帮助模型在量化过程中保留精度。

-

硬件支持:低精度计算(如 INT8)依赖于硬件的支持,尤其是在推理加速器(如 TPU、NPU)上,这些硬件往往会对低精度计算进行优化。

- 解决方案:许多深度学习框架和硬件加速器(如 NVIDIA Tensor Cores、Google TPUs)已经针对低精度计算提供了优化支持。

-

量化精度控制:量化后的模型可能会有一定的精度损失,尤其是在权重和激活的量化精度选择上。

- 解决方案:采用混合精度量化(Mixed Precision Quantization)技术,针对不同模型组件使用不同的量化精度,从而平衡效率和精度。

-

推理加速:

- 在推理阶段,量化可以显著提高计算效率,尤其是在低功耗设备上,如 智能手机、嵌入式设备、物联网设备 等。通过量化,推理速度可以大幅提升,且能降低功耗。

-

边缘计算:

- 在资源受限的边缘设备上(如移动设备、智能摄像头等),量化可以减小模型的存储需求,并加速计算,帮助实现 实时推理。

-

大规模模型部署:

- 对于大规模的深度学习模型(如 GPT-3、BERT 等),量化能够使得模型在 云端 或 数据中心 的大规模部署中变得更加高效,减少带宽消耗和存储占用。

-

节省硬件资源:

- 对于训练过程中使用的高精度浮点数权重,量化后能够显著减少存储和计算需求,帮助节省硬件资源,尤其是在 云计算 环境中。

1. TensorFlow 量化

TensorFlow 提供了 TensorFlow Lite 这一工具,专门用于在移动端和嵌入式设备上进行模型量化。

- 后处理量化:使用

tf.lite.TFLiteConverter进行量化。 - 量化训练:使用

tfmot.quantization.keras进行量化感知训练(QAT)。

import tensorflow as tf

from tensorflow import keras

# 加载模型

model = keras.models.load_model('my_model')

# 后处理量化

converter = tf.lite.TFLiteConverter.from_keras_model(model)

converter.optimizations = [tf.lite.Optimize.DEFAULT]

tflite_model = converter.convert()

# 保存量化后的模型

with open('model_quantized.tflite', 'wb') as f:

f.write(tflite_model)

2. PyTorch 量化

PyTorch 提供了 torch.quantization 模块来支持量化,包括 后处理量化 和 量化感知训练(QAT)。

- 后处理量化:

import torch

import torch.quantization

# 加载模型

model = torch.load('my_model.pth')

# 使用后处理量化

model.eval()

model.qconfig = torch.quantization.get_default_qconfig('fbgemm')

torch.quantization.prepare(model, inplace=True)

torch.quantization.convert(model, inplace=True)

# 保存量化后的模型

torch.save(model, 'model_quantized.pth')

量化 是深度学习中的一种关键技术,通过降低模型的精度来减小内存占用、加速计算,并提高能源效率。它主要用于 推理加速 和 模型压缩,尤其在边缘设备和资源受限环境中具有重要意义。量化技术包括 后处理量化(PTQ) 和 量化感知训练(QAT),每种方法有不同的应用场景和精度控制技巧。

随着硬件的发展,量化成为了深度学习模型部署和推理加速中的一个重要工具,能够让大规模深度学习模型更高效地运行在各种设备上。