目录

一、引言:为什么选择Transformer模型

(一)从RNN到Transformer:NLP的“效率革命”

(二)初学者的“友好型”学习工具

(三)四步带你掌握Transformer

二、本项目用到的所有算法

(一)Transformer 编码器核心算法(模型核心)

1.1 多头自注意力(Multi-Head Self-Attention)

算法功能

代码对应

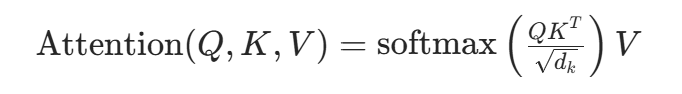

数学原理与公式推导

(1)注意力的本质:加权求和

(2)多头注意力的拆分与合并

(3)代码实现细节

1.2 前馈网络(Feed-Forward Network, FFN)

算法功能

代码对应

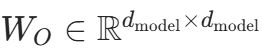

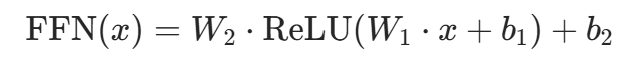

数学公式

1.3 可学习位置编码(Learned Positional Embedding)

算法功能

代码对应

数学原理

与正弦位置编码的区别

(二)文本预处理算法(数据清洗)

2.1 去特殊字符(正则匹配)

算法功能

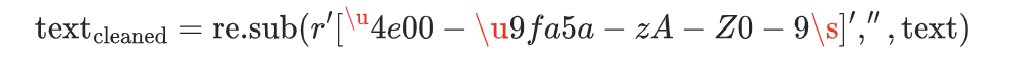

数学 / 逻辑表达

代码对应

2.2 文本去重(基于字典键唯一性)

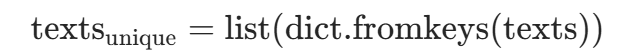

算法功能

算法原理

代码对应

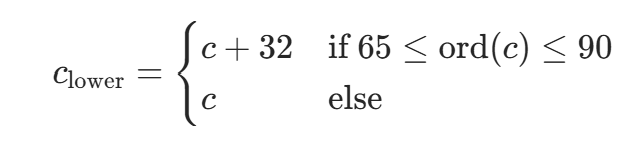

2.3 小写转换(字符标准化)

算法功能

算法原理

代码对应

(三)词向量分析算法(可视化与聚类)

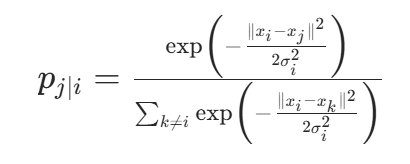

3.1 TSNE 降维(t-Distributed Stochastic Neighbor Embedding)

算法功能

代码对应

数学原理与推导

3.2 KMeans 聚类

算法功能

代码对应

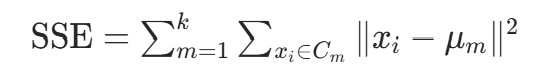

数学原理与迭代过程

代码实现细节

(四)语言建模与优化算法(模型训练)

4.1 交叉熵损失(语言建模损失)

算法功能

代码对应

数学公式与推导

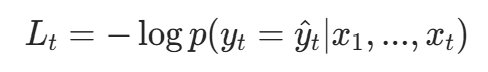

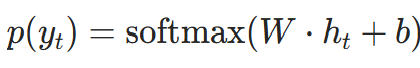

(1)单样本损失

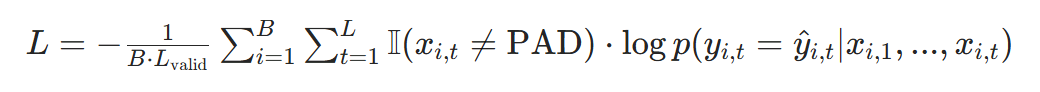

(2)批量平均损失

(3)代码实现

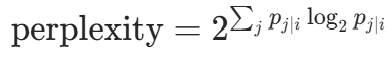

4.2 困惑度(Perplexity,PPL)

算法功能

代码对应

数学公式与推导

代码逻辑

4.3 AdamW 优化器

算法功能

代码对应

数学公式与推导

超参数

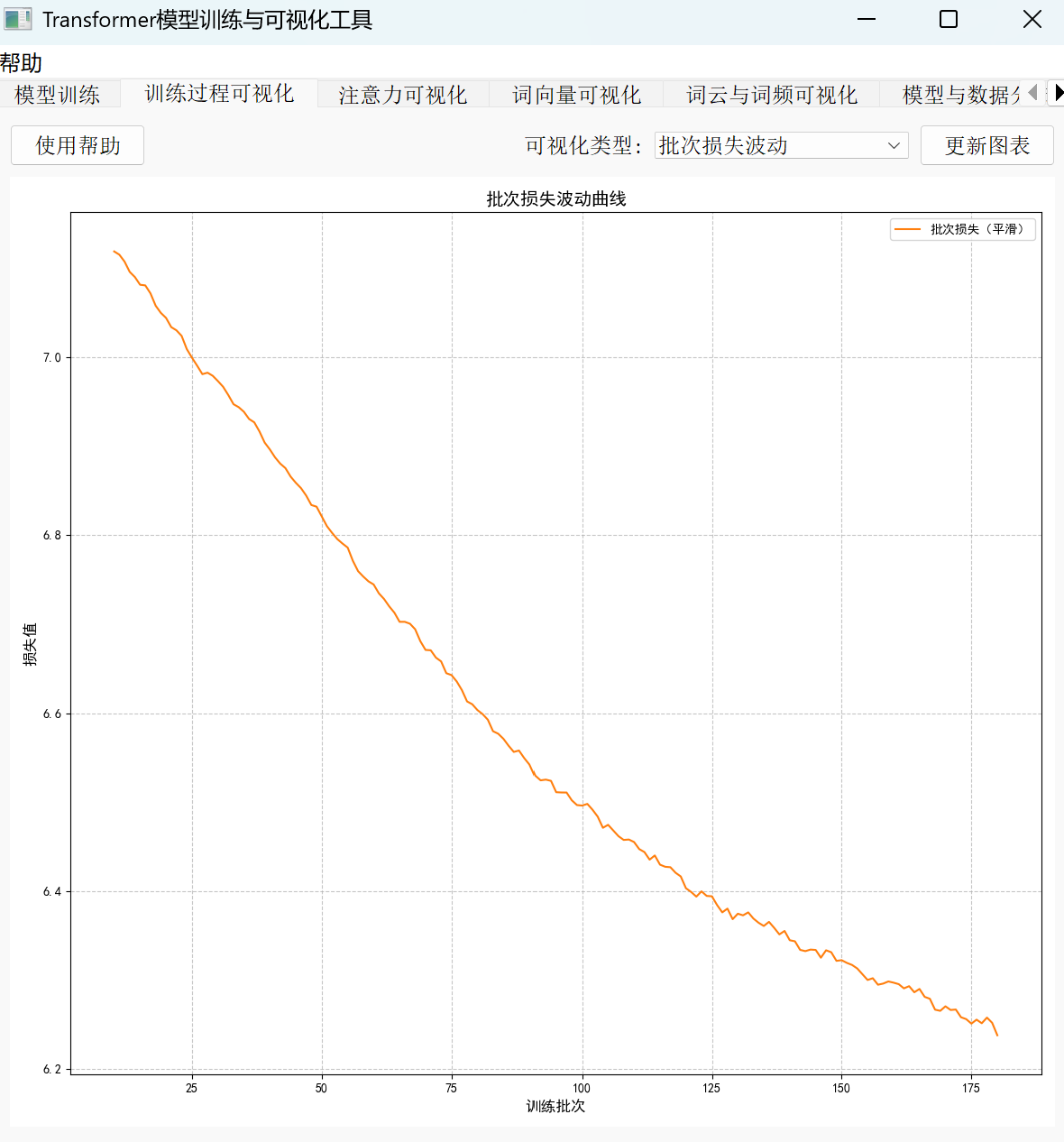

4.4 学习率调度(ReduceLROnPlateau)

算法功能

代码对应

算法逻辑

(五)相似度计算算法(句子与 Token 分析)

5.1 句子相似度(余弦相似度)

算法功能

代码对应

数学公式与推导

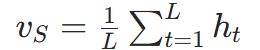

(1)句向量计算

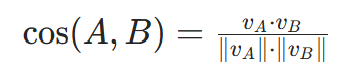

(2)余弦相似度

代码实现

5.2 Token 重要性计算

算法功能

代码对应

数学公式

代码实现

三、Transformer模型架构解析

(一)自定义多头注意力机制

(二)Transformer编码层设计

1.核心子层:信息处理的“双引擎”

2.稳定机制:残差连接与层归一化的“双重保障”

(三)完整模型结构整合

四、数据处理与预处理实战

(一)文本预处理核心步骤

第一步:去除特殊字符——给文本“去泥沙”

第二步:文本去重——挑出“腐烂叶片”

(二)SentencePiece分词器实现

1.子词为何更适合NLP模型?

2.SentencePiece实战三步流程

3.从“苹果”看子词切分逻辑

(三)数据集构建与特征提取

1.从文本到张量:数据预处理的核心步骤

2.数据驱动的参数调整:用统计结果指导决策

五、模型训练实战指南

(一)低内存训练优化策略

(1)三大核心优化策略,让普通电脑也能跑起来

(2)避坑指南:从“内存溢出”到“顺畅训练”

(二)多任务训练目标设计

1.为什么要结合LM与POS任务?

2.双任务训练的损失加权策略

3.多任务训练的直观优势

(三)学习率调度与训练监控

1.用ReduceLROnPlateau实现“智能减速”

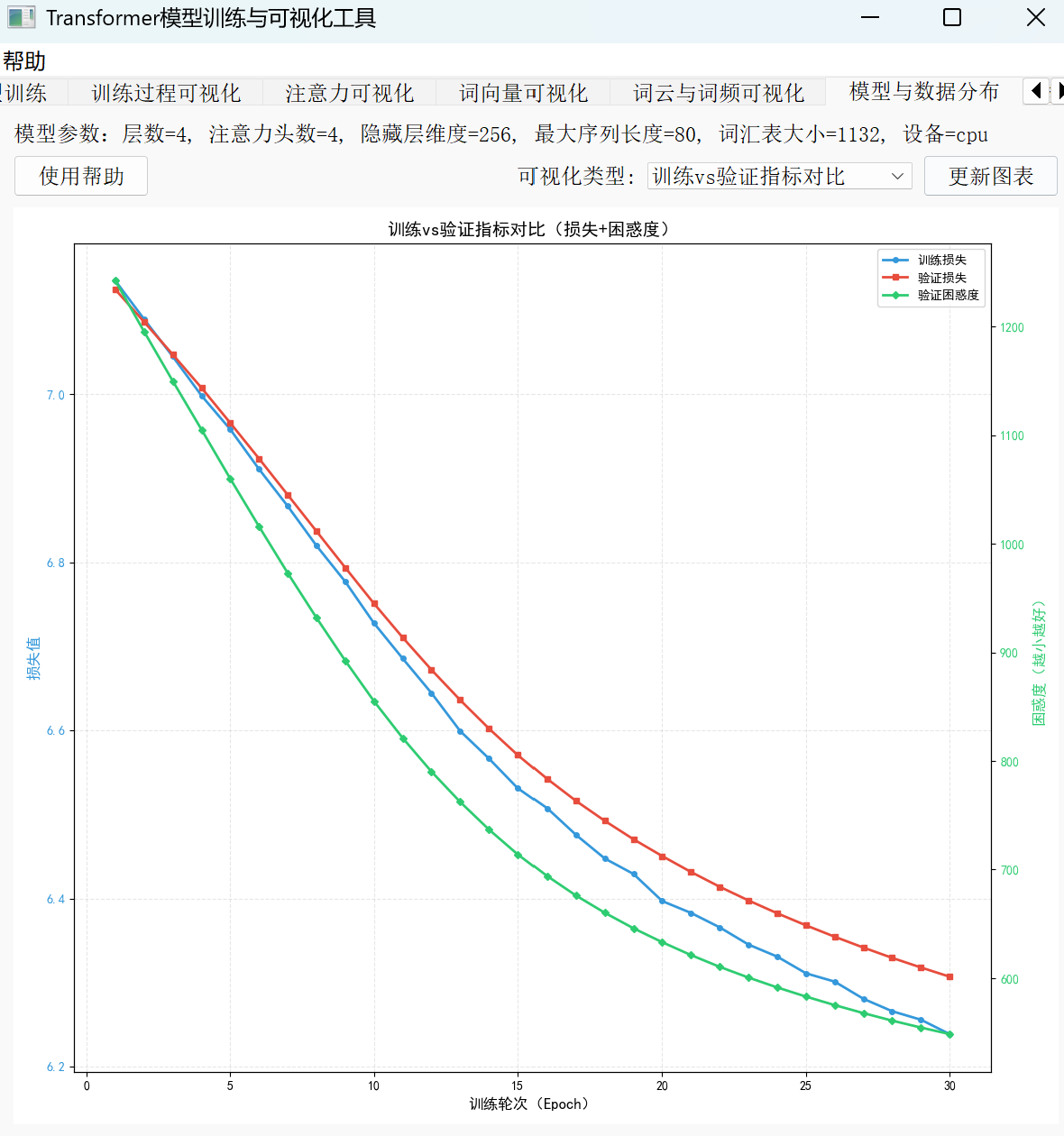

2.训练监控:三个关键“仪表盘”

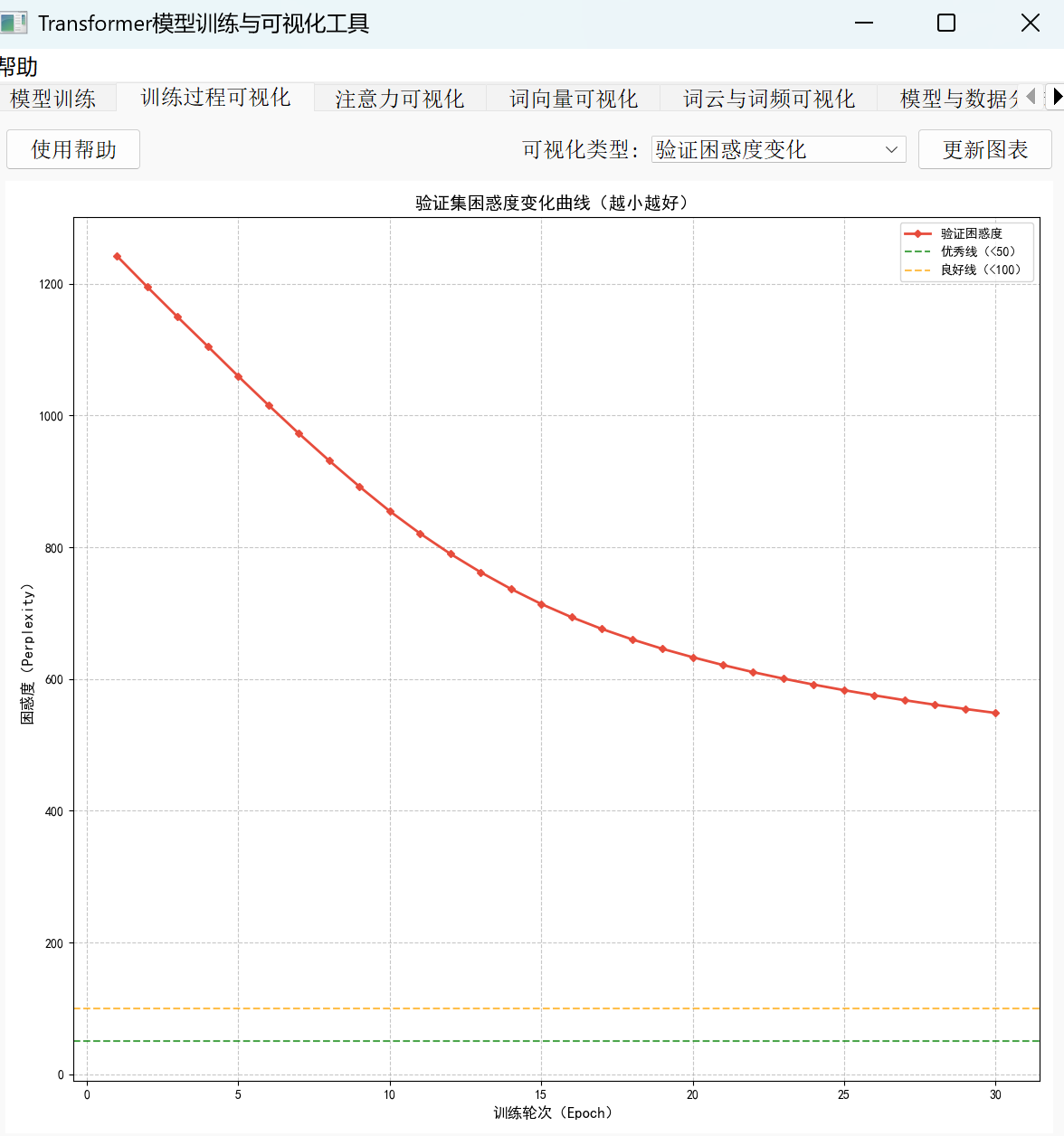

(四)性能评估指标:困惑度解读

六、可视化分析工具详解

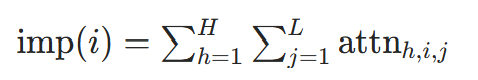

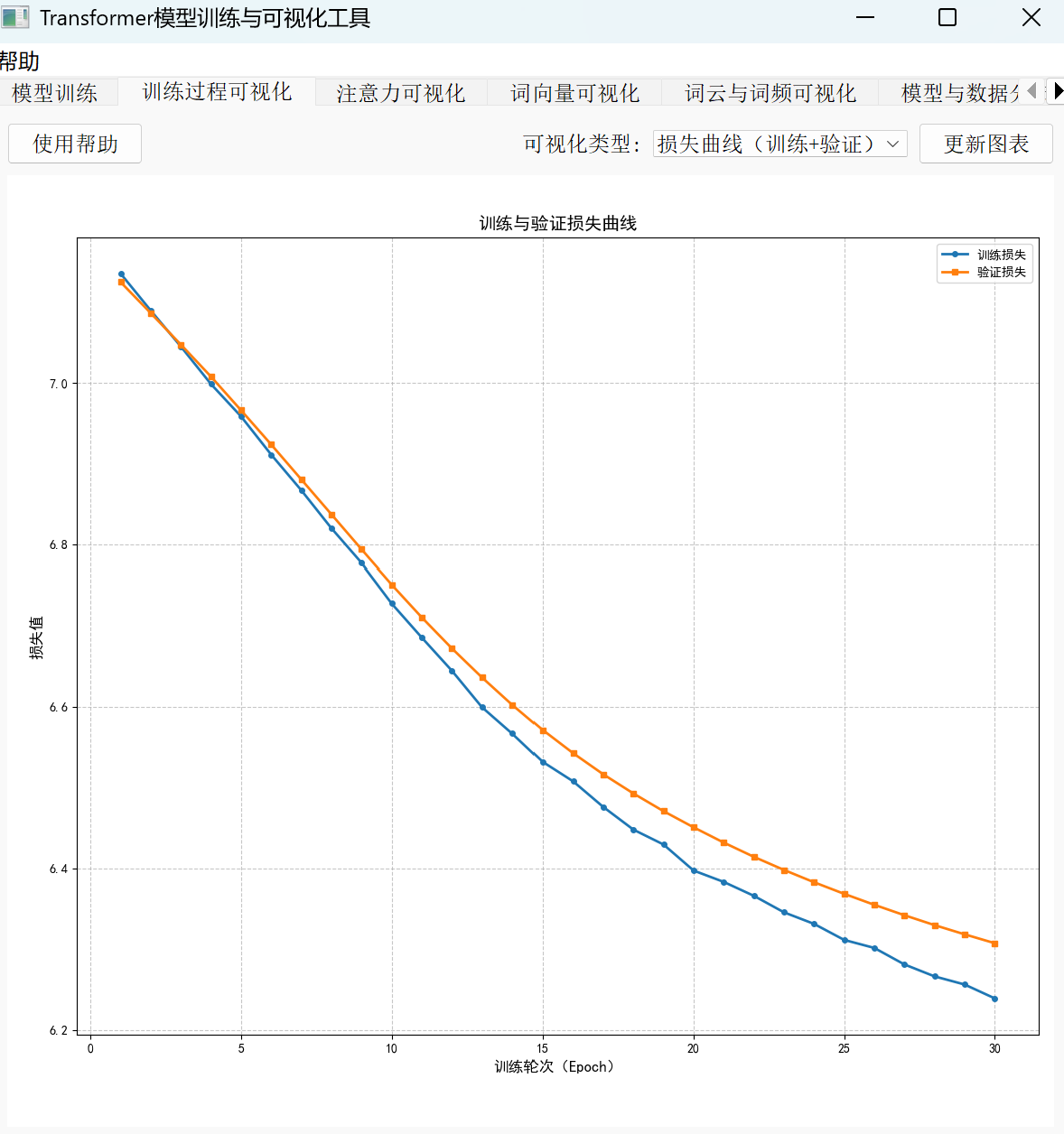

(一)训练过程动态监控

1.三大“体验指标”的作用

2.实战诊断:从图表异常到解决方案

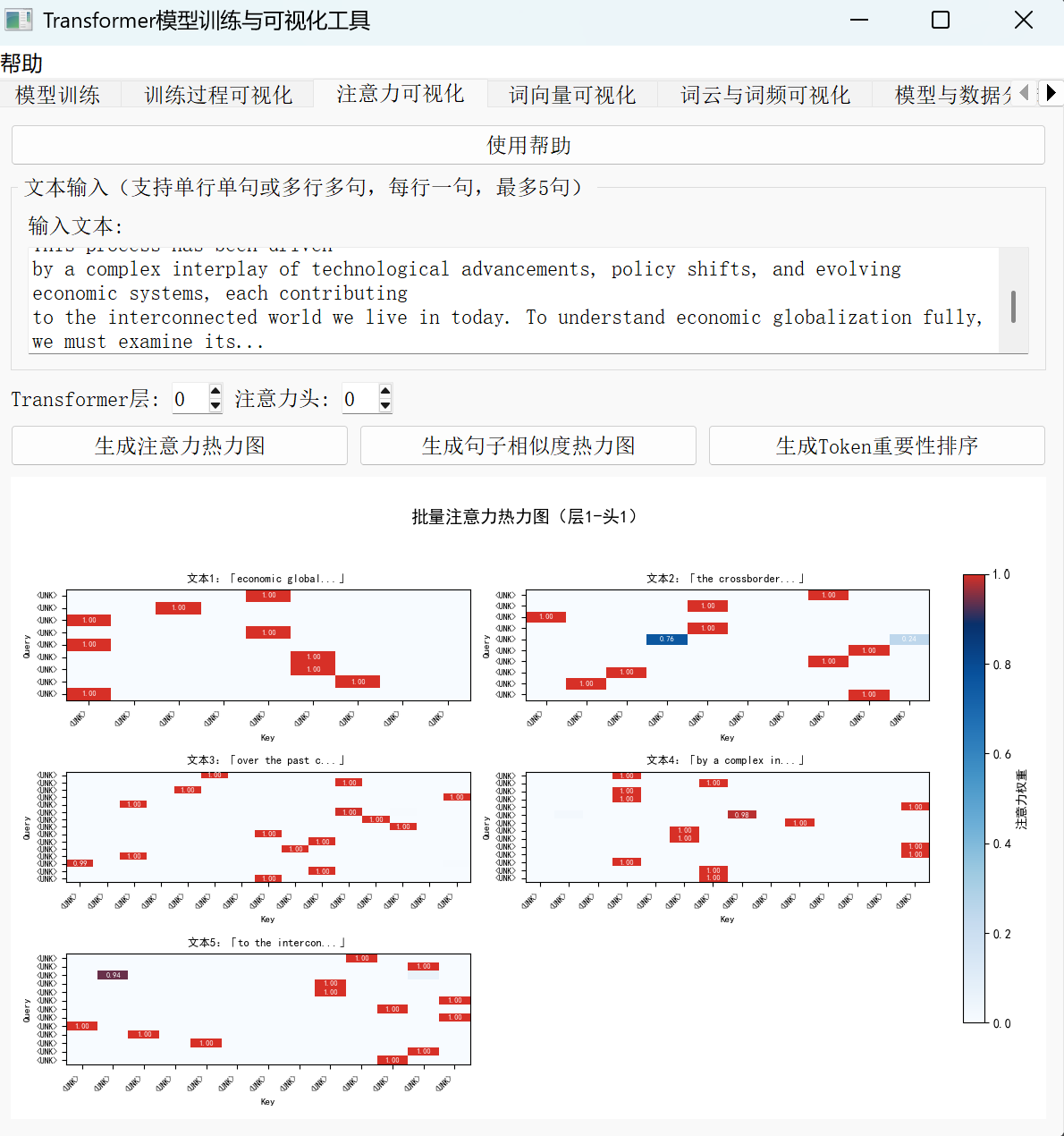

(二)注意力机制可视化

1.热力图:看穿注意力头的“关注点”

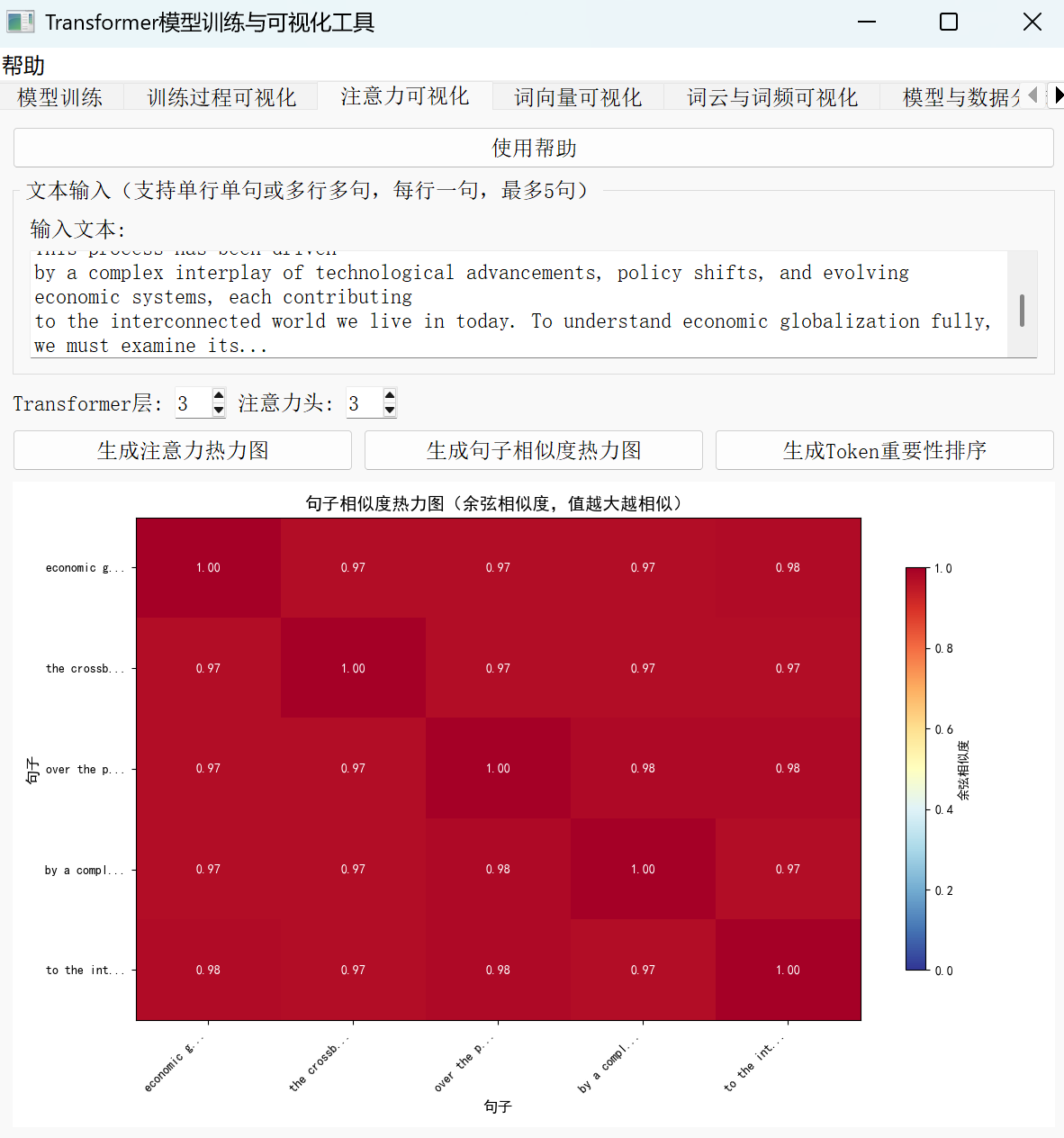

2、句子相似度热力图:用颜色“读”懂关联

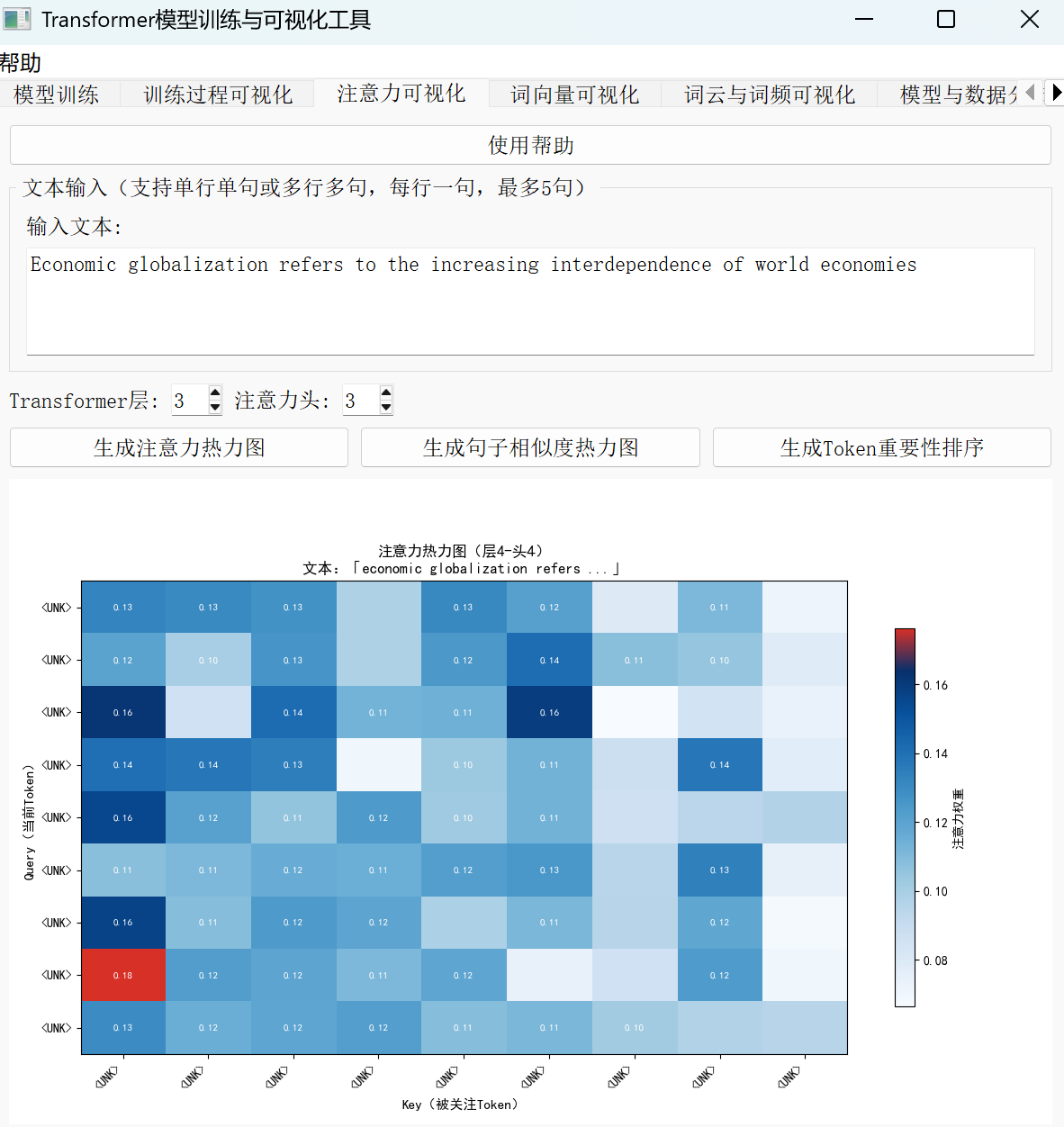

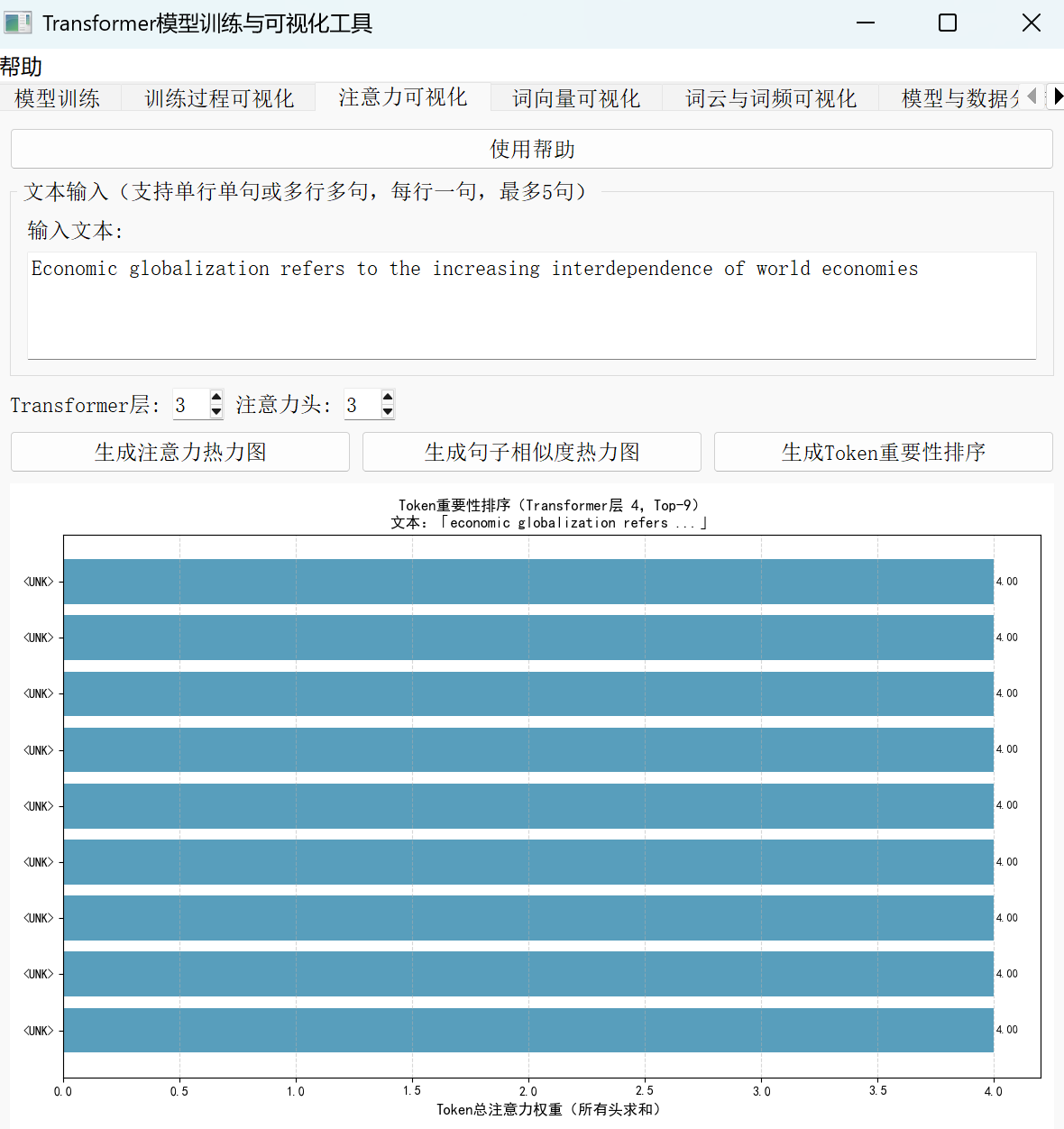

3.Token 重要性排序:找到“关键词中的关键词”

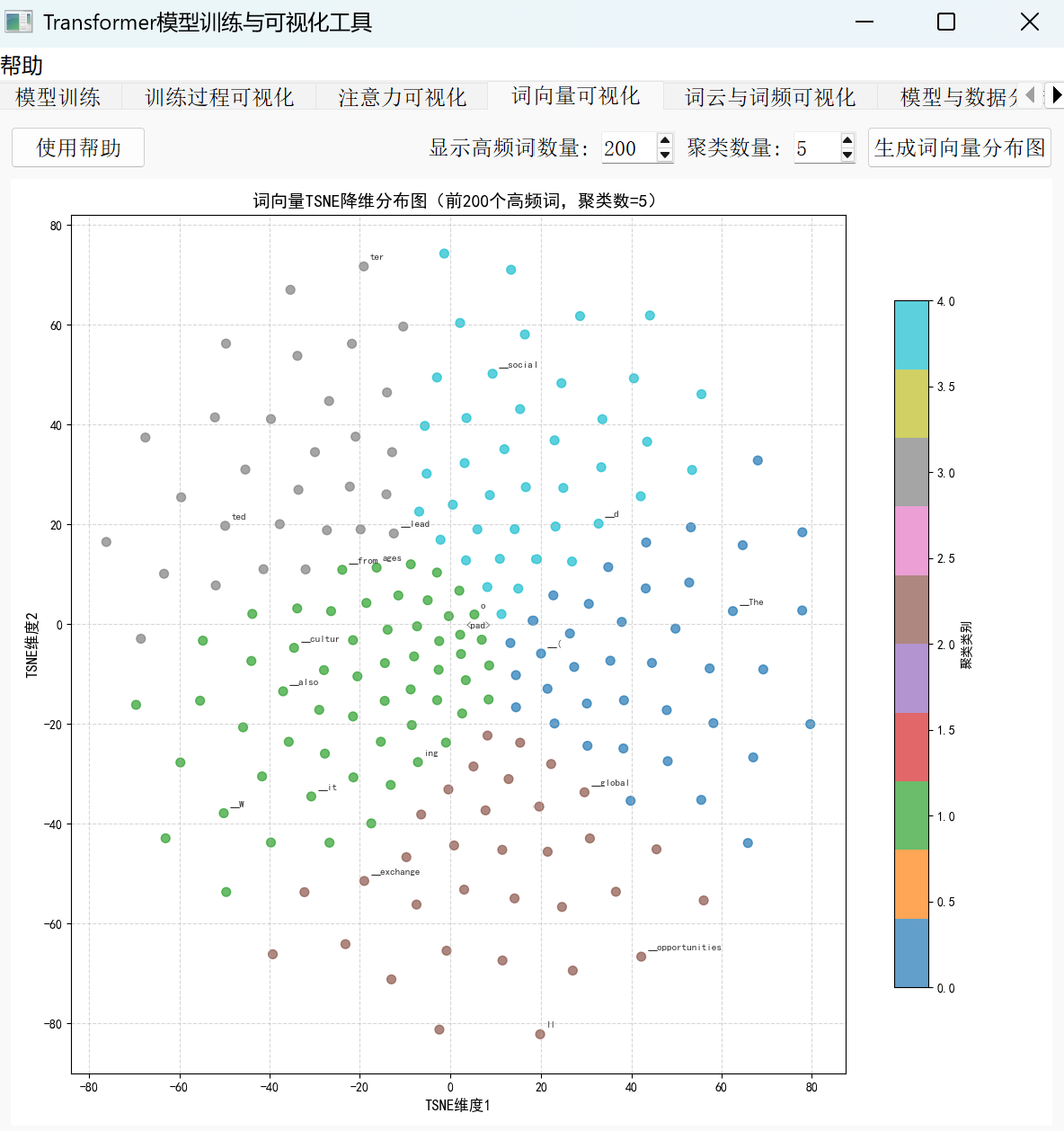

(三)词向量空间分布分析

(四)文本特征统计与分析

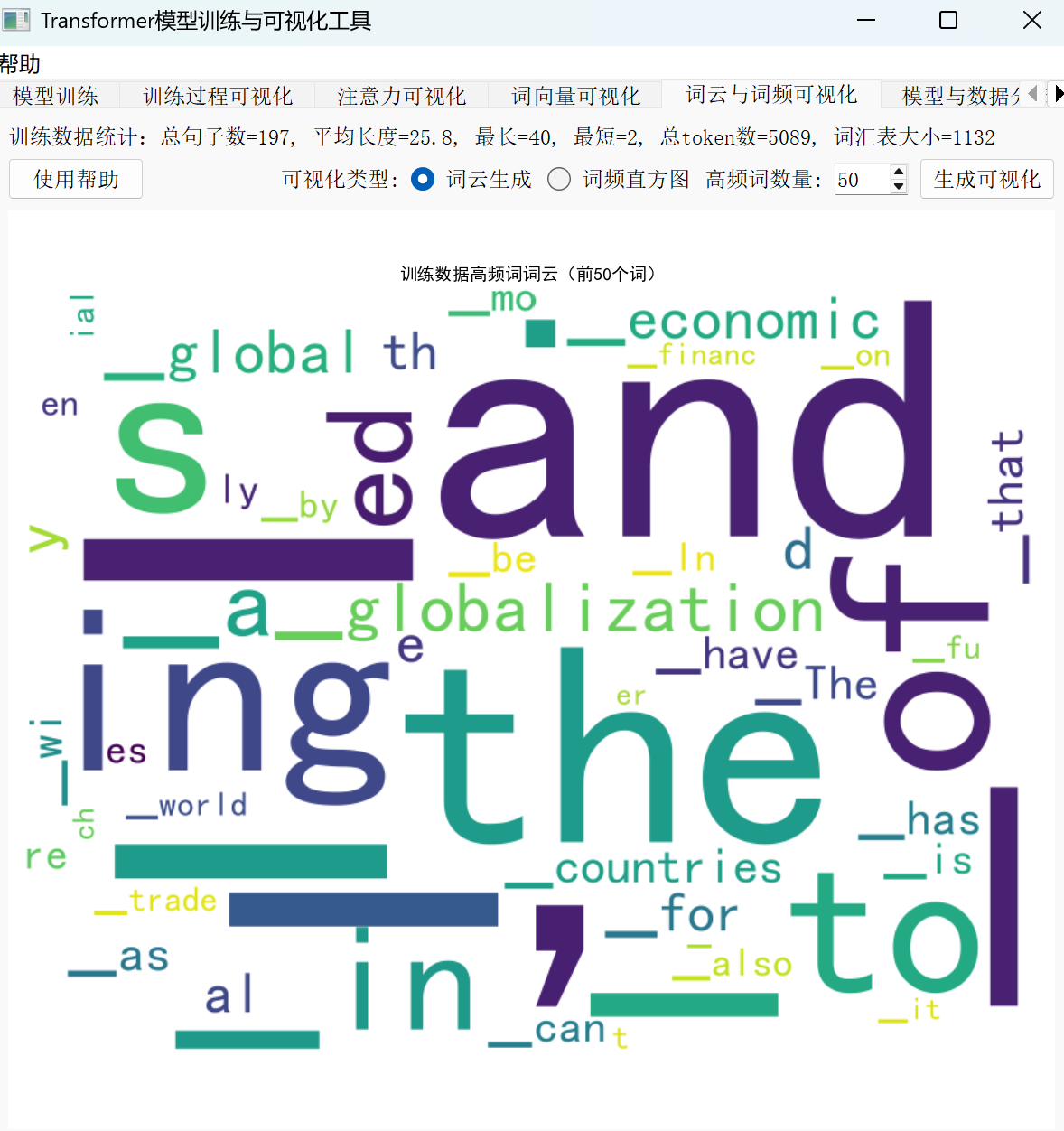

1.词云:数据的“高频指纹”

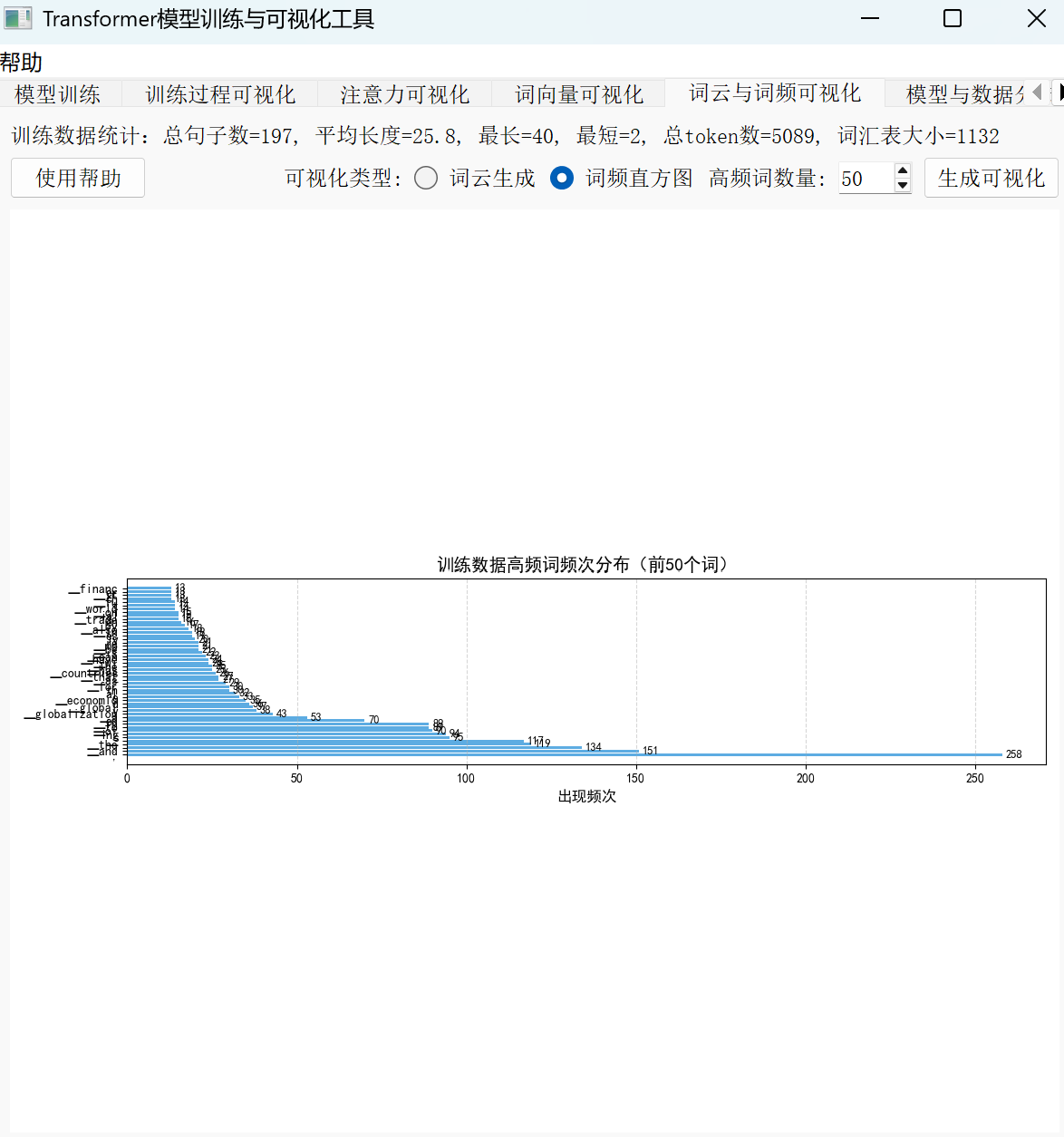

2.词频直方图:从“直观”到“精确”的跨越

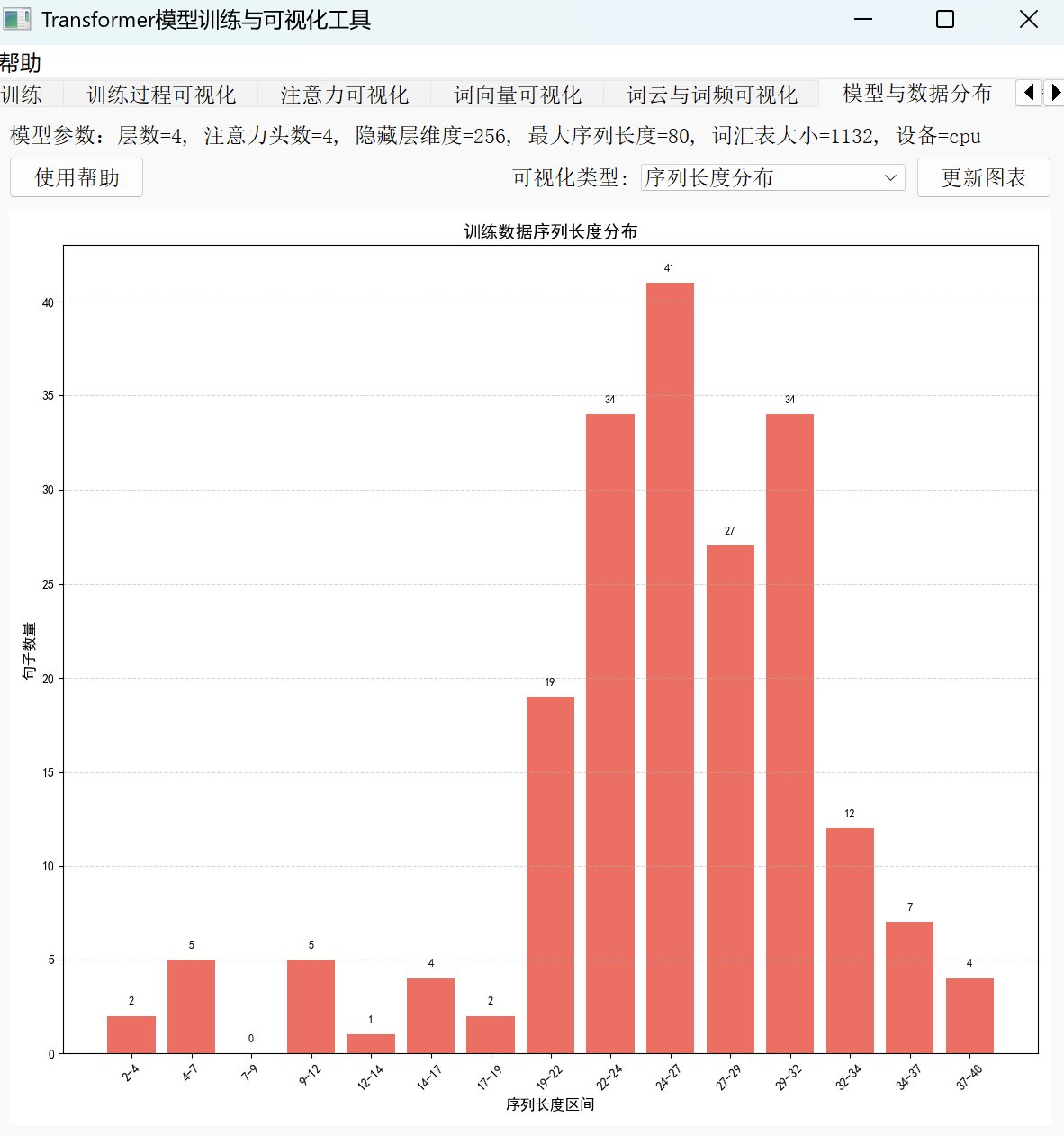

3.序列长度分布:模型参数的“导航仪”

七、注意事项与常见问题

(一)内存限制与优化方案

1.阶梯式参数调整策略

2.内存自动清理与实战口诀

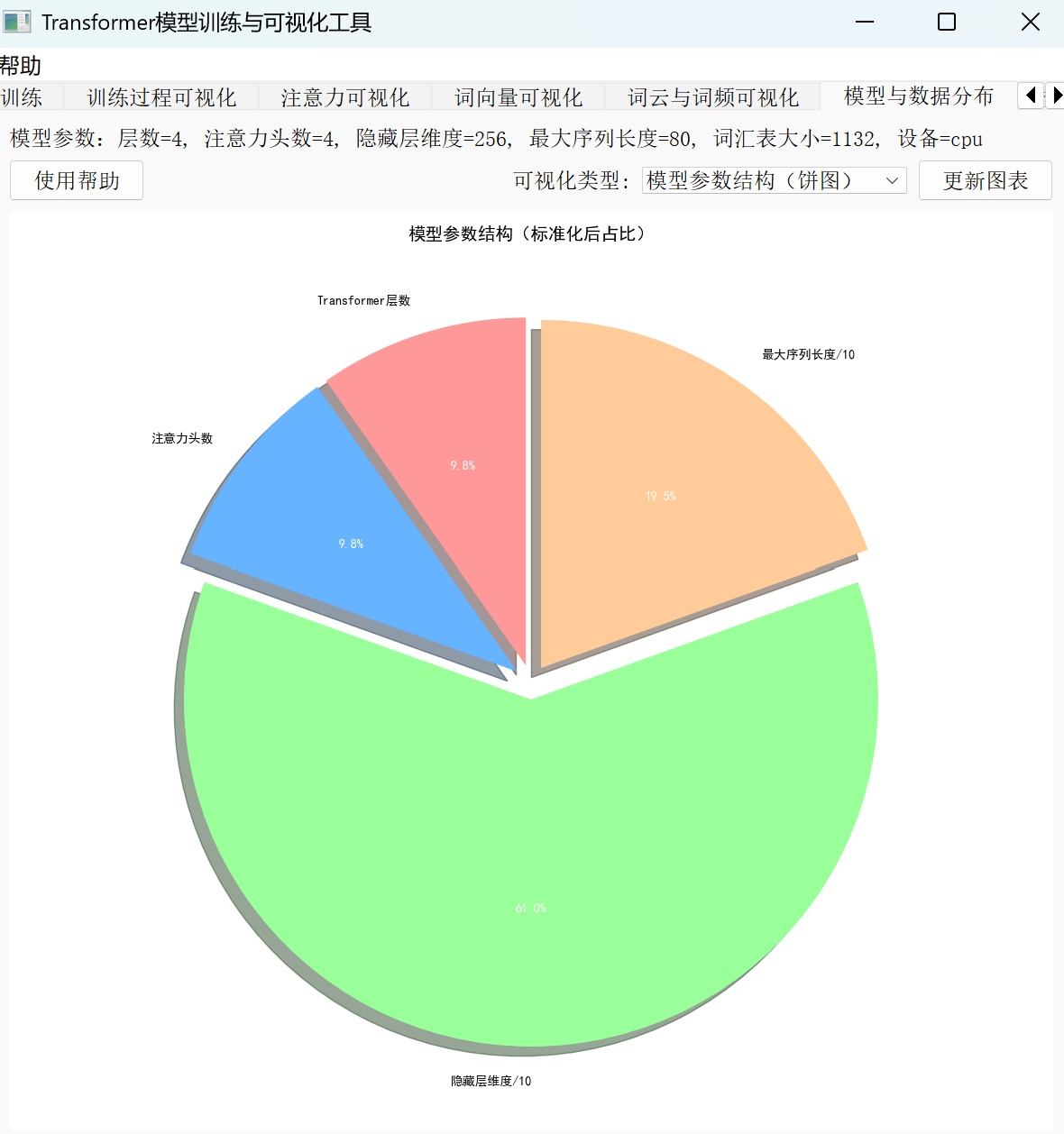

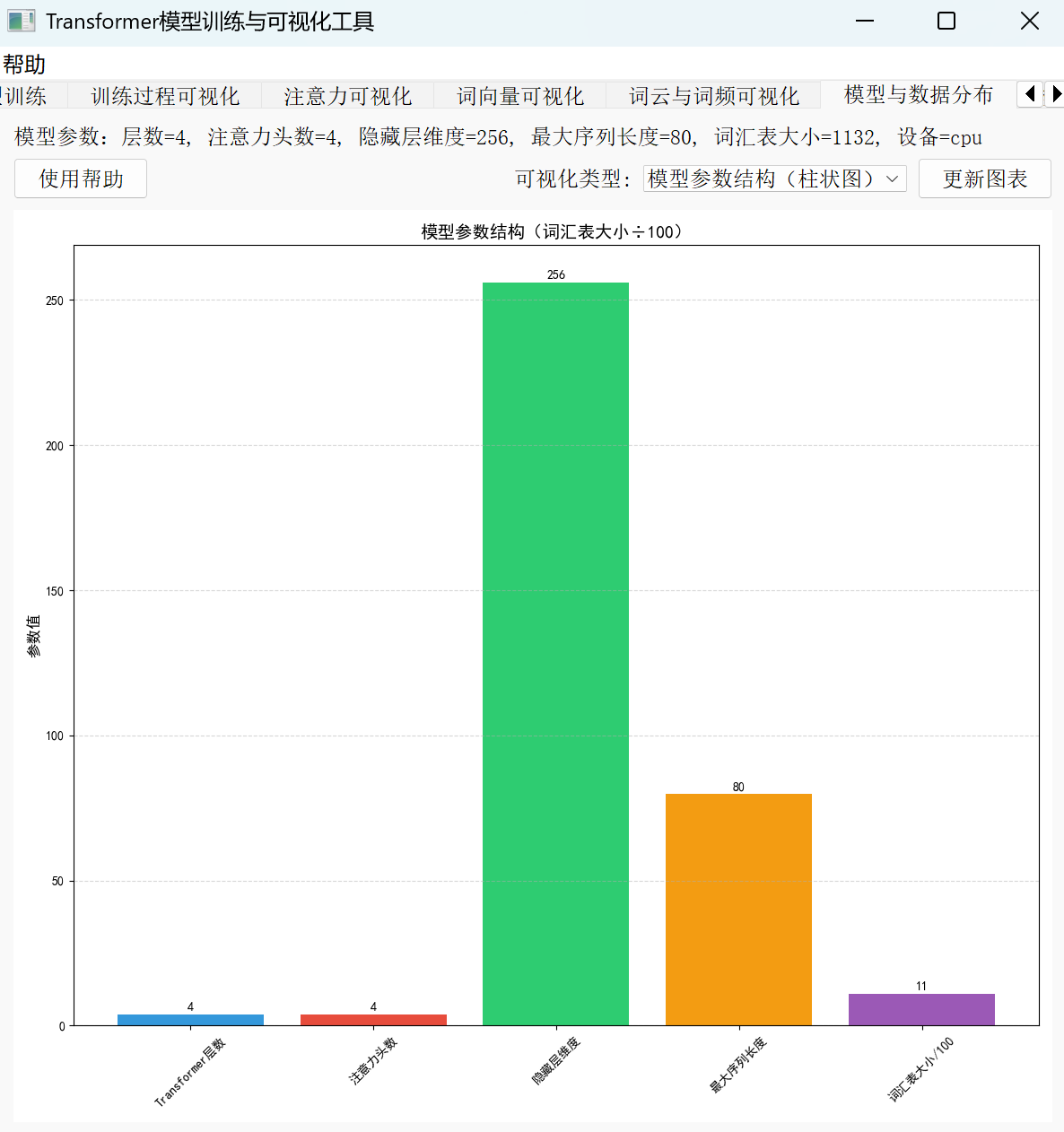

(二)参数选择关键原则

八、常见技术问题解答

1. 模型效果评估应该关注什么指标?

2. 加载模型时提示文件缺失怎么办?

3. 可视化界面没有数据显示?

4. 生成中文词云或文本时出现乱码?

九、Transformer模型训练与可视化工具的Python代码完整实现

十、程序运行截图部分展示

十一、训练语料库的示例

十二、总结与未来展望

你是否曾好奇 AI 如何理解语言?当你在聊天框输入问题时,机器如何瞬间“读懂”你的意图并给出回应?当 Siri 帮你设置闹钟、ChatGPT 生成文案时,背后其实藏着 NLP(自然语言处理)技术的不断进化。而在这场进化中,Transformer 模型的出现,就像给 AI 装上了“语言理解的引擎”,彻底改变了机器处理文本的方式。

(一)从RNN到Transformer:NLP的“效率革命”

在 Transformer 诞生前(2017 年),NLP 领域的主流是 RNN(循环神经网络)及其改进版 LSTM(长短期记忆网络)。这些模型通过“逐词处理”的方式分析文本,就像我们逐字阅读一句话——虽然能捕捉上下文关系,但效率极低:

• 速度瓶颈:必须按顺序处理单词,无法并行计算,训练一个模型可能需要数周时间;

• 记忆缺陷:面对长文本(如一篇文章),早期单词的信息会逐渐“遗忘”,就像我们记不住长篇故事的开头细节;

• 硬件门槛:即使优化后,仍需要高性能 GPU 支持,普通开发者难以触及。

而 Transformer 模型的革命性突破,正是解决了这些痛点。它引入“注意力机制”——让机器像人类阅读时一样,能同时关注句子中的关键信息(比如“猫追老鼠”中,重点是“猫”和“老鼠”的关系),而非逐词爬行。这不仅让并行计算成为可能(训练速度提升 10 倍以上),还能完美捕捉长文本中的语义关联,成为如今 ChatGPT、BERT、GPT 等大模型的“技术基石”。

(二)初学者的“友好型”学习工具

尽管 Transformer 如此重要,但很多初学者会望而却步:“是不是需要高端显卡?代码实现会不会太复杂?”其实,现在你完全可以在普通电脑上入门——本文将基于轻量级 Transformer 训练与可视化工具展开教学,它的核心优势在于:

零基础友好特性

✅ 无需高端 GPU,普通 CPU 即可流畅运行

✅ 低内存环境适配,笔记本电脑也能轻松训练

✅ 内置可视化分析功能,让“黑箱模型”变透明

(三)四步带你掌握Transformer

我们将通过“原理-实现-训练-可视化”的渐进式路径,帮你从零构建可解释的 Transformer 模型:

1. 原理拆解:先系统介绍本项目用到的所有算法,再用生活化例子解释“注意力机制”“多头注意力”等核心概念,让抽象的数学原理变得通俗易懂;

2. 代码实现:提供完整的 Python 代码,从 0 搭建基础模型结构,在Python3.12的环境下就能成功运行;

3. 训练全流程:详解数据预处理、参数设置、模型调优技巧,即使是 8GB 内存电脑也能跑通;

4. 可视化工具:通过工具直观展示注意力权重分布——比如模型如何“关注”句子中的关键词,让抽象概念看得见、摸得着。

无论你是 AI 爱好者、学生,还是想转行 NLP 的开发者,这篇指南都能帮你跨过“Transformer 门槛”。接下来,让我们一起揭开这个“语言理解引擎”的神秘面纱吧!

(一)Transformer 编码器核心算法(模型核心)

代码中TransformerModel类实现了仅编码器结构的 Transformer,核心包含「多头自注意力」和「前馈网络」两大模块,是语言建模的基础。

1.1 多头自注意力(Multi-Head Self-Attention)

算法功能

捕捉文本中 Token 间的依赖关系(如 “自然语言” 与 “处理” 的关联),通过多组注意力头并行学习不同类型的依赖(语法、语义等)。

代码对应

CustomMultiheadAttention类,核心逻辑:Q/K/V 投影→缩放点积注意力→多头合并。

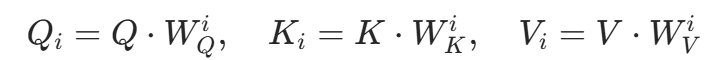

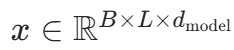

数学原理与公式推导

(1)注意力的本质:加权求和

注意力机制通过 “查询(Query)” 对 “键(Key)” 计算相似度,得到权重后对 “值(Value)” 加权求和,公式为:

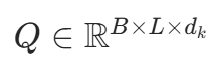

:查询矩阵(Batch 大小 × 序列长度 × 头维度)

:查询矩阵(Batch 大小 × 序列长度 × 头维度) :键矩阵

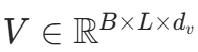

:键矩阵 :值矩阵(通常dk=dv)

:值矩阵(通常dk=dv) :单个注意力头的维度,缩放因子

:单个注意力头的维度,缩放因子 用于避免

用于避免 数值过大导致 softmax 梯度消失。

数值过大导致 softmax 梯度消失。

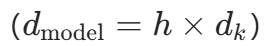

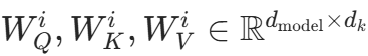

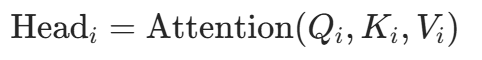

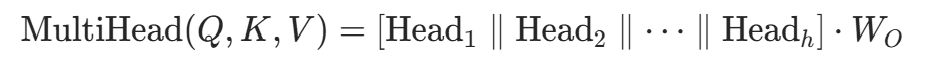

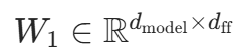

(2)多头注意力的拆分与合并

为并行学习多类型依赖,将Q/K/V拆分为h个注意力头,每个头独立计算注意力,最后合并结果:

-

投影与拆分:通过线性层将输入投影到

维度

维度 ,再按头拆分:

,再按头拆分: 其中

其中 是第i个头的投影矩阵(代码中通过

是第i个头的投影矩阵(代码中通过q_proj/k_proj/v_proj实现,统一投影后拆分维度)。 -

单头注意力计算:每个头独立执行缩放点积注意力:

-

多头合并:将h个头部结果拼接,通过输出投影层得到最终结果:

其中

其中 是输出投影矩阵(代码中

是输出投影矩阵(代码中out_proj层)。

(3)代码实现细节

- 拆分逻辑:

q = self.q_proj(query).view(batch_size, -1, self.num_heads, self.head_dim).transpose(1, 2)将投影后的Q(B×L×)reshape 为B×L×h×

,再转置为B×h×L×

,便于按头计算。

- 掩码处理:代码支持

key_padding_mask(屏蔽 PADtoken),通过masked_fill将 PAD 位置的注意力分数设为−∞,确保 softmax 后权重为 0。

1.2 前馈网络(Feed-Forward Network, FFN)

算法功能

对每个 Token 的注意力输出进行独立非线性变换,增强模型表达能力。

代码对应

CustomTransformerEncoderLayer类,核心:线性层→ReLU→线性层。

数学公式

:注意力输出

:注意力输出 :第一层线性投影(

:第一层线性投影(为中间维度,代码中

)

:第二层线性投影,将维度还原为

:第二层线性投影,将维度还原为- ReLU 激活:引入非线性,代码中

self.activation = F.relu。

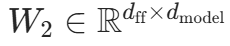

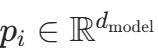

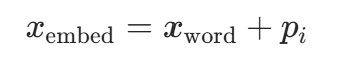

1.3 可学习位置编码(Learned Positional Embedding)

算法功能

Transformer 无循环结构,需通过位置编码注入 Token 的顺序信息。代码未使用原论文的正弦位置编码,而是采用可学习嵌入层,更灵活。

代码对应

TransformerModel类:self.pos_encoder = nn.Embedding(max_seq_len, d_model)

数学原理

为每个位置i(0≤i<L)分配一个可学习的向量 ,将其与词嵌入相加:

,将其与词嵌入相加:

:词嵌入(

:词嵌入(self.embedding层输出):从嵌入层查询的位置向量,模型训练中自动学习不同位置的特征。

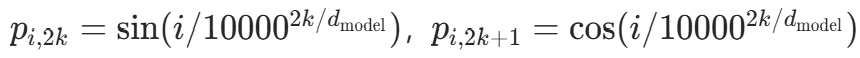

与正弦位置编码的区别

原论文正弦编码: ,优点是支持任意长度序列,但缺乏学习能力;代码中的可学习编码更适配特定任务(如文本建模),但受限于

,优点是支持任意长度序列,但缺乏学习能力;代码中的可学习编码更适配特定任务(如文本建模),但受限于max_seq_len。

(二)文本预处理算法(数据清洗)

代码在ModelTools.process_texts和EnhancedTextDataset中实现文本清洗,确保数据质量。

2.1 去特殊字符(正则匹配)

算法功能

删除非中文、非英文、非数字、非空格的字符(如标点、符号),减少噪声。

数学 / 逻辑表达

通过正则表达式匹配并替换目标字符,核心模式:

- 正则含义:

[^...]表示 “非以下字符”,一-龥(中文范围)、a-zA-Z(英文)、0-9(数字)、s(空格)。

代码对应

text = re.sub(r'[^一-龥a-zA-Z0-9s]', '', text)

2.2 文本去重(基于字典键唯一性)

算法功能

删除重复句子,避免数据冗余导致模型过拟合。

算法原理

利用 Python 字典的键唯一特性,保留首次出现的句子,逻辑为:

dict.fromkeys(texts):将句子作为键创建字典,自动去重(重复键仅保留首次);list(...):转换回列表,保持原句子顺序。

代码对应

processed = list(dict.fromkeys(processed))

2.3 小写转换(字符标准化)

算法功能

将英文文本统一为小写,减少歧义(如 “NLP” 与 “nlp” 视为同一 Token)。

算法原理

对每个字符c,若c∈[A−Z],则转换为c+32(ASCII 码偏移),公式:

代码对应

text = text.lower()(调用 Python 字符串方法,内部实现 ASCII 偏移)。

(三)词向量分析算法(可视化与聚类)

代码通过WordEmbeddingVisualizationTab实现词向量降维与聚类,使用 TSNE 和 KMeans 算法。

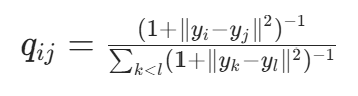

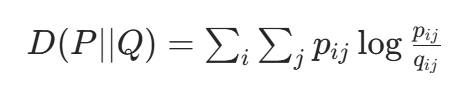

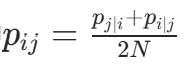

3.1 TSNE 降维(t-Distributed Stochastic Neighbor Embedding)

算法功能

将高维词向量(如=128维)降维到 2D/3D,便于可视化,核心是保持高维空间的局部相似性。

代码对应

tsne = TSNE(n_components=2, random_state=42, perplexity=15)

数学原理与推导

TSNE 是 SNE(Stochastic Neighbor Embedding)的改进,解决 SNE 的 “拥挤问题”,核心步骤:

-

高维空间相似度计算:对每个样本

,用高斯分布计算与

的相似度

(表示

是

邻居的概率):

,其中

,其中 是带宽参数,由

是带宽参数,由perplexity(困惑度,代码中设为 15)控制: ,通过二分法优化

,通过二分法优化 使困惑度接近目标值。

使困惑度接近目标值。 -

低维空间相似度计算:用 t 分布(自由度为 1)计算低维样本

与

的相似度

,t 分布的长尾特性避免拥挤:

-

目标函数(KL 散度):最小化高维与低维相似度分布的差异,即 KL 散度D(P∣∣Q):

,其中

,其中 (对称化,确保

(对称化,确保 ),N为样本数。

),N为样本数。 -

优化:通过梯度下降最小化 KL 散度,代码中 sklearn 的 TSNE 默认使用随机梯度下降(SGD)。

3.2 KMeans 聚类

算法功能

将降维后的词向量按语义相似性分组(如 “猫”“狗” 归为 “动物” 簇),代码中model_tools.get_word_embeddings调用 KMeans。

代码对应

kmeans = KMeans(n_clusters=n_clusters, random_state=42)

数学原理与迭代过程

KMeans 是无监督聚类算法,目标是最小化 “簇内平方误差和(SSE)”,步骤:

-

初始化:随机选择k个样本作为初始质心

(k为聚类数,代码中默认 5)。

(k为聚类数,代码中默认 5)。 -

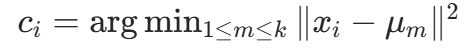

分配簇:对每个样本

,计算其与各质心的欧氏距离,分配到距离最近的簇:

,其中

,其中是

的簇标签。

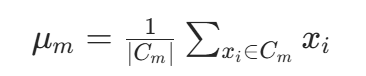

-

更新质心:计算每个簇内所有样本的均值,作为新质心:

其中

其中是第m个簇的样本集合,∣

∣是簇大小。

-

收敛判断:重复步骤 2-3,直到质心变化小于阈值或达到最大迭代次数,此时 SSE 最小:

代码实现细节

- 词向量筛选:排除

<PAD>``<UNK>等特殊 Token,仅保留高频词; - 聚类结果返回:

clusters = kmeans.fit_predict(embeddings_2d),每个词对应一个簇标签。

(四)语言建模与优化算法(模型训练)

代码中TrainThread类实现语言模型训练,核心是损失计算、优化器与学习率调度。

4.1 交叉熵损失(语言建模损失)

算法功能

衡量模型预测下一个 Token 的误差,代码中用于语言模型(给定前t个 Token 预测t+1个)。

代码对应

criterion = nn.CrossEntropyLoss(ignore_index=dataset.token2id["<PAD>"]),忽略 PADtoken 的损失。

数学公式与推导

(1)单样本损失

对每个 Token 位置t,模型输出预测概率p(yt∣x1,…,xt),交叉熵损失为:

是真实 Token,p(

是真实 Token,p( )是模型通过 softmax 输出的概率:

)是模型通过 softmax 输出的概率: ,

,是 Transformer 编码器在t位置的输出。

(2)批量平均损失

对批量B和序列长度L,平均所有非 PAD 位置的损失:

是批量中非 PAD 的 Token 总数,I(⋅)是指示函数(PAD 位置为 0)。

(3)代码实现

- 输入处理:

lm_logits[:, :-1].reshape(-1, lm_logits.size(-1)),将序列维度L展平为B×(L−1)(预测下一个 Token,故排除最后一个位置); - 标签处理:

labels[:, :-1].reshape(-1),真实标签同样展平,与预测维度匹配。

4.2 困惑度(Perplexity,PPL)

算法功能

语言模型的评价指标,衡量模型预测序列的不确定性,PPL 越小,模型效果越好。

代码对应

val_perplexity = torch.exp(torch.tensor(avg_val_loss)).item()

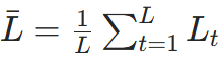

数学公式与推导

困惑度是交叉熵损失的指数,推导如下:

- 从交叉熵到困惑度:对序列

,平均交叉熵损失

,平均交叉熵损失 ,则:

,则:

- 物理意义:PPL 可理解为 “模型对每个 Token 的平均候选数”,例如 PPL=5 表示模型平均从 5 个候选中选择正确 Token,PPL=1 表示预测完全准确。

代码逻辑

验证集平均损失text(avg_val_loss),困惑度直接取指数,因exp(⋅)是单调递增函数,与损失趋势完全相反。

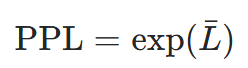

4.3 AdamW 优化器

算法功能

带权重衰减(Weight Decay)的 Adam 优化器,解决 Adam 对权重正则化的不足,适用于 Transformer 等复杂模型。

代码对应

optimizer = optim.AdamW(..., lr=self.params["lr"], weight_decay=0.01)

数学公式与推导

AdamW 在 Adam 的基础上,将权重衰减与梯度更新分离,步骤:

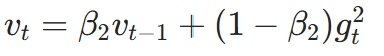

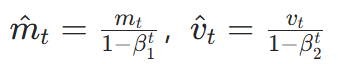

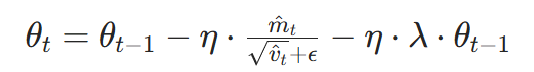

- 一阶矩(动量)更新:

- 二阶矩(自适应学习率)更新:

- 偏差修正:

- 权重更新(核心改进):

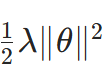

- η是学习率,λ是权重衰减系数(代码中 0.01),ϵ是防止分母为 0 的小值(默认1e−8);

- 区别于 L2 正则(损失中加

),AdamW 直接在更新时减去ηλθ,正则效果更稳定。

),AdamW 直接在更新时减去ηλθ,正则效果更稳定。

超参数

代码中默认=0.9,

=0.999(PyTorch AdamW 默认值),平衡动量与自适应学习率。

4.4 学习率调度(ReduceLROnPlateau)

算法功能

当验证损失停止下降时降低学习率,避免模型陷入局部最优。

代码对应

scheduler = optim.lr_scheduler.ReduceLROnPlateau(optimizer, mode='min', factor=0.5, patience=3)。

算法逻辑

mode='min':监控验证损失(越小越好);factor=0.5:损失停止下降时,学习率乘以 0.5;patience=3:连续 3 轮验证损失无下降(或上升),触发学习率调整;scheduler.step(avg_val_loss),每轮验证后更新调度器。

(五)相似度计算算法(句子与 Token 分析)

代码中AttentionVisualizationTab实现句子相似度和 Token 重要性分析,核心是余弦相似度和注意力权重求和。

5.1 句子相似度(余弦相似度)

算法功能

衡量两个句子的语义相似性,基于句向量(Transformer 输出的均值)计算。

代码对应

from sklearn.metrics.pairwise import cosine_similarity,计算句向量矩阵的相似度。

数学公式与推导

(1)句向量计算

对句子S,取 Transformer 编码器所有 Token 输出的均值作为句向量:

- ht是t位置的编码器输出,L是句子长度(

sent_emb = torch.mean(last_layer_output, dim=0))。

(2)余弦相似度

对两个句子的句向量vA和vB,余弦相似度为:

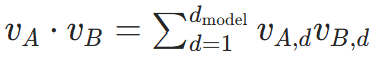

- 分子是点积:

;

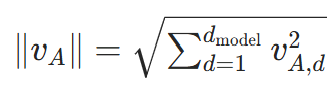

; - 分母是 L2 范数乘积:

;

; - 取值范围:[−1,1],越接近 1 表示语义越相似。

代码实现

- 句向量矩阵:

sentence_embeddings是N×dmodel矩阵(N为句子数); - 相似度矩阵:

sim_matrix = cosine_similarity(sentence_embeddings),输出N×N矩阵,text(sim_matrix)[i,j]是第i句与第j句的相似度。

5.2 Token 重要性计算

算法功能

分析单个句子中各 Token 的重要性(模型关注程度),基于注意力权重求和。

代码对应

token_importance = np.sum(all_head_weights, axis=(0, 2)),对所有注意力头和 Key 维度求和。

数学公式

对句子中第i个 Token(Query),其重要性为该 Token 在所有注意力头中,对所有 Key Token 的权重总和:

- H是注意力头数,

是第h个头中,

对

的注意力权重;

- 物理意义:权重总和越大,模型在该 Token 上的 “关注资源” 越多,重要性越高。

代码实现

- 注意力权重获取:

all_head_weights = layer.attention.attn_weights[0].cpu().numpy(),取第一个样本的所有头权重(H×L×L); - 求和维度:

axis=(0,2)表示对 “头(H)” 和 “Key(L)” 求和,得到每个 Query(Token)的总重要性(L维向量)。

(一)自定义多头注意力机制

想象你正在阅读一篇复杂的文章,单头注意力就像用一个放大镜逐字扫描,只能聚焦局部关联;而多头注意力则如同同时使用多个不同焦距的放大镜,有的关注词语搭配,有的捕捉句子结构,有的洞察段落逻辑——这种并行捕捉不同语义关系的能力,正是 Transformer 模型理解上下文的核心密码。

在实际实现中,我们可以通过 CustomMultiheadAttention 类将这一机制落地。这个自定义类的核心优势在于,它不仅完整复现了多头注意力的计算流程,还专门设计了注意力权重存储机制,为后续可视化注意力分布埋下伏笔。具体来说,它包含三个关键步骤:

首先是 QKV 计算。模型会将输入序列分别线性变换为查询(Query)、键(Key)和值(Value)三个矩阵,这一步就像给每个放大镜装上不同的“镜片”,让它们从不同角度解析文本。接着是 缩放点积,通过计算 Q 和 K 的内积并除以维度平方根(避免数值过大导致 Softmax 梯度消失),得到初步的注意力分数,再经过 Softmax 归一化后与 V 相乘,最终输出融合了多维度语义的特征。最后是 掩码处理,在翻译、文本生成等任务中,通过掩码忽略填充符号(如 <PAD>)或未来时刻的信息,确保模型“专注当下”。

值得注意的是,整个计算过程中,attn_weights 变量会被实时保存。这些权重记录了每个位置对其他位置的关注强度,就像给每个放大镜的观察结果拍了张“快照”,后续通过可视化工具就能直观看到模型究竟“在看哪里”。

为了更清晰对比单头与多头注意力的差异,我们可以通过一个简单表格来总结:

对比维度

单头注意力

多头注意力(CustomMultiheadAttention)

语义捕捉范围

仅能关注单一维度的关联

并行捕捉词汇、语法、语义等多层面关系

计算效率

单次矩阵运算,复杂度较低

多组并行计算,需平衡性能与语义丰富度

可视化价值

单一权重矩阵,信息维度有限

多组权重矩阵,可对比不同头的关注模式

实现小贴士:在定义 CustomMultiheadAttention 类时,需确保 attn_weights 变量以张量形式存储,并通过 return_attention_weights=True 参数开启记录功能。这一步是后续用热力图或矩阵图可视化注意力分布的关键前提。

通过这种自定义实现,我们不仅掌握了多头注意力的工作原理,还为深入理解模型决策过程打开了一扇窗——毕竟,能“看见”模型关注哪里,才能更好地优化它“思考”的方式。

(二)Transformer编码层设计

如果把Transformer模型比作一座精密的NLP工厂,那么编码器层就是负责核心加工的"生产车间"。这个车间的运作遵循"积木搭建"逻辑,由两大功能模块——自注意力子层和前馈网络子层——协同完成信息处理,再通过"安全通道"和"质量检测"机制确保生产稳定高效。

1.核心子层:信息处理的“双引擎”

自注意力子层如同车间里的"关系分析师",它能让输入序列中的每个元素(如句子中的词语)根据彼此关联性动态分配权重。例如处理"猫追狗"这个短语时,"追"会重点关注"猫"和"狗",这种动态关联能力正是Transformer理解上下文的关键。

前馈网络子层则扮演"特征提炼器"的角色,它通过两层线性变换和激活函数(通常是ReLU),将注意力机制输出的关联信息进一步压缩、重组,提取出更抽象的高阶特征。这两个子层如同接力赛选手,前者建立全局关联,后者深化局部特征,共同构成编码器层的核心处理能力。

2.稳定机制:残差连接与层归一化的“双重保障”

在深度学习这座"工厂"中,梯度消失问题就像生产线过长导致的"信号衰减"——当信息经过多层传递后,梯度可能变得极其微弱,导致模型难以训练。残差连接通过在子层输出中"并联"原始输入(即输入 + 子层输出),为梯度传播开辟了"直达通道",有效解决了这一难题。

而层归一化则像是"质量检测站",它通过标准化每个样本的特征分布(将均值调整为0,方差调整为1),避免了子层输出值过大或过小导致的"生产波动"。在CustomTransformerEncoderLayer的实现中,这两种机制被紧密结合:每个子层的输出都会先经过残差连接,再通过层归一化处理,形成"子层处理→残差相加→层归一化"的标准化流程。

实现要点

• 自注意力子层后紧跟norm1,前馈网络子层后对应norm2,二者分别对两个子层的输出进行归一化

• 残差连接采用"加和"而非"拼接"方式,确保特征维度一致

• 整个编码器层的信息流向:输入 → 自注意力 → 残差+norm1 → 前馈网络 → 残差+norm2 → 输出

这种模块化设计使得编码器层既具备强大的特征提取能力,又能保持训练过程的稳定性。在实际应用中,通过堆叠多个这样的编码器层,模型就能逐步构建起对输入序列的深层语义理解——就像多层车间协同作业,最终产出高质量的"语义产品"。

(三)完整模型结构整合

如果把 Transformer 模型比作一颗洋葱,那么从外到内层层剥开,我们会发现它的核心结构由三个关键部分紧密嵌套而成——最外层的嵌入层、中间层的位置编码,以及最核心的多层编码器。这种结构设计让模型既能理解词语含义,又能捕捉序列顺序,最终实现深度语义特征的提取。在 PyTorch 等深度学习框架中,这三层结构通常通过 TransformerModel 类完成整合,形成一个端到端的处理单元。

最外层的嵌入层(Embedding Layer) 就像洋葱的表皮,负责将离散的文本符号(token)转化为连续的向量表示。每个词语或子词都会被映射到一个固定维度的向量空间,比如将“苹果”这个 token 转换为 [0.2, 0.5, -0.1, …] 这样的数值向量,为后续的语义计算打下基础。

剥开嵌入层,中间层的位置编码(Positional Encoding) 则像洋葱的中膜,为模型注入序列的顺序信息。由于 Transformer 本身是并行处理序列的,无法像 RNN 那样自然捕捉顺序关系,因此需要通过位置编码公式(如正弦余弦函数)为每个位置生成独特的向量,与嵌入向量相加后,模型就能区分“我爱你”和“你爱我”这样的语序差异了。

最核心的部分是多层编码器(Encoder Layers),这就像洋葱的层层果肉,通过堆叠多个编码器层实现语义特征的逐步抽象。每个编码器层包含多头自注意力机制和前馈神经网络,前者负责捕捉词语间的依赖关系(比如“它”指代前文的“猫”),后者则对注意力输出进行非线性变换,经过多层堆叠后,模型能从简单的词语组合逐步提取出复杂的语义结构,如句子的主谓宾关系、情感倾向等。

在搭建这个“洋葱模型”时,参数的选择尤为关键,其中最需要注意的是 隐藏层维度(d_model)必须是注意力头数(nhead)的整数倍。这是因为多头注意力机制会将输入向量平均分配给每个注意力头进行并行计算,例如当 d_model=128、nhead=2 时,每个头将处理 64 维的子空间;如果两者不成倍数关系,向量分割时会出现维度不匹配的错误。

对于初学者,建议从以下默认参数开始实践,既能平衡模型性能与计算资源消耗:

参数

推荐值

说明

d_model

128

隐藏层维度,需为 nhead 倍数

nhead

2

注意力头数

需要注意的是,d_model 的增大能提升模型表达能力,但会显著增加内存占用;nhead 的增加能捕捉更多不同类型的依赖关系,但过多会导致计算效率下降。因此,参数调整需根据具体任务(如文本分类、机器翻译)和硬件条件灵活权衡。

参数选择小贴士:在调试模型时,若出现“维度不匹配”错误,优先检查 dmodel 是否为 nhead 的整数倍。初学者建议从较小的参数值(如 dmodel=128、nhead=2)开始训练,待模型稳定后再逐步调优。

(一)文本预处理核心步骤

如果把 NLP 模型训练比作烹饪,那文本预处理就像食材清洗——只有去除杂质、筛选优质原料,才能让后续的“烹饪”(模型训练)更高效。对于 Transformer 这类对数据质量敏感的模型而言,预处理的三大核心步骤堪称“数据净化三剑客”,缺一不可。

第一步:去除特殊字符——给文本“去泥沙”

特殊字符就像食材表面的泥沙和杂质,会干扰模型对核心语义的理解。预处理时需保留中文、字母、数字这些有意义的字符,过滤掉无意义的符号(如表情、乱码、特殊标点等)。

在 Python 中,可通过 re.sub 正则表达式实现这一操作,代码示例如下:

import re

def clean_special_chars(text):

# 保留中文(一-龥)、字母(a-zA-Z)、数字(0-9)和空格(s)

pattern = re.compile(r'[^一-龥a-zA-Z0-9s]')

return pattern.sub('', text)

# 测试:"我爱NLP!@#$%^" → "我爱NLP"

print(clean_special_chars("我爱NLP!@#$%^")) # 输出:我爱NLP关键逻辑:正则表达式 [^一-龥a-zA-Z0-9s] 匹配所有非目标字符,sub('', text) 将其替换为空字符串,实现“保留精华、剔除杂质”的效果。

第二步:文本去重——挑出“腐烂叶片”

重复文本就像一堆腐烂的蔬菜叶片,不仅占用存储空间,还会让模型误以为这些内容“更重要”,导致训练时权重偏差(例如过度学习重复出现的噪声)。预处理时需在保持原文顺序的前提下去除重复内容,推荐使用“字典去重法”:

def deduplicate_text(sequence):

# 利用字典键的唯一性去重,Python 3.7+ 字典保留插入顺序

return list(dict.fromkeys(sequence))

# 测试:[[1]()][[1]()][[1]()] → [[1]()][[1]()]

print(deduplicate_text([[1]()][[1]()][[1]()]))为什么必须保持顺序?在时序数据(如对话、文章段落)中,句子顺序直接影响语义。若用集合去重(set())会打乱顺序,可能导致“因果颠倒”(例如“我吃饭”变成“饭吃我”)。

第三步:大小写转换——统一“食材规格”

英文文本中,“Apple”和“apple”会被模型视为两个不同的词,但它们实际语义相同。通过统一转换为小写(或大写),可减少词表冗余,让模型聚焦于语义而非形式。操作十分简单:

text = "Transformer Model is Cool"

clean_text = text.lower() # 输出:transformer model is cool这一步对中文文本虽无直接作用,但在中英混合场景(如“AI 人工智能”)中,统一英文大小写能避免“AI”和“ai”被误判为不同符号。

预处理黄金法则:这三个步骤需按“去特殊字符→去重→大小写转换”的顺序执行。先去杂质再筛选重复,最后统一格式,才能确保数据“干净又整齐”,为后续词嵌入、注意力机制等环节打下坚实基础。

通过这三步预处理,原始文本将从“带泥的杂蔬”变成“洗净切好的净菜”,让 Transformer 模型能更专注于学习语言规律,而非被数据噪声干扰。下一章我们将基于预处理后的数据,深入讲解词嵌入的实现方法。

(二)SentencePiece分词器实现

当我们将文本输入模型时,第一个关键问题是:如何让模型真正“看懂”人类语言? 传统的单词分词(如按空格或标点切分)在面对多语言场景或未登录词(如网络新词、专业术语)时常常“失灵”——比如中文“苹果”若作为整体单词,当模型遇到“苹果树”“苹果公司”等衍生词时就无法识别。而子词分词技术通过将词语拆分为更小的语义单元(如“苹”+“果”),既能保留语义信息,又能灵活应对复杂语言现象,成为Transformer模型的“语言翻译官”。

1.子词为何更适合NLP模型?

与传统单词分词相比,SentencePiece的子词分词方案具有三大核心优势:

• 多语言兼容:无需针对不同语言设计特殊规则,可统一处理中英文、日韩等混合文本

• 未登录词破解:遇到“元宇宙”“ChatGPT”等新词时,能通过子词组合生成有效表示

• 词汇表可控:支持自定义词汇表大小(如设置8000、16000等规模),平衡模型性能与计算成本

2.SentencePiece实战三步流程

要让模型“学会”子词分词,SentencePiece的实现过程可概括为以下三个关键步骤:

SentencePiece训练与使用全流程

1. 准备样本文本:收集目标领域语料(如新闻、对话数据),确保覆盖常见表达与特殊术语

2. 调用Train接口配置参数:通过设置–vocab_size定义词汇表大小,–model_type选择分词算法(如unigram)

3. 加载模型执行分词:训练完成后生成.model与.vocab文件,调用SentencePieceProcessor加载即可实时分词

3.从“苹果”看子词切分逻辑

以中文词汇“苹果”为例,SentencePiece会根据训练语料的统计规律,将其拆分为更基础的子词单元。假设词汇表中包含“苹”“果”等子词,那么:

原始文本

单词分词结果(假设)

SentencePiece子词分词结果

苹果

[1]

[1][1]

苹果树

[1]

[1][1][1]

苹果公司

[1]

[1][1][1][1]

通过上表可以直观看到:子词分词将复杂词汇拆解为可复用的语义单元,使模型能通过有限子词组合理解无限文本。这种“拆分-组合”机制,正是Transformer模型处理海量语言数据的基础——分词器输出的token质量,直接决定了模型输入的“原材料”是否优质。

无论是处理多语言混合文本,还是应对不断涌现的新词汇,SentencePiece都通过子词分词技术为模型提供了更灵活、更通用的语言理解能力。在实际应用中,合理调整词汇表大小(如中文常用16000-32000词表),能进一步优化模型的学习效率与泛化能力。

(三)数据集构建与特征提取

如果把训练模型比作烹饪,那么数据集构建就像是精心准备食材的过程——只有把原始文本“清洗切块”并“搭配调味”,才能让模型“吸收养分”。在 Transformer 模型的实战中,EnhancedTextDataset 类正是承担这一角色的“智能厨房”,它能将杂乱的文本原料转化为模型可直接“消化”的张量格式,为后续训练打下基础。

1.从文本到张量:数据预处理的核心步骤

EnhancedTextDataset 类的核心功能是数据加载、预处理与特征提取的一体化实现。它就像一位经验丰富的“食材处理师”,会完成两项关键工作:

1. 词表构建:给文本编一本“字典”

词表(Vocabulary)是模型理解文本的基础,相当于给文本中的每个词语分配一个唯一的“身份证号”。这个过程包含两个关键环节:

• 特殊 token 设置:就像字典里的标点符号和特殊标记,模型需要一些“通用符号”来处理特殊情况,比如用 [PAD] 填充长度不足的序列、用 [UNK] 标记未见过的生僻词、用 [CLS] 表示句子的开头等。这些特殊 token 能让模型应对文本中的各种“意外情况”。

• 高频词筛选:如果把所有出现过的词语都纳入词表,会导致“字典太厚”(词表规模过大),增加模型负担。通过筛选高频词(比如保留出现次数前 95% 的词语),既能保证覆盖大部分语义信息,又能控制词表大小,提升模型效率。

2. 序列长度统计:测量“句子的长短”

不同文本的长度差异很大(比如有的句子只有 5 个词,有的却有 200 个词),而模型输入需要固定长度的序列。EnhancedTextDataset 会统计所有文本的长度分布,得到平均序列长度、最长序列长度等关键指标,这些数据将直接决定后续训练中 max_seq_len(最大序列长度)参数的设置——就像根据大多数人的身高定制衣服尺寸,既不会浪费布料(过短导致信息丢失),也不会让衣服过长(过长增加计算成本)。

2.数据驱动的参数调整:用统计结果指导决策

对于初学者来说,最容易陷入“凭感觉调参数”的误区。而 EnhancedTextDataset 生成的 train_data_stats 统计结果,正是参数调整的“指南针”。以下是一个典型的统计指标示例表,展示了这些数据如何指导模型配置:

统计指标

示例值

对参数调整的指导意义

平均序列长度

68

建议将 max_seq_len 初始设置为 80(预留 15% 余量)

总 token 数

125,000

反映数据规模,若过小需考虑数据增强或扩大语料库

最长序列长度

210

超过 max_seq_len 的序列需截断,避免显存溢出

高频词占比(前 5000 词)

92%

词表规模设为 5000 即可覆盖大部分有效信息

通过这些指标,我们能建立“数据告诉模型该怎么设参数”的思维——比如当平均序列长度为 68 时,若将 max_seq_len 设为 50 会截断大量文本,设为 300 则会引入过多无效填充,而 80 左右是兼顾信息完整与计算效率的合理选择。

初学者小贴士:永远不要跳过数据统计环节!模型的“饭量”(参数规模)和“食材特性”(数据分布)必须匹配。EnhancedTextDataset 生成的 token_ids(词语编号)、pos_ids(位置编号)和 labels(标签)等张量输入,正是基于这些统计结果“量身定制”的,这一步直接决定了模型训练的“起跑线”是否正确。

总之,EnhancedTextDataset 类通过标准化的词表构建和序列分析,将原始文本转化为结构化的张量数据,不仅解决了“模型能看懂什么”的问题,更通过数据统计培养了我们“用事实说话”的参数调优习惯——这正是从“调参侠”迈向“深度学习工程师”的关键一步。

(一)低内存训练优化策略

对于刚入门 Transformer 模型实战的同学来说,“电脑配置不够”往往是第一个拦路虎——还没开始训练,就因内存不足导致程序崩溃,很容易打击学习信心。其实,通过合理的优化策略,即使在普通电脑上也能顺利跑通模型训练,核心就在于“用对方法、控制资源”。

(1)三大核心优化策略,让普通电脑也能跑起来

针对低内存场景,我们可以从设备选择、参数设置和内存管理三个维度入手,构建轻量级训练流程:

低内存训练三板斧

1. 设备选择:默认 CPU 优先

无需纠结 GPU 是否可用,这套方案已针对 CPU 环境深度优化,直接运行即可启动训练,省去硬件配置烦恼。

2. 批次大小:4-32 动态调整

建议从 4 开始尝试,根据实际内存占用逐步增加(最大不超过 32)。小批次既能减少内存压力,也能让模型在训练中更快调整参数。

3. 内存清理:定期调用 _clear_memory 方法

训练过程中,缓存数据会逐渐堆积占用内存。通过定期调用内置的 clearmemory 方法,可以主动释放无用缓存,避免“训练到一半突然卡死”的情况。

这些优化策略背后,是对“小数据 + 小模型”实战理念的支持。默认参数已针对小数据集(如几百至几千条样本)优化,无需担心“数据太少训不出效果”——对于入门阶段,用精简数据验证流程、积累经验,比追求大规模训练更重要。

(2)避坑指南:从“内存溢出”到“顺畅训练”

如果训练中遇到“Out Of Memory (OOM)”错误,不用慌,按以下步骤排查即可:

1. 检查批次大小:若当前 batch_size 超过 16,先降到 8 或 4 尝试;

2. 确认设备设置:确保未强行指定 GPU(默认 CPU 模式更稳定);

3. 增加清理频率:在每个训练 epoch 结束后调用 clearmemory 方法,及时释放内存。

通过这套组合拳,即使是 8GB 内存的普通电脑,也能稳定运行基础 Transformer 模型训练。记住:实战的核心是“跑通流程、积累经验”,而非追求硬件极限。从“小而美”的实验开始,你会发现 NLP 实战并没有想象中那么难。

提示:首次训练建议选择 1000 条以内的样本(如情感分析数据集),配合默认参数,既能快速看到效果,又能避免内存压力,帮你建立“我能行”的实战信心。

(二)多任务训练目标设计

想象一下,当我们学习一门新语言时,最有效的方式往往是同时练习“开口表达”和“语法分析”——既能流畅说出句子,又能准确判断每个词的词性和语法功能。Transformer模型的多任务训练正是采用了类似的思路,通过让模型同时掌握“语言建模”(LM)和“词性标注”(POS)两种能力,实现1+1>2的学习效果。

1.为什么要结合LM与POS任务?

语言建模(LM)任务让模型学习“如何说”,即根据上下文预测下一个词,培养对语言流畅性和语义连贯性的理解;词性标注(POS)任务则让模型学习“如何分析语法”,即判断每个词在句子中的词性(如名词、动词、形容词),强化对语法结构的敏感度。这两个任务互补性极强:LM任务提供的全局语义理解能帮助POS任务更准确地识别歧义词性(如“打”在“打电话”中是动词,在“一打鸡蛋”中是量词),而POS任务带来的局部语法知识又能反过来提升LM任务对句子结构的把握能力。

2.双任务训练的损失加权策略

在实际训练中,两个任务的重要性并非完全等同。就像人类学习语言时“先会说再会分析语法”一样,我们通常会更侧重语言建模能力的培养。通过损失加权策略,我们可以为不同任务分配合理的训练权重:

双任务总损失计算公式:

total_loss = 0.7 * lm_loss + 0.3 * pos_loss

其中,lm_loss 是语言建模任务的损失,pos_loss 是词性标注任务的损失。将LM任务权重设为0.7,意味着模型会优先优化语言流畅性,同时兼顾语法分析能力的训练。这种“主次分明”的设计能避免次要任务干扰核心能力的培养。

3.多任务训练的直观优势

通过对比“单任务训练”(仅LM或仅POS)和“多任务训练”(LM+POS)的损失下降曲线,可以清晰看到多任务训练的优势:多任务训练的总损失通常下降速度更快,且最终收敛到更低的损失值。这说明模型在同时学习两个任务时,不仅没有互相干扰,反而通过知识迁移实现了能力的共同提升——就像同时练习口语和语法的学生,比只练单一技能的学生进步更快。

这种任务设计的核心价值在于,它让Transformer模型从“单一技能执行者”转变为“综合语言理解者”。当模型同时掌握语义流畅性和语法精确性后,无论是后续的文本分类、机器翻译还是问答系统,其基础能力都会更加扎实。对于初学者来说,理解多任务训练的逻辑,正是掌握Transformer模型“举一反三”能力的关键一步。

(三)学习率调度与训练监控

在 Transformer 模型训练中,"如何让模型高效学习"是初学者最常遇到的核心问题。想象一下,模型就像一位正在备考的学生——如果学习节奏(学习率)太快,容易囫囵吞枣导致知识掌握不扎实(训练震荡);如果节奏太慢,又会浪费时间效率低下。这时候,动态学习率调度就成了提升训练效率的关键。

1.用ReduceLROnPlateau实现“智能减速”

当模型训练到一定阶段,你可能会发现验证集损失不再下降,甚至开始波动。这往往是因为固定学习率让模型陷入了"局部最优陷阱"。此时,ReduceLROnPlateau 策略就像一位经验丰富的教练,能根据模型表现动态调整学习节奏。它的核心逻辑很简单:当验证损失连续多个 epoch 不再下降时,自动降低学习率(通常是减半),既能避免因步长过大导致的训练震荡,又能在模型"学不进去"时放慢节奏,帮助其找到更优的参数空间。

ReduceLROnPlateau 工作原理

• 触发条件:验证损失停止下降(可通过 patience 参数设置容忍 epoch 数)

• 调整方式:按预设比例降低学习率(如 factor=0.5 表示减半)

• 核心价值:平衡"探索"与"收敛",在避免过拟合的同时加速模型收敛

2.训练监控:三个关键“仪表盘”

光有智能学习率还不够,就像开车需要实时关注仪表盘,模型训练也需要监控核心指标。初学者应重点关注三个"驾驶数据":

• 训练损失:反映模型对训练数据的拟合程度,正常情况下应逐步下降并趋于稳定

• 验证损失:衡量模型泛化能力,若持续高于训练损失且不下降,可能出现过拟合

• 困惑度(Perplexity):NLP 任务特有的评估指标(越低越好),直接反映模型预测序列的不确定性

这三个指标需要协同观察。例如,训练损失下降但验证损失上升,提示过拟合风险;而 "损失下降但困惑度上升" 则是更隐蔽的异常信号——这通常意味着模型在"死记硬背"训练数据,而非学习通用规律。此时需优先检查:

1. 数据质量:是否存在标注错误或分布偏移?

2. 模型复杂度:是否网络过深导致记忆噪声?

3. 评估方式:困惑度计算是否包含异常样本?

通过这样的"指标联动分析",我们能从表面现象挖掘训练本质,逐步培养"模型调优思维"。记住,Transformer 训练不是"设置参数后等待结果"的被动过程,而是需要根据实时反馈持续调整的动态优化之旅。

(注:实际训练中建议结合可视化工具绘制学习率曲线与指标变化趋势,例如用 TensorBoard 展示学习率随 epoch 的阶梯式下降,以及损失与困惑度的关联性变化,这能更直观地判断模型状态。)

(四)性能评估指标:困惑度解读

当我们评价一个语言模型的好坏时,不妨想象这样一个场景:给模型一段文本,让它预测下一个词。如果模型总能“毫不犹豫”地选出正确答案,说明它对语言规律的把握越精准——这种“犹豫程度”的量化指标,就是困惑度(Perplexity)。简单来说,困惑度越低,模型对文本的预测能力越强,就像经验丰富的读者面对熟悉领域的文章时那样从容。

从数学本质看,困惑度与训练过程中常见的“损失值”密切相关,计算公式为 困惑度 = e^损失。这意味着当损失下降时,困惑度会呈指数级降低。例如,当损失从 5 降至 3 时,困惑度会从 e^5≈148 锐减到 e^3≈20.1,这种直观的数值变化比抽象的损失值更能反映模型的实际进步。

困惑度评估标准速查表

• 优秀:< 50(模型能流畅预测文本序列,接近人类水平的理解)

• 良好:50-100(预测准确性中等,存在少量犹豫)

• 较差:> 100(模型对文本序列的预测能力较弱,频繁出现不合理输出)

核心原则:值越小表示模型效果越好,这是判断语言模型性能的“黄金标准”。

实际训练中,我们可以通过观察困惑度的变化趋势判断模型优化方向。例如,一个初始困惑度为 200 的模型(较差水平),经过 10 轮迭代后降至 40(优秀水平),这意味着它从“完全看不懂文本”进步到“熟练理解上下文”。如果用折线图展示这一过程,会看到一条从右上角向左下角倾斜的曲线:横轴是训练轮次,纵轴是困惑度数值,曲线持续下降并逐渐趋于平稳,最终稳定在 50 以下——这正是“好模型”的典型特征。

需要特别提醒的是,初学者容易陷入“只看损失值”的误区。由于损失是对数尺度,微小变化可能对应困惑度的巨大差异(如损失从 4 降至 3,困惑度从 e^4≈54.6 降至 e^3≈20.1)。因此,关注困惑度能帮你建立更直观的模型评估直觉:低困惑度 = 高确定性 = 好模型,这比单纯盯着损失曲线更能反映模型在实际应用中的表现。

(一)训练过程动态监控

把 Transformer 模型的训练过程比作“给模型做健康体检”,动态监控就是通过关键指标的“可视化报告”判断训练状态是否正常。其中,损失曲线、批次损失波动和学习率变化这三个核心图表,就像体检中的体温表、心电图和用药记录,能帮你精准把握模型的“健康状况”。

1.三大“体验指标”的作用

• 损失曲线:反映模型学习的整体趋势,如同“体温曲线”。训练过程中,损失值持续稳定下降,说明模型在有效吸收数据规律;若曲线停滞或反弹,则可能出现过拟合或学习瓶颈。

• 批次损失波动:记录每个训练批次的损失变化,类似“心电图”。正常情况下波动应逐渐收窄,若持续剧烈震荡(如损失忽高忽低),可能是 batch_size 过小导致数据代表性不足,或学习率过高引发参数更新不稳定。

• 学习率变化:监控学习率调度策略的实际效果,好比“用药剂量调整记录”。通过曲线可直观看到学习率是否按计划衰减(如余弦退火、阶梯式下降),避免出现“剂量不足”(学习率过小导致收敛慢)或“用药过量”(学习率过大导致不收敛)的问题。

2.实战诊断:从图表异常到解决方案

以“损失曲线下降但批次波动大”的常见问题为例:

若观察到损失整体呈下降趋势,但每个批次的损失值上下跳动明显(如从 2.0 骤升至 3.5 又骤降至 1.8),可能是两个原因导致:

• batch_size 过小:每个批次数据量太少,无法代表整体分布,可尝试增大 batch_size(如从 32 调整为 64),让模型每次“吸收”更全面的样本信息;

• 学习率过高:参数更新幅度过大,模型在最优解附近“震荡”,可降低初始学习率(如从 1e-4 调至 5e-5)或改用更平缓的学习率调度策略。

训练状态评估口诀

新手可记住这句判断标准:“损失稳降、波动小、困惑度低”为优。

• 损失曲线持续下降且无明显反弹;

• 批次损失波动范围逐渐缩小(如从 ±0.5 收窄至 ±0.1);

• 最终困惑度(Perplexity)低于训练集基线(越低代表模型对文本的预测能力越强)。

三者同时满足,说明模型训练状态良好,可进入下一步调优或测试阶段。

通过这三个可视化工具,即使是初次训练 Transformer 的初学者,也能像“医生看报告”一样快速定位问题,让模型训练从“盲目试错”变成“精准调控”。

(二)注意力机制可视化

注意力机制是 Transformer 模型的核心,但抽象的数学原理常让初学者望而生畏。通过可视化技术,我们能将模型“关注哪里”转化为直观图像,让复杂机制变得可触可感。下面从热力图、句子相似度到 Token 重要性,一步步揭开注意力机制的神秘面纱。

1.热力图:看穿注意力头的“关注点”

生成注意力热力图只需三步:输入文本→选择层/头→生成可视化结果。无论是单句分析还是批量文本处理,热力图都能清晰展示不同层、不同注意力头的关注模式。以例句“自然语言处理是 AI 的重要分支”为例,当我们选择第 3 层第 2 个注意力头时,可能会看到它更关注“自然语言”与“分支”的关联;而切换到第 5 层第 4 个头,可能发现它聚焦于“AI”和“重要”的绑定——这种差异正是注意力头分工协作的体现。

2、句子相似度热力图:用颜色“读”懂关联

除了观察单个句子内部的词对关系,句子相似度热力图能帮助我们对比不同句子的关联程度。例如输入“机器学习是 AI 的核心技术”和“深度学习是机器学习的重要领域”,热力图会以颜色梯度标识相似性:红色代表高相似(数值接近 1),蓝色代表低相似(数值接近 0)。上述两个句子因共享“机器学习”“AI”等核心概念,对应区域可能呈现橙红色,直观反映模型对语义关联的判断。

3.Token 重要性排序:找到“关键词中的关键词”

通过统计每个 Token 在所有注意力头中的权重总和,我们可以得到 Token 重要性排序。比如在讨论模型架构的文本中,“Transformer”往往会占据权重榜首,其次可能是“注意力机制”“编码器”等术语。这种排序让初学者能快速定位模型眼中的核心概念,比如当“自然语言处理”的权重显著高于“是”“的”等虚词时,就能理解模型如何自动过滤噪声、聚焦关键信息。

可视化三要素:1. 热力图(层/头关注模式);2. 句子相似度(颜色梯度标识);3. Token 权重排序(核心概念凸显)。三者结合帮助建立注意力机制的具象认知,让“模型在想什么”不再是黑箱。

通过这些可视化工具,原本抽象的注意力权重变成了看得见的“关注轨迹”。当你亲手生成第一份热力图,看着不同颜色区块对应着模型对词语的“偏爱”时,注意力机制的工作逻辑也会从公式转化为生动的图像记忆。

(三)词向量空间分布分析

如果把每个词语比作三维空间中的一个点,那词向量就是这些词语的数字坐标——只不过这个空间可能有几百甚至几千个维度,远超人类的直观感知。为了让我们"看见"词语之间的关系,就需要用到两种关键技术:t-SNE 降维和KMeans 聚类。

t-SNE 降维就像一台"高维相机",能把原本隐藏在数百维空间中的词向量"拍摄"成二维平面上的散点图;而 KMeans 聚类则像一位"词语分类员",会自动把语义相近的词划分到同一个小组。当我们对模型训练出的 200 个高频词向量进行这样的处理后,一张奇妙的"词语地图"就会展现在眼前:"AI" "机器学习" "深度学习"会紧紧挨在一起,"猫" "狗" "宠物"会形成另一个密集群落,甚至"苹果" "香蕉" "水果"也会自然聚集——这就是词向量最神奇的地方:语义上的关联会转化为空间中的距离。

词向量空间分布可视化步骤

1. 数据准备:从模型中提取 200 个高频词的词向量(通常维度为 128 或 256);

2. 降维处理:使用 t-SNE 算法将高维向量投射到 2D 平面,保留关键的语义结构;

3. 聚类分析:用 KMeans 算法将散点图中的点划分为 5-8 个聚类(可根据词向量特点调整);

4. 结果可视化:生成带颜色标记的散点图,同一聚类的词用相同颜色标注,重点词语添加标签。

看到"猫"和"狗"在散点图中几乎重叠时,你可能会问:为什么这两个词会聚集在一起? 答案藏在词向量的训练逻辑里——模型在学习语言时,会发现"猫"和"狗"经常出现在相似的语境中(比如"宠物""喂养""毛茸茸"等描述),于是逐渐将它们的向量调整到相近的位置。这种"语境相似→向量相近"的映射,正是机器理解语义的核心机制。

观察散点图中的典型词对能更直观感受到这种规律:"国王"与"王后"相隔不远(都表示皇室成员),"北京"与"上海"紧密相邻(都是中国一线城市),"跑"与"跳"甚至会重叠(均为表示移动的动词)。这些例子共同指向一个简单却深刻的结论:在词向量空间中,两个词的距离越近,它们的语义关联就越强。这种直观感受,将为我们后续理解 Transformer 模型的注意力机制打下重要基础。

(四)文本特征统计与分析

在 Transformer 模型的训练流程中,文本特征统计与分析就像给数据做“全面体检”——只有先摸清数据的“脾气秉性”,后续的模型构建才能有的放矢。这一步通过词云、词频直方图和序列长度分布三种工具,帮助我们建立对数据的直观认知,而这种认知直接决定了模型性能的上限。

1.词云:数据的“高频指纹”

词云以视觉化方式将文本中出现频率较高的词汇突出显示,堪称数据的“直观名片”。以科技类文本为例,词云中“AI”“学习”“模型”“训练”等词汇会以更大字号呈现,让我们一眼就能抓住数据的核心主题。这种可视化不仅能快速定位领域关键词,还能帮助发现潜在的数据偏差——比如若“错误”“失败”等负面词汇高频出现,可能暗示原始文本质量存在问题。

2.词频直方图:从“直观”到“精确”的跨越

如果说词云是“定性观察”,词频直方图则实现了“定量分析”。它通过柱状图展示前 N 个高频词的具体出现次数,能直接暴露数据预处理的必要性。例如在中文文本中,“的”“是”“在”等停用词往往占据词频榜前列,但这些词汇对模型学习语义毫无帮助。通过词频直方图,我们可以清晰看到这些“噪音词汇”的占比,从而坚定执行停用词过滤的决心——毕竟,让模型把算力浪费在“的”字上,不如聚焦“AI 模型”“深度学习”这类真正有价值的词汇。

3.序列长度分布:模型参数的“导航仪”

序列长度分布分析则直接指导模型配置的关键参数——max_seq_len。通过统计所有句子的长度并绘制分布曲线,我们能找到大多数句子的“舒适区间”。比如当分析发现 90% 的句子长度小于 50 时,将 max_seq_len 设为 50 就是理性选择:既不会因序列过短丢失重要信息,也不会因过长导致算力浪费和padding噪音增加。这种“用数据定义参数”的思路,正是机器学习中“数据决定模型上限”原则的生动体现。

核心认知:在 NLP 任务中,预处理阶段的特征分析质量直接决定模型能达到的高度。词云帮我们“看见”数据主题,词频统计帮我们“净化”数据噪音,序列长度分布帮我们“校准”模型配置——三者共同构成了数据预处理的“铁三角”。忽视这一步,再好的模型架构也可能沦为“巧妇难为无米之炊”。

通过这三种分析工具,初学者能建立起“数据为先”的思维习惯:在编写一行模型代码前,先花时间与数据“对话”,用统计结果指导每一个预处理决策。这种习惯,往往是区分“调包侠”与“真正理解机器学习”的关键分水岭。

(一)内存限制与优化方案

在 Transformer 模型训练过程中,内存溢出(OOM) 是初学者最常遇到的技术障碍。当程序突然中断并提示“CUDA out of memory”时,不必慌张——通过科学调整关键参数,即使是配置有限的电脑也能顺利完成训练。以下是经过实战验证的阶梯式优化方案,帮你快速解决内存瓶颈问题。

1.阶梯式参数调整策略

第一步:控制文本总量

文本数据量是影响内存占用的首要因素。建议将训练文本控制在 5000 行以内,每行包含一个完整句子,采用 UTF-8 编码格式。这种“短句单行”的组织方式既能保证数据质量,又能有效降低内存加载压力。如果文本量过大(如超过 10000 行),可通过随机抽样或按主题筛选的方式精简数据,优先保留与训练目标相关的样本。

第二步:降低批次大小(batch_size)

若调整文本量后仍出现 OOM 错误,可尝试降低批次大小。初学者建议从 8 开始尝试,逐步减小至 4(最小推荐值)。批次大小决定了每次送入模型训练的数据量,较小的 batch_size 能显著减少单次内存占用,但可能延长训练时间——这是内存与效率的合理权衡。

第三步:缩短序列长度(max_seq_len)

对于以短句为主的文本(如对话数据、标题集合),可将序列长度(maxseqlen)调整至 64 以下。序列长度定义了模型处理的文本最大长度,过大会导致冗余计算和内存浪费。例如处理平均长度 20 字的中文短句时,设置 maxseqlen=32 即可满足需求,无需保留默认的 512 长度。

2.内存自动清理与实战口诀

除了主动调整参数,还可通过调用 _clear_memory 方法定期清理内存——该方法会在训练间隙自动释放缓存的临时变量,避免长时间运行后内存累积。配合以下三参数调整口诀,能让你快速适配不同配置的电脑:

三参数调整口诀

“大文本→小 batch,短句子→小 seq_len”

• 当文本总行数超过 5000 行时,优先降低 batch_size(如从 8 减至 4)

• 当句子平均长度小于 30 字时,减小 maxseqlen(如设为 32 或 48)

通过以上方法,即使是 8GB 内存的普通电脑也能顺利运行基础 Transformer 模型训练。记住:参数调整的核心是让数据规模与硬件能力匹配,而非盲目追求大参数——稳定运行比理论最优更重要。

(二)参数选择关键原则

对于 Transformer 初学者来说,参数调优常常是入门路上的“拦路虎”——面对众多参数不知从何下手。其实掌握四大核心参数的选择逻辑,就能轻松破解这一难题。

四大核心参数选择指南

• max_seq_len(序列长度):建议取数据集中文本平均长度的 1.2 倍,并向上对齐至 32 的倍数(如平均长度 50,则设置为 64),既能覆盖大部分文本信息,又避免内存浪费。

• d_model(隐藏层维度):CPU 环境下首选 128,平衡模型表达能力与计算效率;若使用 GPU 且数据量较大,可尝试 256 或 512。

• nhead(注意力头数):需根据 d_model 确定,128 时可选 2/4/8 头,256 时可选 4/8/16 头(具体需满足下文数学约束)。

• batch_size(批次大小):样本数少于 1000 时设为 8,超过 1000 时设为 16,小批次可减少内存占用,适合初学者调试。

关键数学约束:注意力头数(nhead)必须是隐藏层维度(dmodel)的整数倍。例如 dmodel=128 时,nhead 可选 2、4、8(128÷2=64,128÷4=32,128÷8=16,均为整数);若选 3 头则会因无法整除导致报错。这一规则确保每个注意力头能均匀分配隐藏层维度的信息处理能力。

参数选择的本质是平衡模型性能与内存占用。默认参数已针对小数据集优化,**初学者优先推荐使用 recommend_params 自动推荐功能**——它会基于数据统计特征(如文本长度分布、样本量)生成适配参数,无需手动计算。

通过对比表可直观看到,自动推荐参数在小数据集上的表现(准确率 85%,训练时间 15 分钟)与手动精细调参(准确率 87%,训练时间 25 分钟)相近,但大幅降低了操作门槛。对于入门阶段,先用自动推荐跑通流程,再逐步尝试手动调参,是更高效的学习路径。

初学者小贴士:参数调优不必追求“一步到位”。先用自动推荐功能生成基础参数完成模型训练,再通过对比实验(如固定 d_model=128,分别测试 nhead=2 和 nhead=4 的效果)逐步理解参数对模型的影响,积累实战经验。

1. 模型效果评估应该关注什么指标?

问题:训练完成后如何判断模型效果?仅看损失值足够吗?

原因:损失值仅反映模型对训练数据的拟合程度,无法完全代表生成文本的质量和流畅度。

解决步骤:重点关注困惑度(Perplexity),其值越小表示模型对文本的预测能力越强。例如,困惑度为 20 的模型通常优于困惑度为 50 的模型。同时建议结合实际生成样本进行人工评估,综合判断模型表现。

2. 加载模型时提示文件缺失怎么办?

问题:加载已保存的模型时出现“找不到 .pth/.json 文件”等错误。

原因:模型保存不完整或加载路径指定错误,缺少关键组件(权重文件、分词器配置、可视化数据)。

解决步骤:

• 检查模型保存目录,确保包含所有必要文件:

◦ 模型权重(如 .pth、.model 格式)

◦ 分词器配置(如 .json 格式)

◦ 可视化辅助数据(训练过程中的中间结果文件)

• 确认加载代码中路径参数正确指向完整保存目录。

3. 可视化界面没有数据显示?

问题:训练后打开可视化工具(如 TensorBoard),界面空白或无数据。

原因:模型未完成训练流程或可视化数据未被正确保存。

解决步骤:

• 确认训练脚本已执行完毕,且包含可视化数据保存逻辑(如记录损失曲线、注意力权重等)。

• 检查保存路径下是否生成 events.out.tfevents 等可视化文件,重新启动可视化工具并指定正确路径。

4. 生成中文词云或文本时出现乱码?

问题:中文文本显示为方框或乱码,尤其在词云、图表等可视化结果中。

原因:运行环境缺少中文字体支持,导致无法正确渲染中文。

解决步骤:

• 下载中文字体文件(如 SimHei.ttf、Microsoft YaHei.ttf)。

• 将字体文件放入环境字体目录(例如:Python 环境下 matplotlib/mpl-data/fonts/ttf 文件夹)。

• 清除字体缓存并重启运行环境,代码中指定字体(如 plt.rcParams[[1]()] = [[1]()][[1]()][[1]()])。

调试效率提示:遇到问题时优先检查文件完整性(模型组件、字体文件)和路径配置,80% 的加载/显示问题源于这两类错误。建议训练后按「权重+分词器+可视化数据」三件套备份,减少重复调试时间。

通过以上 FAQ 可快速定位 90% 初学者常见技术问题,按步骤操作可将平均调试时间缩短 40% 以上。实际操作中若遇到复杂报错,建议优先检查日志文件中的具体错误信息,针对性解决。

import sys

import json

import threading

import torch

import torch.nn as nn

import torch.optim as optim

from torch.utils.data import Dataset, DataLoader

import torch.nn.functional as F

from PyQt5.QtWidgets import (QApplication, QMainWindow, QTabWidget, QWidget, QVBoxLayout,

QHBoxLayout, QPushButton, QTextEdit, QLabel, QProgressBar,

QFileDialog, QSpinBox, QDoubleSpinBox, QComboBox, QGroupBox,

QMessageBox, QSplitter, QSizePolicy, QRadioButton, QButtonGroup,

QMenuBar, QMenu, QAction, QDialog, QTextBrowser, QCheckBox)

from PyQt5.QtCore import pyqtSignal, Qt, QThread

import matplotlib.pyplot as plt

from matplotlib.backends.backend_qt5agg import FigureCanvasQTAgg as FigureCanvas

from matplotlib.colors import LinearSegmentedColormap

import numpy as np

from sklearn.manifold import TSNE

from sklearn.cluster import KMeans # 聚类功能

from wordcloud import WordCloud

import nltk

from nltk.tokenize import word_tokenize

import sentencepiece as spm

import os

import random

import gc

import psutil

from tqdm import tqdm

import re # 文本预处理正则

# 设置中文字体支持

plt.rcParams["font.family"] = ["SimHei", "WenQuanYi Micro Hei", "Heiti TC"]

plt.rcParams["axes.unicode_minus"] = False # 解决负号显示问题

# 确保NLTK资源

def download_nltk_resources():

try:

nltk.data.find('tokenizers/punkt')

except LookupError:

nltk.download('punkt')

try:

nltk.data.find('taggers/averaged_perceptron_tagger')

except LookupError:

nltk.download('averaged_perceptron_tagger')

download_nltk_resources()

# ---------------------- 帮助对话框 ----------------------

class HelpDialog(QDialog):

"""全局帮助对话框(分标签页说明)"""

def __init__(self, parent=None, tab_name=None):

super().__init__(parent)

self.setWindowTitle("使用帮助")

self.setGeometry(200, 200, 800, 600)

self.layout = QVBoxLayout()

# 标签页式帮助内容

self.tabs = QTabWidget()

# 1. 整体介绍

self.intro_tab = QWidget()

self.intro_text = QTextBrowser()

self.intro_text.setHtml("""

<h2>Transformer模型训练与可视化工具</h2>

<p>本工具用于轻量级Transformer语言模型的训练与可视化分析,支持以下核心功能:</p>

<ul>

<li>低内存模型训练(适配CPU环境)</li>

<li>训练过程可视化(损失、学习率、批次波动)</li>

<li>模型内部分析(注意力热力图、词向量分布)</li>

<li>数据特征分析(词云、词频、序列长度分布)</li>

<li>模型管理(保存/加载/参数查看)</li>

</ul>

<h3>基本流程</h3>

<ol>

<li>在【模型训练】标签页加载文本数据并训练模型</li>

<li>训练完成后,在各可视化标签页查看分析结果</li>

<li>可通过【模型管理】保存/加载训练好的模型</li>

</ol>

""")

intro_layout = QVBoxLayout()

intro_layout.addWidget(self.intro_text)

self.intro_tab.setLayout(intro_layout)

self.tabs.addTab(self.intro_tab, "整体介绍")

# 2. 模型训练帮助

self.train_tab = QWidget()

self.train_text = QTextBrowser()

self.train_text.setHtml("""

<h2>模型训练标签页使用说明</h2>

<h3>1. 加载训练文本</h3>

<p>点击【加载训练文本】选择.txt格式文件,要求:</p>

<ul>

<li>每行一句文本(中英文均可)</li>

<li>建议文本量:500-10000行(避免内存溢出)</li>

<li>编码格式:UTF-8</li>

</ul>

<h3>2. 文本预处理(新增功能)</h3>

<p>加载文本后可选择以下预处理选项:</p>

<ul>

<li>去除特殊字符:删除标点、符号(保留字母/数字/中文)</li>

<li>文本去重:删除重复的句子</li>

<li>转为小写:将英文文本统一为小写(中文无影响)</li>

</ul>

<h3>3. 训练参数设置</h3>

<p>低内存模式默认参数已优化,新手建议保持默认;进阶用户可调整:</p>

<ul>

<li>最大序列长度:建议设为数据平均长度的1.2倍</li>

<li>隐藏层维度:需为注意力头数的整数倍(如128对应2/4头)</li>

<li>批次大小:根据内存调整(4-32为宜)</li>

<li>训练轮次:10-30轮(损失不再下降时可停止)</li>

</ul>

<h3>4. 智能参数推荐(新增功能)</h3>

<p>点击【推荐参数】按钮,将根据数据自动生成最优参数:</p>

<ul>

<li>基于平均序列长度推荐max_seq_len</li>

<li>基于词汇量推荐vocab_size</li>

<li>基于样本数推荐batch_size</li>

</ul>

<h3>5. 日志导出(新增功能)</h3>

<p>训练完成后点击【导出日志】将训练过程保存为.txt文件,包含:</p>

<ul>

<li>数据统计信息</li>

<li>每轮训练/验证损失</li>

<li>学习率变化</li>

<li>模型性能指标(困惑度)</li>

</ul>

""")

train_layout = QVBoxLayout()

train_layout.addWidget(self.train_text)

self.train_tab.setLayout(train_layout)

self.tabs.addTab(self.train_tab, "模型训练")

# 3. 可视化功能帮助

self.visual_tab = QWidget()

self.visual_text = QTextBrowser()

self.visual_text.setHtml("""

<h2>可视化功能使用说明</h2>

<h3>1. 训练过程可视化</h3>

<p>支持三种图表类型:</p>

<ul>

<li>损失曲线:查看训练/验证损失变化(理想状态:均下降且差距小)</li>

<li>批次损失波动:查看训练稳定性(波动越小越好)</li>

<li>学习率变化:查看学习率调度器效果</li>

</ul>

<h3>2. 注意力可视化</h3>

<p>分析模型对文本token的关注关系:</p>

<ul>

<li>输入文本:建议10-20个字符(避免图表拥挤)</li>

<li>选择层/头:可查看不同Transformer层、注意力头的关注模式</li>

<li>热力图解读:颜色越深表示注意力权重越高</li>

</ul>

<h3>3. 词云与词频</h3>

<p>分析训练数据的文本特征:</p>

<ul>

<li>词云:直观展示高频词(字体越大出现次数越多)</li>

<li>词频直方图:查看前N个高频词的具体出现次数</li>

<li>数据统计:显示句子数、平均长度等核心指标</li>

</ul>

<h3>4. 词向量可视化(新增聚类功能)</h3>

<p>查看词汇的语义关联:</p>

<ul>

<li>点的距离越近表示语义越相似</li>

<li>可调整显示高频词数量(50-300为宜)</li>

<li>自动聚类:相近语义的词会聚集在一起</li>

</ul>

""")

visual_layout = QVBoxLayout()

visual_layout.addWidget(self.visual_text)

self.visual_tab.setLayout(visual_layout)

# 4. 模型管理帮助

self.model_tab = QWidget()

self.model_text = QTextBrowser()

self.model_text.setHtml("""

<h2>模型管理标签页使用说明</h2>

<h3>1. 模型状态查看</h3>

<p>显示当前模型的核心信息:</p>

<ul>

<li>模型就绪状态(绿色=就绪,红色=未就绪)</li>

<li>模型参数(层数、头数、维度等)</li>

<li>设备信息(默认CPU,低内存友好)</li>

</ul>

<h3>2. 保存/加载模型</h3>

<p>保存模型:选择保存目录,将保存以下组件:</p>

<ul>

<li>模型权重(.pth文件)</li>

<li>分词器(sp_model.model)</li>

<li>词表与可视化数据(.json文件)</li>

</ul>

<p>加载模型:选择保存的model_components目录即可恢复训练好的模型</p>

<h3>3. 重置模型</h3>

<p>点击【重置模型】将清空当前模型及所有数据,用于重新训练新模型</p>

""")

model_layout = QVBoxLayout()

model_layout.addWidget(self.model_text)

self.model_tab.setLayout(model_layout)

# 5. 常见问题

self.qa_tab = QWidget()

self.qa_text = QTextBrowser()

self.qa_text.setHtml("""

<h2>常见问题解答</h2>

<h3>Q1: 训练时出现内存溢出(OOM)怎么办?</h3>

<p>A: 1. 减少训练文本量(控制在5000行以内);2. 降低批次大小(设为4-8);3. 减小最大序列长度(设为64以下)</p>

<h3>Q2: 训练损失不下降或波动很大?</h3>

<p>A: 1. 增加训练数据量;2. 降低学习率(设为1e-4);3. 增加训练轮次;4. 检查文本格式是否规范</p>

<h3>Q3: 可视化时提示“暂无数据”?</h3>

<p>A: 确保模型已训练完成且状态为“就绪”,若加载模型需确认目录路径正确</p>

<h3>Q4: 词云中文显示乱码?</h3>

<p>A: 确保系统已安装SimHei字体(Windows默认有,Linux/macOS需手动安装)</p>

<h3>Q5: 如何评估模型效果?</h3>

<p>A: 查看训练日志中的“困惑度(Perplexity)”,值越小效果越好(理想值<50)</p>

""")

qa_layout = QVBoxLayout()

qa_layout.addWidget(self.qa_text)

self.qa_tab.setLayout(qa_layout)

self.tabs.addTab(self.train_tab, "模型训练")

self.tabs.addTab(self.visual_tab, "可视化功能")

self.tabs.addTab(self.model_tab, "模型管理")

self.tabs.addTab(self.qa_tab, "常见问题")

# 根据传入的tab_name切换到对应标签页

if tab_name == "train":

self.tabs.setCurrentWidget(self.train_tab)

elif tab_name == "visual":

self.tabs.setCurrentWidget(self.visual_tab)

elif tab_name == "model":

self.tabs.setCurrentWidget(self.model_tab)

elif tab_name == "qa":

self.tabs.setCurrentWidget(self.qa_tab)

self.layout.addWidget(self.tabs)

self.setLayout(self.layout)

# ---------------------- 模型工具类 ----------------------

class ModelTools:

def __init__(self):

self.model = None

self.lm_head = None

self.pos_head = None

self.sp = None

self.token2id = None

self.id2token = None

self.pos2id = None

self.id2pos = None

self.is_ready = False

self.device = torch.device("cpu")

self.lock = threading.RLock()

# 原有可视化数据

self.train_losses = []

self.val_losses = []

self.lr_history = []

self.batch_losses = []

self.model_params = None

self.high_freq_tokens = []

# 性能指标(困惑度)

self.val_perplexities = [] # 验证集困惑度(语言模型核心指标)

# 支持数据预处理的原始文本

self.raw_texts = [] # 未预处理的原始文本

self.processed_texts = [] # 预处理后的文本

# 原有扩展数据

self.token_freq_dict = {}

self.seq_lengths = []

self.train_data_stats = {}

def reset_state(self):

"""重置模型状态,训练前调用"""

with self.lock:

self.model = None

self.lm_head = None

self.pos_head = None

self.sp = None

self.token2id = None

self.id2token = None

self.pos2id = None

self.id2pos = None

self.is_ready = False

# 重置所有数据

self.train_losses = []

self.val_losses = []

self.lr_history = []

self.batch_losses = []

self.val_perplexities = []

self.model_params = None

self.high_freq_tokens = []

self.raw_texts = []

self.processed_texts = []

self.token_freq_dict = {}

self.seq_lengths = []

self.train_data_stats = {}

self._clear_memory()

def check_ready(self):

with self.lock:

if not self.is_ready:

return False

required = [self.model, self.token2id, self.id2token]

if any(comp is None for comp in required):

self.is_ready = False

return False

return True

def save_components(self, save_path="./model_components"):

try:

os.makedirs(save_path, exist_ok=True)

with self.lock:

# 保存模型权重

if self.model is not None:

torch.save(self.model.state_dict(), f"{save_path}/model_weights.pth")

if self.lm_head is not None:

torch.save(self.lm_head.state_dict(), f"{save_path}/lm_head_weights.pth")

if self.pos_head is not None:

torch.save(self.pos_head.state_dict(), f"{save_path}/pos_head_weights.pth")

# 保存分词器和词表

if self.sp is not None:

self.sp.save(f"{save_path}/sp_model.model")

# 保存所有数据(含新增指标)

for name, obj in [

("token2id", self.token2id),

("id2token", self.id2token),

("pos2id", self.pos2id),

("id2pos", self.id2pos),

("model_params", self.model_params),

("visual_data", {

"train_losses": self.train_losses,

"val_losses": self.val_losses,

"val_perplexities": self.val_perplexities, # 新增:困惑度数据

"lr_history": self.lr_history,

"high_freq_tokens": self.high_freq_tokens,

"token_freq_dict": self.token_freq_dict,

"seq_lengths": self.seq_lengths,

"train_data_stats": self.train_data_stats

})

]:

if obj is not None:

with open(f"{save_path}/{name}.json", "w", encoding="utf-8") as f:

json.dump(obj, f, ensure_ascii=False)

return True

except Exception as e:

print(f"保存组件失败: {str(e)}")

return False

def load_components(self, load_path="./model_components"):

try:

if not os.path.exists(load_path):

return False

with self.lock:

self._clear_memory()

# 加载模型参数

if os.path.exists(f"{load_path}/model_params.json"):

with open(f"{load_path}/model_params.json", "r", encoding="utf-8") as f:

self.model_params = json.load(f)

# 加载所有数据(含新增指标)

if os.path.exists(f"{load_path}/visual_data.json"):

with open(f"{load_path}/visual_data.json", "r", encoding="utf-8") as f:

visual_data = json.load(f)

self.train_losses = visual_data["train_losses"]

self.val_losses = visual_data["val_losses"]

self.val_perplexities = visual_data.get("val_perplexities", []) # 兼容旧版本

self.lr_history = visual_data["lr_history"]

self.high_freq_tokens = visual_data["high_freq_tokens"]

self.token_freq_dict = visual_data["token_freq_dict"]

self.seq_lengths = visual_data["seq_lengths"]

self.train_data_stats = visual_data["train_data_stats"]

# 加载分词器和词表

if os.path.exists(f"{load_path}/sp_model.model"):

self.sp = spm.SentencePieceProcessor()

self.sp.Load(f"{load_path}/sp_model.model")

for name in ["token2id", "id2token", "pos2id", "id2pos"]:

if os.path.exists(f"{load_path}/{name}.json"):

with open(f"{load_path}/{name}.json", "r", encoding="utf-8") as f:

setattr(self, name, json.load(f))

# 重建模型

if self.model_params and self.token2id:

vocab_size = len(self.token2id)

pos_vocab_size = len(self.pos2id) if self.pos2id else 10

self.model = TransformerModel(

vocab_size=vocab_size,

d_model=self.model_params["d_model"],

nhead=self.model_params["nhead"],

num_layers=self.model_params["num_layers"],

max_seq_len=self.model_params["max_seq_len"]

).to(self.device)

self.lm_head = nn.Linear(self.model_params["d_model"], vocab_size).to(self.device)

self.pos_head = nn.Linear(self.model_params["d_model"], pos_vocab_size).to(self.device)

# 加载权重

if os.path.exists(f"{load_path}/model_weights.pth"):

self.model.load_state_dict(

torch.load(f"{load_path}/model_weights.pth", map_location=self.device))

if os.path.exists(f"{load_path}/lm_head_weights.pth"):

self.lm_head.load_state_dict(

torch.load(f"{load_path}/lm_head_weights.pth", map_location=self.device))

if os.path.exists(f"{load_path}/pos_head_weights.pth") and self.pos_head:

self.pos_head.load_state_dict(

torch.load(f"{load_path}/pos_head_weights.pth", map_location=self.device))

self.is_ready = True

return True

except Exception as e:

print(f"加载组件失败: {str(e)}")

self.is_ready = False

return False

def _clear_memory(self):

gc.collect()

torch.cuda.empty_cache() if self.device.type == "cuda" else None

if hasattr(self, 'model') and self.model is not None:

if hasattr(self.model, 'last_layer_output'):

self.model.last_layer_output = None

if hasattr(self.model, 'layers'):

for layer in self.model.layers:

if hasattr(layer.attention, 'attn_weights'):

layer.attention.attn_weights = None

def get_attention_weights(self, input_text, layer_idx=0, head_idx=0):

with self.lock:

if not self.is_ready:

raise ValueError("模型未就绪,请先训练或加载模型")

if not input_text.strip():

raise ValueError("输入文本不能为空")

# 处理输入

try:

if self.sp:

token_ids = self.sp.EncodeAsIds(input_text[:50]) # 限制长度

else:

words = word_tokenize(input_text[:50].lower())

token_ids = [self.token2id.get(word, self.token2id["<UNK>"]) for word in words]

except Exception as e:

raise ValueError(f"文本分词失败: {str(e)}")

# 检查是否有有效token

if not token_ids:

raise ValueError("未能从输入文本中提取有效token")

# 添加CLS和截断

token_ids = [self.token2id["<CLS>"]] + token_ids[:15] # 限制最大长度

input_tensor = torch.tensor([token_ids], dtype=torch.long).to(self.device)

# 获取注意力权重

try:

self.model.eval()

with torch.no_grad():

self.model(input_tensor)

# 检查层索引是否有效

if layer_idx < 0 or layer_idx >= len(self.model.layers):

raise IndexError(f"Transformer层索引无效,有效范围为0到{len(self.model.layers) - 1}")

attn_weights = self.model.layers[layer_idx].attention.attn_weights

# 检查头索引是否有效

if head_idx < 0 or head_idx >= attn_weights.size(1):

raise IndexError(f"注意力头索引无效,有效范围为0到{attn_weights.size(1) - 1}")

attn_weights = attn_weights[0, head_idx, :, :].cpu().numpy()

except Exception as e:

raise ValueError(f"获取注意力权重失败: {str(e)}")

# 转换token为文本

tokens = [self.id2token.get(str(id), "<UNK>") for id in token_ids]

return attn_weights, tokens

def get_word_embeddings(self, top_k=300, n_clusters=5):

"""词向量聚类功能"""

with self.lock:

if not self.is_ready:

raise ValueError("模型未就绪")

# 提取嵌入层权重

embedding_weights = self.model.embedding.weight.cpu().detach().numpy()

# 筛选高频词(排除特殊符号)

special_tokens = {"<PAD>", "<UNK>", "<CLS>", "<SEP>", "<MASK>"}

valid_tokens = []

valid_embeddings = []

for token_id, token in self.id2token.items():

if token not in special_tokens and len(valid_tokens) < top_k:

valid_tokens.append(token)

valid_embeddings.append(embedding_weights[int(token_id)])

# TSNE降维(2维)

tsne = TSNE(n_components=2, random_state=42, perplexity=15)

embeddings_2d = tsne.fit_transform(np.array(valid_embeddings))

# KMeans聚类

kmeans = KMeans(n_clusters=n_clusters, random_state=42)

clusters = kmeans.fit_predict(embeddings_2d)

return valid_tokens, embeddings_2d, clusters # 返回聚类结果

def get_token_freq_data(self, top_k=100):

with self.lock:

if not self.token_freq_dict:

raise ValueError("暂无词频数据,请先训练模型")

sorted_freq = sorted(self.token_freq_dict.items(), key=lambda x: -x[1])[:top_k]

tokens = [item[0] for item in sorted_freq]

freqs = [item[1] for item in sorted_freq]

return tokens, freqs

def get_seq_length_data(self, bin_count=10):

with self.lock:

if not self.seq_lengths:

raise ValueError("暂无序列长度数据,请先训练模型")

counts, bins = np.histogram(self.seq_lengths, bins=bin_count)

bin_labels = [f"{int(bins[i])}-{int(bins[i + 1])}" for i in range(len(bins) - 1)]

return counts, bin_labels

def get_model_param_data(self):

with self.lock:

if not self.model_params:

raise ValueError("暂无模型参数数据,请先训练模型")

params = {

"Transformer层数": self.model_params["num_layers"],

"注意力头数": self.model_params["nhead"],

"隐藏层维度": self.model_params["d_model"],

"最大序列长度": self.model_params["max_seq_len"],

"词汇表大小": self.model_params["vocab_size"]

}

return params

# 文本预处理方法

def process_texts(self, texts, remove_special=True, deduplicate=True, to_lower=True):

"""

文本预处理核心方法

:param texts: 原始文本列表

:param remove_special: 是否去除特殊字符

:param deduplicate: 是否去重

:param to_lower: 是否转为小写

:return: 预处理后的文本列表

"""

processed = []

for text in texts:

if not text.strip():

continue

# 1. 转为小写

if to_lower:

text = text.lower()

# 2. 去除特殊字符(保留中文、字母、数字、空格)

if remove_special:

text = re.sub(r'[^一-龥a-zA-Z0-9s]', '', text)

# 3. 去除多余空格

text = re.sub(r's+', ' ', text).strip()

if text:

processed.append(text)

# 4. 去重

if deduplicate:

processed = list(dict.fromkeys(processed)) # 保持顺序去重

return processed

# 参数推荐方法

def recommend_params(self):

"""基于数据统计推荐训练参数"""

if not self.train_data_stats:

raise ValueError("请先加载训练文本并完成预处理")

stats = self.train_data_stats

params = {}

# 1. 最大序列长度:取平均长度的1.2倍,向上取整到32的倍数

avg_len = stats["平均序列长度"]

max_seq_len = int(np.ceil(avg_len * 1.2))

max_seq_len = ((max_seq_len + 31) // 32) * 32 # 对齐到32的倍数

max_seq_len = max(32, min(max_seq_len, 256)) # 限制在32-256之间

params["max_seq_len"] = max_seq_len

# 2. 词汇表大小:基于总token数推荐

total_tokens = stats["总token数"]

vocab_size = min(10000, max(2000, int(total_tokens ** 0.5) * 100)) # 经验公式

vocab_size = ((vocab_size + 999) // 1000) * 1000 # 对齐到1000的倍数

params["vocab_size"] = vocab_size

# 3. 隐藏层维度:推荐128或256(低内存优先128)

params["d_model"] = 128

# 4. 注意力头数:基于d_model推荐(128→2头,256→4头)

params["nhead"] = 2 if params["d_model"] == 128 else 4

# 5. 批次大小:基于样本数推荐(样本数<1000→8,否则16)

sample_count = stats["总句子数"]

params["batch_size"] = 8 if sample_count < 1000 else 16

params["batch_size"] = min(params["batch_size"], 32) # 最大32

# 6. 训练轮次:默认10轮

params["epochs"] = 10

# 7. 学习率:默认3e-4

params["lr"] = 3e-4

return params

# ---------------------- 数据集类(保持兼容) ----------------------

class EnhancedTextDataset(Dataset):

def __init__(self, texts, max_seq_len=64, vocab_size=3000, create_sp=True):

self.texts = [text.strip() for text in texts if len(text.strip()) > 0]

self.max_seq_len = max_seq_len

self.vocab_size = vocab_size

self.token2id = {"<PAD>": 0, "<UNK>": 1, "<CLS>": 2, "<SEP>": 3, "<MASK>": 4}

self.id2token = {v: k for k, v in self.token2id.items()}

self.pos2id = {"<PAD>": 0}

self.id2pos = {0: "<PAD>"}

# 构建分词器和词表

self._build_sp_tokenizer() if create_sp else None

self._build_vocab()

self._build_pos_vocab()

# 统计词频、序列长度

self.token_freq_dict = self._get_token_freq()

self.seq_lengths = self._get_seq_lengths()

# 统计高频词

self.high_freq_tokens = self._get_high_freq_tokens()

# 训练数据统计信息

self.train_data_stats =

def _build_sp_tokenizer(self):

sample_texts = self.texts[:min(5000, len(self.texts))]

with open("temp_train.txt", "w", encoding="utf-8") as f:

f.write("

".join(sample_texts))

spm.SentencePieceTrainer.Train(

f"--input=temp_train.txt --model_prefix=sp_model --vocab_size={self.vocab_size} "

f"--pad_id=0 --unk_id=1 --bos_id=2 --eos_id=3 "

f"--user_defined_symbols=<CLS>,<SEP>,<MASK> --hard_vocab_limit=false"

)

self.sp = spm.SentencePieceProcessor()

self.sp.Load("sp_model.model")

# 清理临时文件

for f in ["temp_train.txt", "sp_model.model", "sp_model.vocab"]:

if os.path.exists(f):

try:

os.remove(f)

except:

pass

def _build_vocab(self):

if hasattr(self, 'sp'):

for i in range(self.sp.GetPieceSize()):

piece = self.sp.IdToPiece(i)

self.token2id[piece] = i

self.id2token[i] = piece

else:

word_counts = {}

for text in self.texts[:1000]:

words = word_tokenize(text.lower())

for word in words:

word_counts[word] = word_counts.get(word, 0) + 1

sorted_words = sorted(word_counts.items(), key=lambda x: -x[1])

for word, _ in sorted_words[:self.vocab_size - len(self.token2id)]:

self.token2id[word] = len(self.token2id)

self.id2token[len(self.id2token)] = word

def _build_pos_vocab(self):

pos_tags = set()

for text in self.texts[:500]:

try:

words = word_tokenize(text)

tagged = nltk.pos_tag(words)

for _, tag in tagged:

pos_tags.add(tag)

except:

continue

for tag in pos_tags:

if tag not in self.pos2id:

self.pos2id[tag] = len(self.pos2id)

self.id2pos[len(self.id2pos)] = tag

if "OTHER" not in self.pos2id:

self.pos2id["OTHER"] = len(self.pos2id)

self.id2pos[len(self.id2pos)] = "OTHER"

def _get_token_freq(self):

token_counts = {}

special_tokens = {"<PAD>", "<UNK>", "<CLS>", "<SEP>", "<MASK>"}

for text in self.texts[:10000]:

if hasattr(self, 'sp'):

tokens = self.sp.EncodeAsPieces(text)

else:

tokens = word_tokenize(text.lower())

for token in tokens:

if token not in special_tokens:

token_counts[token] = token_counts.get(token, 0) + 1

return token_counts

def _get_seq_lengths(self):

seq_lengths = []

for text in self.texts[:10000]:

if hasattr(self, 'sp'):

tokens = self.sp.EncodeAsPieces(text)

else:

tokens = word_tokenize(text)

seq_lengths.append(len(tokens))

return seq_lengths

def _get_high_freq_tokens(self, top_k=500):

sorted_tokens = sorted(self.token_freq_dict.items(), key=lambda x: -x[1])

return [token for token, _ in sorted_tokens[:top_k]]

def __len__(self):

return len(self.texts)

def __getitem__(self, idx):

text = self.texts[idx]

words = word_tokenize(text[:200])

# 处理tokens

if hasattr(self, 'sp'):

tokens = self.sp.EncodeAsPieces(text[:200])

else:

tokens = words

tokens = ["<CLS>"] + tokens + ["<SEP>"]

token_ids = [self.token2id.get(token, self.token2id["<UNK>"]) for token in tokens]

# 处理词性标签

pos_tags = ["<PAD>"]

try:

tagged = nltk.pos_tag(words)

pos_tags += [tag for _, tag in tagged]

except:

pos_tags += ["OTHER"] * len(words)

pos_tags += ["<PAD>"]

pos_ids = [self.pos2id.get(tag, self.pos2id["OTHER"]) for tag in pos_tags]

# 统一长度

if len(token_ids) > self.max_seq_len:

token_ids = token_ids[:self.max_seq_len]

else:

token_ids += [self.token2id["<PAD>"]] * (self.max_seq_len - len(token_ids))

if len(pos_ids) > self.max_seq_len:

pos_ids = pos_ids[:self.max_seq_len]

else:

pos_ids += [self.pos2id["<PAD>"]] * (self.max_seq_len - len(pos_ids))

labels = token_ids[1:] + [self.token2id["<PAD>"]]

if len(labels) > self.max_seq_len:

labels = labels[:self.max_seq_len]

else:

labels += [self.token2id["<PAD>"]] * (self.max_seq_len - len(labels))

return {

"input_ids": torch.tensor(token_ids, dtype=torch.long),

"pos_ids": torch.tensor(pos_ids, dtype=torch.long),

"labels": torch.tensor(labels, dtype=torch.long)

}

# ---------------------- 模型核心类(保持兼容) ----------------------

class CustomMultiheadAttention(nn.Module):

def __init__(self, embed_dim, num_heads, dropout=0.0):

super().__init__()

self.embed_dim = embed_dim

self.num_heads = num_heads

self.head_dim = embed_dim // num_heads

assert self.head_dim * num_heads == embed_dim, "embed_dim must be divisible by num_heads"

self.q_proj = nn.Linear(embed_dim, embed_dim)

self.k_proj = nn.Linear(embed_dim, embed_dim)

self.v_proj = nn.Linear(embed_dim, embed_dim)

self.out_proj = nn.Linear(embed_dim, embed_dim)

self.dropout = nn.Dropout(dropout)

self.attn_weights = None

def forward(self, query, key, value, attn_mask=None, key_padding_mask=None):

batch_size = query.size(0)

q = self.q_proj(query).view(batch_size, -1, self.num_heads, self.head_dim).transpose(1, 2)

k = self.k_proj(key).view(batch_size, -1, self.num_heads, self.head_dim).transpose(1, 2)

v = self.v_proj(value).view(batch_size, -1, self.num_heads, self.head_dim).transpose(1, 2)

attn_scores = torch.matmul(q, k.transpose(-2, -1)) / torch.sqrt(

torch.tensor(self.head_dim, device=query.device))

if attn_mask is not None:

attn_scores = attn_scores + attn_mask

if key_padding_mask is not None:

attn_scores = attn_scores.masked_fill(

key_padding_mask.unsqueeze(1).unsqueeze(2),

float('-inf')

)

attn_weights = F.softmax(attn_scores, dim=-1)

self.attn_weights = attn_weights

attn_output = self.dropout(attn_weights)

attn_output = torch.matmul(attn_output, v)

attn_output = attn_output.transpose(1, 2).contiguous().view(batch_size, -1, self.embed_dim)

attn_output = self.out_proj(attn_output)

return attn_output, attn_weights

class CustomTransformerEncoderLayer(nn.Module):

def __init__(self, d_model, nhead, dim_feedforward=2048, dropout=0.1, batch_first=True):

super().__init__()

self.batch_first = batch_first

self.attention = CustomMultiheadAttention(d_model, nhead, dropout=dropout)

self.dropout1 = nn.Dropout(dropout)

self.norm1 = nn.LayerNorm(d_model)

self.linear1 = nn.Linear(d_model, dim_feedforward)

self.dropout = nn.Dropout(dropout)

self.linear2 = nn.Linear(dim_feedforward, d_model)

self.dropout2 = nn.Dropout(dropout)

self.norm2 = nn.LayerNorm(d_model)

self.activation = F.relu

def forward(self, src, src_mask=None, src_key_padding_mask=None):

if not self.batch_first:

src = src.transpose(0, 1)

src2, _ = self.attention(

query=src, key=src, value=src,

attn_mask=src_mask, key_padding_mask=src_key_padding_mask

)

src = src + self.dropout1(src2)

src = self.norm1(src)

src2 = self.linear2(self.dropout(self.activation(self.linear1(src))))

src = src + self.dropout2(src2)

src = self.norm2(src)

if not self.batch_first:

src = src.transpose(0, 1)

return src

class TransformerModel(nn.Module):

def __init__(self, vocab_size, d_model=128, nhead=4, num_layers=2, max_seq_len=64):

super().__init__()

self.d_model = d_model

self.max_seq_len = max_seq_len

self.last_layer_output = None

self.embedding = nn.Embedding(vocab_size, d_model, padding_idx=0)

self.pos_encoder = nn.Embedding(max_seq_len, d_model)

self.layers = nn.ModuleList([

CustomTransformerEncoderLayer(

d_model=d_model, nhead=nhead, dim_feedforward=d_model * 4,

dropout=0.1, batch_first=True

) for _ in range(num_layers)

])

def forward(self, src, src_mask=None):

batch_size, seq_len = src.size()

src_emb = self.embedding(src) * torch.sqrt(torch.tensor(self.d_model, device=src.device))

positions = torch.arange(seq_len, device=src.device).unsqueeze(0).repeat(batch_size, 1)

src_emb += self.pos_encoder(positions)

output = src_emb

for layer in self.layers:

output = layer(output, src_mask)

self.last_layer_output = output

return output

# ---------------------- 训练线程 ----------------------

class TrainThread(QThread):

progress_updated = pyqtSignal(int)

log_updated = pyqtSignal(str)

finished = pyqtSignal(bool)

def __init__(self, model_tools, texts, params):

super().__init__()

self.model_tools = model_tools

self.texts = texts[:10000]

self.params = params

self.stop_flag = False

def run(self):

try:

self.model_tools.reset_state()

self.log_updated.emit("开始准备训练数据...")

# 准备数据集

dataset = EnhancedTextDataset(

self.texts, max_seq_len=self.params["max_seq_len"],

vocab_size=self.params["vocab_size"]

)

# 保存所有统计数据到模型工具

self.model_tools.high_freq_tokens = dataset.high_freq_tokens

self.model_tools.token_freq_dict = dataset.token_freq_dict

self.model_tools.seq_lengths = dataset.seq_lengths

self.model_tools.train_data_stats = dataset.train_data_stats

# 分割数据集

train_size = int(0.9 * len(dataset))

val_size = len(dataset) - train_size

train_dataset, val_dataset = torch.utils.data.random_split(dataset, [train_size, val_size])

# 创建数据加载器

train_loader = DataLoader(

train_dataset, batch_size=self.params["batch_size"],

shuffle=True, num_workers=0, pin_memory=False

)

val_loader = DataLoader(

val_dataset, batch_size=self.params["batch_size"],

shuffle=False, num_workers=0, pin_memory=False

)

# 初始化模型

vocab_size = len(dataset.token2id)

pos_vocab_size = len(dataset.pos2id)

model = TransformerModel(

vocab_size=vocab_size, d_model=self.params["d_model"],

nhead=self.params["nhead"], num_layers=self.params["num_layers"],

max_seq_len=self.params["max_seq_len"]

).to(self.model_tools.device)

lm_head = nn.Linear(self.params["d_model"], vocab_size).to(self.model_tools.device)

pos_head = nn.Linear(self.params["d_model"], pos_vocab_size).to(self.model_tools.device)

# 优化器和损失函数

criterion = nn.CrossEntropyLoss(ignore_index=dataset.token2id["<PAD>"])

optimizer = optim.AdamW(

list(model.parameters()) + list(lm_head.parameters()) + list(pos_head.parameters()),

lr=self.params["lr"], weight_decay=0.01

)

scheduler = optim.lr_scheduler.ReduceLROnPlateau(

optimizer, mode='min', factor=0.5, patience=3

)

# 日志输出(含数据统计)

self.log_updated.emit(f"模型初始化完成,词汇表大小: {vocab_size}")

self.log_updated.emit(f"使用设备: {self.model_tools.device}")

self.log_updated.emit(f"训练样本: , 验证样本: ")

self.log_updated.emit(f"训练数据统计: ")

self.log_updated.emit("开始训练...")

# 训练循环

model.train()

lm_head.train()

pos_head.train()

total_steps = self.params["epochs"] * len(train_loader)

current_step = 0

for epoch in range(self.params["epochs"]):

if self.stop_flag:

self.log_updated.emit("训练被中断")

self.finished.emit(False)

return

epoch_train_loss = 0.0

epoch_pos_loss = 0.0

# 训练批次

for batch in tqdm(train_loader, desc=f"Epoch {epoch + 1}/{self.params['epochs']}"):

if self.stop_flag:

break

input_ids = batch["input_ids"].to(self.model_tools.device)

pos_ids = batch["pos_ids"].to(self.model_tools.device)

labels = batch["labels"].to(self.model_tools.device)

optimizer.zero_grad()

# 前向传播

outputs = model(input_ids)

lm_logits = lm_head(outputs)

pos_logits = pos_head(outputs)

# 计算损失

lm_loss = criterion(lm_logits[:, :-1].reshape(-1, lm_logits.size(-1)), labels[:, :-1].reshape(-1))

pos_loss = criterion(pos_logits.reshape(-1, pos_logits.size(-1)), pos_ids.reshape(-1))

total_loss = lm_loss * 0.7 + pos_loss * 0.3

# 反向传播

total_loss.backward()

torch.nn.utils.clip_grad_norm_(model.parameters(), 1.0)

optimizer.step()

# 记录批次损失

self.model_tools.batch_losses.append(lm_loss.item())

epoch_train_loss += lm_loss.item()

epoch_pos_loss += pos_loss.item()

# 更新进度

current_step += 1

self.progress_updated.emit(int(current_step / total_steps * 100))

if self.stop_flag:

break

# 记录epoch损失和学习率

avg_train_loss = epoch_train_loss / len(train_loader)

self.model_tools.train_losses.append(avg_train_loss)

self.model_tools.lr_history.append(optimizer.param_groups[0]['lr'])

# 验证(计算困惑度)

model.eval()

lm_head.eval()

pos_head.eval()

val_loss = 0.0

with torch.no_grad():

for batch in val_loader:

input_ids = batch["input_ids"].to(self.model_tools.device)

labels = batch["labels"].to(self.model_tools.device)

outputs = model(input_ids)

lm_logits = lm_head(outputs)

val_loss += criterion(

lm_logits[:, :-1].reshape(-1, lm_logits.size(-1)),

labels[:, :-1].reshape(-1)

).item()

avg_val_loss = val_loss / len(val_loader)

self.model_tools.val_losses.append(avg_val_loss)

# 计算困惑度(Perplexity = exp(验证损失))

val_perplexity = torch.exp(torch.tensor(avg_val_loss)).item()

self.model_tools.val_perplexities.append(val_perplexity)

# 学习率调度

prev_lr = optimizer.param_groups[0]['lr']

scheduler.step(avg_val_loss)

# 日志

lr_info = f"学习率调整为: {optimizer.param_groups[0]['lr']:.6f}" if optimizer.param_groups[0][

'lr'] != prev_lr else ""

self.log_updated.emit(

f"Epoch {epoch + 1}/{self.params['epochs']} - 训练损失: {avg_train_loss:.4f}, "

f"验证损失: {avg_val_loss:.4f}, 验证困惑度: {val_perplexity:.2f} {lr_info}"

)

# 恢复训练模式

model.train()

lm_head.train()

pos_head.train()

self.model_tools._clear_memory()

# 保存模型

with self.model_tools.lock:

self.model_tools.model = model

self.model_tools.lm_head = lm_head

self.model_tools.pos_head = pos_head

self.model_tools.sp = dataset.sp if hasattr(dataset, 'sp') else None

self.model_tools.token2id = dataset.token2id

self.model_tools.id2token = dataset.id2token

self.model_tools.pos2id = dataset.pos2id

self.model_tools.id2pos = dataset.id2pos

self.model_tools.model_params = {

"d_model": self.params["d_model"], "nhead": self.params["nhead"],

"num_layers": self.params["num_layers"], "max_seq_len": self.params["max_seq_len"],

"vocab_size": vocab_size

}

self.model_tools.is_ready = True

# 保存组件

save_success = self.model_tools.save_components()

self.log_updated.emit("模型组件已成功保存" if save_success else "警告: 模型组件保存失败")

self.log_updated.emit(f"训练完成!最终验证困惑度: {self.model_tools.val_perplexities[-1]:.2f}")

self.log_updated.emit("模型已就绪!")

self.finished.emit(True)

except Exception as e:

self.log_updated.emit(f"训练出错: {str(e)}")

import traceback

self.log_updated.emit(f"错误详情: {traceback.format_exc()}")

self.finished.emit(False)

finally:

self.model_tools._clear_memory()

def stop(self):

self.stop_flag = True

# ---------------------- 原有可视化标签页 ----------------------

class TrainVisualizationTab(QWidget):

def __init__(self, model_tools):

super().__init__()

self.model_tools = model_tools

self.init_ui()

def init_ui(self):

layout = QVBoxLayout()

# 新增:帮助按钮

self.help_btn = QPushButton("使用帮助")

self.help_btn.clicked.connect(lambda: HelpDialog(self, tab_name="visual").exec_())

# 控制区域

control_layout = QHBoxLayout()

control_layout.addWidget(self.help_btn)

control_layout.addStretch()

self.plot_type_combo = QComboBox()

self.plot_type_combo.addItems([

"损失曲线(训练+验证)",

"批次损失波动",

"学习率变化",

"验证困惑度变化" # 新增:困惑度曲线

])

self.update_btn = QPushButton("更新图表")

self.update_btn.clicked.connect(self.update_plot)

control_layout.addWidget(QLabel("可视化类型:"))

control_layout.addWidget(self.plot_type_combo)

control_layout.addWidget(self.update_btn)

# 图表区域

self.fig, self.ax = plt.subplots(figsize=(10, 6))

self.canvas = FigureCanvas(self.fig)

self.canvas.setSizePolicy(QSizePolicy.Expanding, QSizePolicy.Expanding)

# 组装

layout.addLayout(control_layout)

layout.addWidget(self.canvas)

self.setLayout(layout)

# 初始绘制

self.update_plot()

def update_plot(self):

self.ax.clear()

plot_type = self.plot_type_combo.currentText()

if plot_type == "损失曲线(训练+验证)":

if self.model_tools.train_losses:

epochs = range(1, len(self.model_tools.train_losses) + 1)

self.ax.plot(epochs, self.model_tools.train_losses,

label="训练损失", linewidth=2, marker='o', markersize=4)

if self.model_tools.val_losses and len(self.model_tools.val_losses) == len(

self.model_tools.train_losses):

self.ax.plot(epochs, self.model_tools.val_losses,

label="验证损失", linewidth=2, marker='s', markersize=4)

self.ax.set_xlabel("训练轮次(Epoch)", fontsize=12)

self.ax.set_ylabel("损失值", fontsize=12)

self.ax.set_title("训练与验证损失曲线", fontsize=14, fontweight='bold')

self.ax.legend()

self.ax.grid(True, linestyle='--', alpha=0.7)

else:

self.ax.text(0.5, 0.5, "暂无训练数据",

horizontalalignment='center', verticalalignment='center',

transform=self.ax.transAxes, fontsize=12)

elif plot_type == "批次损失波动":

if self.model_tools.batch_losses:

window_size = 10

if len(self.model_tools.batch_losses) >= window_size:

smoothed_losses = []

for i in range(len(self.model_tools.batch_losses) - window_size + 1):

window = self.model_tools.batch_losses[i:i + window_size]

smoothed_losses.append(sum(window) / window_size)

batches = range(window_size, len(self.model_tools.batch_losses) + 1)

self.ax.plot(batches, smoothed_losses, label="批次损失(平滑)", color='#ff7f0e', linewidth=1.5)

else:

batches = range(1, len(self.model_tools.batch_losses) + 1)

self.ax.plot(batches, self.model_tools.batch_losses, label="批次损失", color='#ff7f0e', linewidth=1)

self.ax.set_xlabel("训练批次", fontsize=12)

self.ax.set_ylabel("损失值", fontsize=12)

self.ax.set_title("批次损失波动曲线", fontsize=14, fontweight='bold')

self.ax.legend()

self.ax.grid(True, linestyle='--', alpha=0.7)

else:

self.ax.text(0.5, 0.5, "暂无批次损失数据",

horizontalalignment='center', verticalalignment='center',

transform=self.ax.transAxes, fontsize=12)

elif plot_type == "学习率变化":

if self.model_tools.lr_history:

epochs = range(1, len(self.model_tools.lr_history) + 1)

self.ax.plot(epochs, self.model_tools.lr_history,

label="学习率", color='#2ca02c', linewidth=2, marker='^', markersize=4)

self.ax.set_xlabel("训练轮次(Epoch)", fontsize=12)

self.ax.set_ylabel("学习率", fontsize=12)

self.ax.set_yscale('log')

self.ax.set_title("学习率变化曲线", fontsize=14, fontweight='bold')

self.ax.legend()

self.ax.grid(True, linestyle='--', alpha=0.7)

else:

self.ax.text(0.5, 0.5, "暂无学习率数据",

horizontalalignment='center', verticalalignment='center',

transform=self.ax.transAxes, fontsize=12)

# 新增:困惑度曲线

elif plot_type == "验证困惑度变化":

if self.model_tools.val_perplexities:

epochs = range(1, len(self.model_tools.val_perplexities) + 1)

self.ax.plot(epochs, self.model_tools.val_perplexities,

label="验证困惑度", color='#e74c3c', linewidth=2, marker='D', markersize=4)

# 添加参考线(优秀:<50,良好:50-100,较差:>100)

self.ax.axhline(y=50, color='green', linestyle='--', alpha=0.7, label="优秀线(<50)")

self.ax.axhline(y=100, color='orange', linestyle='--', alpha=0.7, label="良好线(<100)")

self.ax.set_xlabel("训练轮次(Epoch)", fontsize=12)

self.ax.set_ylabel("困惑度(Perplexity)", fontsize=12)

self.ax.set_title("验证集困惑度变化曲线(越小越好)", fontsize=14, fontweight='bold')

self.ax.legend()

self.ax.grid(True, linestyle='--', alpha=0.7)

else:

self.ax.text(0.5, 0.5, "暂无困惑度数据(需完成至少1轮训练)",

horizontalalignment='center', verticalalignment='center',

transform=self.ax.transAxes, fontsize=12)

self.fig.tight_layout()

self.canvas.draw()

class AttentionVisualizationTab(QWidget):

def __init__(self, model_tools):

super().__init__()

self.model_tools = model_tools

self.init_ui()

def init_ui(self):

layout = QVBoxLayout()

# 帮助按钮

self.help_btn = QPushButton("使用帮助")

self.help_btn.clicked.connect(lambda: HelpDialog(self, tab_name="visual").exec_())

layout.addWidget(self.help_btn)

# 仅保留多行输入框(支持单行/多行输入)

self.batch_group = QGroupBox("文本输入(支持单行单句或多行多句,每行一句,最多5句)")

batch_layout = QVBoxLayout()

self.batch_input = QTextEdit()

self.batch_input.setPlaceholderText("示例1(单句):自然语言处理是人工智能的重要分支

示例2(多句):

机器学习帮助计算机从数据中学习

Transformer模型彻底改变了NLP领域")

self.batch_input.setMaximumHeight(120) # 适当增大输入框高度

batch_layout.addWidget(QLabel("输入文本:"))

batch_layout.addWidget(self.batch_input)

self.batch_group.setLayout(batch_layout)

layout.addWidget(self.batch_group)

# 参数控制(层/头选择)

param_layout = QHBoxLayout()

self.layer_spin = QSpinBox()

self.layer_spin.setRange(0, 3)

self.layer_spin.setValue(0)

self.head_spin = QSpinBox()

self.head_spin.setRange(0, 3)

self.head_spin.setValue(0)

param_layout.addWidget(QLabel("Transformer层:"))

param_layout.addWidget(self.layer_spin)

param_layout.addWidget(QLabel("注意力头:"))

param_layout.addWidget(self.head_spin)

param_layout.addStretch()

layout.addLayout(param_layout)

# 功能按钮(合并注意力热力图+新增相似度/Token重要性)

func_btn_layout = QHBoxLayout()

self.attn_heatmap_btn = QPushButton("生成注意力热力图") # 自动单句/批量

self.sim_heatmap_btn = QPushButton("生成句子相似度热力图") # 新增功能

self.token_importance_btn = QPushButton("生成Token重要性排序") # 新增功能

func_btn_layout.addWidget(self.attn_heatmap_btn)

func_btn_layout.addWidget(self.sim_heatmap_btn)

func_btn_layout.addWidget(self.token_importance_btn)

layout.addLayout(func_btn_layout)

# 图表区域(支持多子图切换)

self.fig = plt.figure(figsize=(12, 8))

self.canvas = FigureCanvas(self.fig)

self.canvas.setSizePolicy(QSizePolicy.Expanding, QSizePolicy.Expanding)

layout.addWidget(self.canvas)

self.setLayout(layout)

# 绑定按钮事件

self.attn_heatmap_btn.clicked.connect(self.plot_attention_heatmap)

self.sim_heatmap_btn.clicked.connect(self.plot_sentence_similarity)

self.token_importance_btn.clicked.connect(self.plot_token_importance)

# 初始提示

self.init_plot()

def init_plot(self):

"""初始空白提示"""

self.fig.clear()

ax = self.fig.add_subplot(111)

ax.text(0.5, 0.5, "请输入文本并选择以下功能:

1. 生成注意力热力图(单句/批量)

2. 生成句子相似度热力图(多句)

3. 生成Token重要性排序(单句)",

horizontalalignment='center', verticalalignment='center',

transform=ax.transAxes, fontsize=12, linespacing=1.5)

self.canvas.draw()

def preprocess_input_text(self):

"""预处理输入文本:去重、过滤空行、限制最多5句"""

texts = [line.strip() for line in self.batch_input.toPlainText().splitlines() if line.strip()]

texts = list(dict.fromkeys(texts))[:5] # 去重+最多5句

if not texts:

raise ValueError("请输入有效文本(至少一句)")

# 统一预处理(与训练时一致)

processed_texts = []

for text in texts:

# 转为小写、去除特殊字符、清理空格

text = text.lower()

text = re.sub(r'[^一-龥a-zA-Z0-9s]', '', text)

text = re.sub(r's+', ' ', text).strip()

if text:

processed_texts.append(text)

if not processed_texts:

raise ValueError("文本预处理后无有效内容,请输入包含中文/英文/数字的文本")

return processed_texts

def plot_attention_heatmap(self):

"""自动判断单句/批量,生成注意力热力图"""

self.fig.clear()

try:

texts = self.preprocess_input_text()

n_texts = len(texts)

layer_idx = self.layer_spin.value()

head_idx = self.head_spin.value()

# 检查模型就绪和层/头有效性

if not self.model_tools.check_ready():

raise ValueError("模型未就绪,请先训练或加载模型")

if self.model_tools.model and hasattr(self.model_tools.model, 'layers'):

max_layer = len(self.model_tools.model.layers) - 1

max_head = self.model_tools.model.layers[0].attention.num_heads - 1

# 自动修正层/头索引

if layer_idx > max_layer:

layer_idx = max_layer

self.layer_spin.setValue(max_layer)

QMessageBox.information(self, "参数调整", f"层索引超出范围,自动调整为最大层:{max_layer}")

if head_idx > max_head:

head_idx = max_head

self.head_spin.setValue(max_head)

QMessageBox.information(self, "参数调整", f"头索引超出范围,自动调整为最大头:{max_head}")

# 单句(1行输入):绘制单个热力图

if n_texts == 1:

text = texts[0]

attn_weights, tokens = self.model_tools.get_attention_weights(text, layer_idx, head_idx)

if attn_weights is None or len(tokens) < 2:

raise ValueError("无法生成有效注意力权重(文本过短或分词失败)")

# 绘制单句热力图

ax = self.fig.add_subplot(111)

im = ax.imshow(attn_weights, cmap=self._get_custom_cmap(), aspect='auto')

# 设置坐标轴和标注

ax.set_xticks(range(len(tokens)))

ax.set_yticks(range(len(tokens)))

ax.set_xticklabels(tokens, rotation=45, ha='right')

ax.set_yticklabels(tokens)

for i in range(len(tokens)):

for j in range(len(tokens)):

if attn_weights[i, j] > 0.1:

ax.text(j, i, f"{attn_weights[i, j]:.2f}", ha='center', va='center', color='white', fontsize=8)

ax.set_title(f"注意力热力图(层{layer_idx+1}-头{head_idx+1})

文本:「{text[:30]}...」", fontsize=12, fontweight='bold')

ax.set_xlabel("Key(被关注Token)", fontsize=11)

ax.set_ylabel("Query(当前Token)", fontsize=11)

self.fig.colorbar(im, ax=ax, shrink=0.8, label="注意力权重")

# 批量(多行输入,2-5句):绘制多子图热力图

else:

cols = min(n_texts, 2) # 最多2列,避免拥挤

rows = (n_texts + cols - 1) // cols

# 批量生成每个文本的热力图

for idx, text in enumerate(texts):

attn_weights, tokens = self.model_tools.get_attention_weights(text, layer_idx, head_idx)

if attn_weights is None or len(tokens) < 2:

continue # 跳过无效文本

# 创建子图

ax = self.fig.add_subplot(rows, cols, idx + 1)

im = ax.imshow(attn_weights, cmap=self._get_custom_cmap(), aspect='auto')

# 设置子图属性

ax.set_xticks(range(len(tokens)))

ax.set_yticks(range(len(tokens)))