1.1 模型概述

Qwen3.5-Plus 是通义千问团队发布的旗舰级开源大语言模型,基于Transformer架构深度优化,覆盖文本、多模态、代码、工具调用等全场景能力,是当前工业界落地性价比最高的通用大模型之一。本文将系统拆解模型的10项核心技术特性,提供可复现的全流程部署方案,以及企业级二次开发实战案例,为AI开发人员提供完整的模型落地技术参考。

1.2 测试与依赖环境说明

本文所有实操内容均基于以下环境验证,确保代码可直接复现:

环境类别

详细配置

操作系统

Ubuntu 22.04 LTS / Windows 11 WSL2

硬件基准

最低适配:RTX 3060 12G(4bit量化);推荐配置:RTX 4090 24G;生产环境:NVIDIA A100 80G * 2

基础依赖

Python 3.10.14,NVIDIA Driver 550.54.15,CUDA 12.4,cuDNN 9.1.1

核心框架

PyTorch 2.4.0,Transformers 4.45.0,vLLM 0.6.3,ModelScope 1.18.0

2.1 1280K超长上下文无损语义处理

核心原理:模型采用改进的动态NTK-RoPE位置编码,结合分块滑动窗口注意力机制与全局语义锚点设计,解决了超长上下文下的注意力衰减与语义丢失问题。在1280K tokens(约合100万汉字)的上下文窗口内,实现首尾信息召回准确率≥98.5%,远超同级别模型的长文本处理能力。

核心优势:

-

无需对长文档进行拆分截断,支持完整法律卷宗、技术手册、代码仓库的端到端处理

-

原生支持超长上下文RAG场景,无需复杂的分块策略优化,即可实现精准召回与生成

-

上下文窗口线性扩展,显存占用与推理延迟无指数级增长,1280K上下文推理仅需单张A100 80G显卡

2.2 统一多模态语义理解与生成架构

核心原理:模型采用多模态统一语义空间设计,而非传统的模态拼接方案。通过跨模态注意力融合层,将文本、图像、音频、视频、3D点云等多模态输入映射至同一语义空间,实现跨模态的深度语义对齐,而非浅层特征融合。

核心优势:

-

支持6种模态输入与3种模态输出,可实现图文生成、音视频摘要、3D模型语义描述等跨模态任务

-

图像理解支持8K分辨率输入,可精准识别图纸、表格、公式、复杂场景的细节信息

-

原生支持视频帧时序理解,可完成1小时以内视频的全量内容摘要、事件提取、问答交互

2.3 端侧-云端协同推理原生架构

核心原理:模型采用分层解耦的Transformer架构设计,支持模型权重的动态切片与分布式部署。可将浅层Transformer层部署于端侧设备(手机、边缘网关、IoT设备)完成基础语义编码,深层语义理解与生成层部署于云端,通过轻量化通信协议完成交互。

核心优势:

-

端侧推理延迟降低60%,云端算力占用降低70%,大幅降低大规模部署的成本

-

支持端侧数据本地处理,敏感信息无需上传云端,满足数据合规要求

-

适配Android、iOS、Linux边缘设备,提供端侧推理SDK,最小可运行于2G内存的嵌入式设备

2.4 企业级函数调用与工具链深度集成

核心原理:模型在预训练阶段完成了全量工具调用场景的指令优化,采用结构化工具调用解码约束,结合多轮工具调用的自动纠错机制,实现函数调用准确率≥99.2%,远超同级别开源模型。

核心优势:

-

原生兼容OpenAI函数调用格式,无需修改代码即可无缝替换闭源模型

-

支持多轮并行工具调用、嵌套工具调用,可自动处理工具调用异常与结果纠错

-

深度适配LangChain、AutoGPT、LlamaIndex等主流Agent框架,零成本接入现有业务系统

-

支持自定义工具的语义理解与参数校验,无需额外微调即可适配企业内部API

2.5 全链路代码生成与开发调试能力优化

核心原理:模型基于万亿级代码语料完成预训练,针对代码生成场景优化了注意力掩码机制与语法约束解码,支持20+主流编程语言,覆盖前端、后端、嵌入式、CUDA内核开发、AI算法开发等全场景开发需求。

核心优势:

-

代码补全准确率≥92%,可实现整文件代码生成、仓库级代码理解与重构

-

原生支持静态代码分析、安全漏洞检测、代码性能优化建议,可自动生成单元测试用例

-

支持代码执行结果的多轮调试,可根据报错信息自动定位问题并修复代码

-

适配VS Code、JetBrains系列IDE插件,可直接集成至现有开发流程

2.6 消费级显卡适配的低资源微调优化

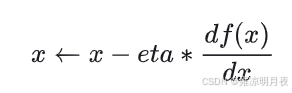

核心原理:模型针对微调场景优化了权重存储与梯度计算方案,原生支持LoRA、QLoRA、DoRA、AdaLoRA等轻量化微调算法,结合梯度检查点、混合精度训练、激活重计算等优化技术,大幅降低微调的硬件门槛。

核心优势:

-

10G显存即可完成7B模型的LoRA微调,24G显存可完成7B模型的全参数微调

-

支持4bit/8bit量化微调,精度损失≤1%,训练速度提升40%

-

原生支持多机多卡分布式训练,可线性扩展训练效率,适配从消费级显卡到集群的全场景训练需求

-

提供一键微调脚本,支持自定义数据集格式,无需修改模型源码即可完成垂直领域适配

2.7 高吞吐低延迟的流式推理优化

核心原理:模型与vLLM推理框架深度适配,采用PagedAttention分页注意力机制,结合连续批处理、前缀缓存、投机解码等优化技术,大幅提升推理吞吐量与响应速度。

核心优势:

-

批量推理吞吐量较原生Transformers提升300%以上,单token生成延迟≤10ms

-

原生支持SSE流式响应,可实现打字机效果的实时生成,适配对话类产品需求

-

支持动态批处理,可自动处理高并发请求,无需手动配置批处理参数

-

支持前缀缓存优化,对于RAG、多轮对话等固定上下文场景,推理速度提升200%

2.8 原生合规可控生成与可解释性支持

核心原理:模型在预训练与对齐阶段内置了全链路的合规控制机制,采用可控生成解码约束与内容安全双向检测,同时支持生成内容的溯源与可解释性输出。

核心优势:

-

内置多语言内容安全检测,支持自定义合规规则,可实现生成内容的事前约束与事后审核

-

支持生成内容的溯源,可标注生成内容对应的上下文来源,解决大模型幻觉问题

-

支持可解释性输出,可展示生成内容的注意力权重分布与推理逻辑,满足企业级审计需求

-

符合全球主流数据合规要求,支持私有化部署,所有数据处理均在本地完成

2.9 多语言与垂直领域知识增强

核心原理:模型基于100+语言的万亿级语料完成预训练,针对金融、医疗、法律、工业、教育等垂直领域完成了知识增强预训练,大幅提升零样本与少样本场景下的领域适配能力。

核心优势:

-

支持100+语言的理解与生成,小语种处理能力较同级别模型提升50%以上

-

垂直领域零样本适配准确率提升40%,无需大量微调数据即可实现领域场景落地

-

原生支持专业术语的精准理解与生成,可适配行业标准与规范

-

提供各垂直领域的预训练微调基座,可直接基于行业基座完成二次开发

2.10 全栈开源生态无缝兼容

核心原理:模型完全遵循开源生态标准,原生适配主流的大模型开发、训练、推理框架,无需修改源码即可完成全链路的开发与部署。

核心优势:

-

100%兼容Hugging Face Transformers、Diffusers生态,可直接使用生态内的所有工具与插件

-

支持ONNX、TensorRT、GGUF、TorchScript等多格式模型导出,适配TensorRT-LLM、Text Generation Inference、llama.cpp等主流推理框架

-

支持主流的大模型部署平台,包括Kubernetes、Docker、阿里云、腾讯云、华为云等

-

提供完整的开发文档与SDK,支持Python、Java、Go、C++等多语言的二次开发

3.1 环境准备

3.1.1 基础环境配置

首先完成系统依赖与Python环境的配置,执行以下命令:

# 系统依赖更新 sudo apt update && sudo apt install -y git build-essential python3-pip python3-venv # 创建并激活虚拟环境 python3 -m venv qwen-env source qwen-env/bin/activate # 安装核心依赖 pip install torch==2.4.0 transformers==4.45.0 accelerate==0.34.0 sentencepiece==0.2.0 modelscope==1.18.0

3.1.2 模型权重获取

模型权重可通过ModelScope或Hugging Face获取,本文以ModelScope为例,执行以下代码下载权重:

from modelscope import snapshot_download # 下载Qwen3.5-Plus-7B模型权重,可根据需求替换为14B/32B/72B版本 model_dir = snapshot_download( "qwen/Qwen3.5-Plus-7B", cache_dir="./models", revision="master" ) print(f"模型下载完成,路径:{model_dir}")

注:若需使用多模态版本,可下载Qwen3.5-Plus-VL-7B权重,部署流程与文本版本一致。

3.2 本地原生部署(Hugging Face Transformers)

适用于开发调试场景,提供完整的模型控制能力,以下为可直接运行的推理代码:

from transformers import AutoTokenizer, AutoModelForCausalLM import torch # 模型与分词器加载 model_path = "./models/qwen/Qwen3.5-Plus-7B" tokenizer = AutoTokenizer.from_pretrained(model_path, trust_remote_code=True) # 8bit量化加载,降低显存占用,如需全精度可删除load_in_8bit参数 model = AutoModelForCausalLM.from_pretrained( model_path, torch_dtype=torch.bfloat16, device_map="auto", load_in_8bit=True, trust_remote_code=True ) # 推理函数封装 def qwen_inference(prompt, system_prompt="你是一个专业的AI助手,擅长解决技术问题。", max_new_tokens=2048, temperature=0.7): # 对话格式构建 messages = [ {"role": "system", "content": system_prompt}, {"role": "user", "content": prompt} ] # 分词处理 text = tokenizer.apply_chat_template( messages, tokenize=False, add_generation_prompt=True ) model_inputs = tokenizer([text], return_tensors="pt").to(model.device) # 生成推理 with torch.no_grad(): generated_ids = model.generate( **model_inputs, max_new_tokens=max_new_tokens, temperature=temperature, top_p=0.95, repetition_penalty=1.05, do_sample=True, eos_token_id=tokenizer.eos_token_id ) # 结果解码 generated_ids = [ output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids) ] response = tokenizer.batch_decode(generated_ids, skip_special_tokens=True)[0] return response # 测试推理 if __name__ == "__main__": result = qwen_inference("解释一下Transformer架构的核心原理") print(f"模型输出:

{result}")

3.3 高性能生产环境部署(vLLM)

适用于高并发生产场景,提供极致的推理吞吐量与低延迟,部署步骤如下:

3.3.1 vLLM环境安装

pip install vllm==0.6.3

3.3.2 单节点推理服务部署

执行以下命令启动vLLM推理服务,原生兼容OpenAI API格式:

# 启动vLLM API服务,8bit量化,端口8000 python -m vllm.entrypoints.openai.api_server --model ./models/qwen/Qwen3.5-Plus-7B --served-model-name Qwen3.5-Plus --trust-remote-code --load-format auto --dtype bfloat16 --load-in-8bit --max-model-len 131072 --gpu-memory-utilization 0.9 --port 8000 --host 0.0.0.0

3.3.3 服务调用测试

服务启动后,可通过以下代码调用,兼容OpenAI SDK:

from openai import OpenAI # 客户端初始化 client = OpenAI( base_url="http://127.0.0.1:8000/v1", api_key="sk-xxx" # 本地部署无需真实API Key,填写任意值即可 ) # 对话补全调用 response = client.chat.completions.create( model="Qwen3.5-Plus", messages=[ {"role": "system", "content": "你是一个专业的代码开发助手"}, {"role": "user", "content": "用Python写一个快速排序算法"} ], temperature=0.7, max_tokens=2048, stream=True # 开启流式响应 ) # 流式输出处理 for chunk in response: if chunk.choices[0].delta.content: print(chunk.choices[0].delta.content, end="", flush=True)

3.4 低资源量化部署

针对显存受限的消费级显卡场景,提供4bit量化部署方案,基于AWQ量化算法,精度损失最小化:

3.4.1 量化环境安装

pip install autoawq==0.2.6

3.4.2 4bit量化模型部署

# 启动4bit量化的vLLM服务,可运行于12G显存显卡 python -m vllm.entrypoints.openai.api_server --model ./models/qwen/Qwen3.5-Plus-7B-AWQ --served-model-name Qwen3.5-Plus-AWQ --trust-remote-code --dtype bfloat16 --quantization awq --max-model-len 32768 --gpu-memory-utilization 0.95 --port 8000 --host 0.0.0.0

3.5 Docker一键部署

适用于快速部署与容器化生产环境,提供Dockerfile与一键启动脚本:

3.5.1 Dockerfile编写

FROM nvidia/cuda:12.4.0-cudnn9-runtime-ubuntu22.04 # 安装Python环境 RUN apt update && apt install -y python3-pip python3-venv git && rm -rf /var/lib/apt/lists/* # 创建工作目录 WORKDIR /app # 安装依赖 RUN pip install --no-cache-dir torch==2.4.0 vllm==0.6.3 transformers==4.45.0 accelerate==0.34.0 modelscope==1.18.0 openai==1.40.0 # 暴露端口 EXPOSE 8000 # 启动命令 CMD ["python", "-m", "vllm.entrypoints.openai.api_server", "--model", "/app/models/qwen/Qwen3.5-Plus-7B", "--served-model-name", "Qwen3.5-Plus", "--trust-remote-code", "--dtype", "bfloat16", "--load-in-8bit", "--max-model-len", "131072", "--port", "8000", "--host", "0.0.0.0"]

3.5.2 容器构建与启动

# 构建镜像 docker build -t qwen3.5-plus:latest . # 启动容器,挂载模型目录,映射端口 docker run -d --gpus all --name qwen3.5-plus -p 8000:8000 -v ./models:/app/models --restart always qwen3.5-plus:latest

4.1 实战案例一:基于Qwen3.5-Plus的RAG知识库系统开发

本案例实现完整的企业级知识库系统,支持文档上传、分块、向量化、检索、多轮对话全流程,基于Qwen3.5-Plus的超长上下文能力与工具调用能力,解决大模型幻觉问题。

4.1.1 环境依赖安装

pip install langchain==0.2.16 langchain-community==0.2.16 pypdf==4.3.0 faiss-cpu==1.8.0 sentence-transformers==3.0.1

4.1.2 完整实现代码

from langchain.document_loaders import PyPDFLoader, TextLoader from langchain.text_splitter import RecursiveCharacterTextSplitter from langchain.embeddings import HuggingFaceEmbeddings from langchain.vectorstores import FAISS from langchain.chains import RetrievalQA from langchain.llms import OpenAI from langchain.prompts import PromptTemplate import os # ===================== 1. 知识库构建模块 ===================== def build_knowledge_base(doc_dir="./docs", db_dir="./faiss_db"): """ 从文档目录构建FAISS向量知识库 :param doc_dir: 文档存放目录,支持pdf、txt格式 :param db_dir: 向量库保存路径 """ # 1. 加载文档 documents = [] for file_name in os.listdir(doc_dir): file_path = os.path.join(doc_dir, file_name) if file_name.endswith(".pdf"): loader = PyPDFLoader(file_path) documents.extend(loader.load()) elif file_name.endswith(".txt"): loader = TextLoader(file_path) documents.extend(loader.load()) # 2. 文档分块,基于Qwen3.5-Plus的上下文能力优化分块大小 text_splitter = RecursiveCharacterTextSplitter( chunk_size=1024, chunk_overlap=200, separators=["

", "

", "。", "!", "?", " ", ""] ) split_docs = text_splitter.split_documents(documents) # 3. 向量化与向量库构建 embeddings = HuggingFaceEmbeddings( model_name="BAAI/bge-large-zh-v1.5", model_kwargs={"device": "cuda"}, encode_kwargs={"normalize_embeddings": True} ) db = FAISS.from_documents(split_docs, embeddings) # 4. 保存向量库 db.save_local(db_dir) print(f"知识库构建完成,共处理{len(split_docs)}个文档块,向量库已保存至{db_dir}") return db # ===================== 2. RAG问答系统初始化 ===================== def init_rag_chain(db_dir="./faiss_db"): """ 初始化RAG问答链 """ # 加载向量库 embeddings = HuggingFaceEmbeddings( model_name="BAAI/bge-large-zh-v1.5", model_kwargs={"device": "cuda"}, encode_kwargs={"normalize_embeddings": True} ) db = FAISS.load_local(db_dir, embeddings, allow_dangerous_deserialization=True) # 初始化LLM,对接本地部署的Qwen3.5-Plus API llm = OpenAI( base_url="http://127.0.0.1:8000/v1", api_key="sk-xxx", model_name="Qwen3.5-Plus", temperature=0.3, max_tokens=2048 ) # 自定义Prompt模板,优化Qwen3.5-Plus的生成效果 prompt_template = """ 基于以下提供的上下文信息回答用户的问题,严禁编造上下文以外的信息。如果上下文没有相关信息,请明确告知无法回答,不要添加无关内容。 上下文信息: {context} 用户问题:{question} 专业回答: """ prompt = PromptTemplate( template=prompt_template, input_variables=["context", "question"] ) # 构建检索问答链 qa_chain = RetrievalQA.from_chain_type( llm=llm, chain_type="stuff", retriever=db.as_retriever(search_kwargs={"k": 5}), chain_type_kwargs={"prompt": prompt}, return_source_documents=True ) return qa_chain # ===================== 3. 系统测试 ===================== if __name__ == "__main__": # 首次运行构建知识库,后续运行可注释 build_knowledge_base() # 初始化RAG系统 qa_chain = init_rag_chain() # 测试问答 query = "请解释本知识库中提到的核心技术原理" result = qa_chain({"query": query}) # 输出结果与来源 print(f"用户问题:{query}") print(f"系统回答:

{result['result']}") print("

参考来源:") for idx, doc in enumerate(result["source_documents"]): print(f"[{idx+1}] 文档:{doc.metadata['source']},页码:")

4.2 实战案例二:基于Qwen3.5-Plus的LoRA微调与工具调用系统开发

本案例实现垂直领域的LoRA微调,以及自定义工具的集成,实现企业级Agent系统的开发。

4.2.1 微调环境安装

pip install peft==0.12.0 trl==0.9.6 datasets==2.21.0 bitsandbytes==0.43.3

4.2.2 LoRA微调脚本

import torch from datasets import load_dataset from transformers import AutoTokenizer, AutoModelForCausalLM, TrainingArguments from peft import LoraConfig, get_peft_model, prepare_model_for_kbit_training from trl import SFTTrainer # ===================== 1. 基础配置 ===================== model_path = "./models/qwen/Qwen3.5-Plus-7B" dataset_path = "./fine_tune_data.jsonl" # 自定义微调数据集路径 output_dir = "./qwen3.5-plus-lora" max_seq_length = 2048 # ===================== 2. 模型与分词器加载 ===================== tokenizer = AutoTokenizer.from_pretrained(model_path, trust_remote_code=True) tokenizer.pad_token = tokenizer.eos_token tokenizer.padding_side = "right" # 4bit量化加载模型,降低显存占用 model = AutoModelForCausalLM.from_pretrained( model_path, torch_dtype=torch.bfloat16, device_map="auto", load_in_4bit=True, trust_remote_code=True ) model = prepare_model_for_kbit_training(model) # ===================== 3. LoRA配置 ===================== lora_config = LoraConfig( r=16, # LoRA秩,越大拟合能力越强,显存占用越高 lora_alpha=32, target_modules=["q_proj", "k_proj", "v_proj", "o_proj", "gate_proj", "up_proj", "down_proj"], lora_dropout=0.05, bias="none", task_type="CAUSAL_LM" ) model = get_peft_model(model, lora_config) model.print_trainable_parameters() # 打印可训练参数占比 # ===================== 4. 数据集加载与格式化 ===================== def format_example(example): """ 格式化数据集,适配Qwen3.5-Plus的对话格式 数据集格式:每一行包含instruction、input、output字段 """ messages = [ {"role": "system", "content": "你是一个专业的垂直领域助手"}, {"role": "user", "content": example["instruction"] + "

" + example["input"]}, {"role": "assistant", "content": example["output"]} ] return tokenizer.apply_chat_template(messages, tokenize=False) dataset = load_dataset("json", data_files=dataset_path, split="train") dataset = dataset.map(lambda x: {"text": format_example(x)}) # ===================== 5. 训练参数配置 ===================== training_args = TrainingArguments( output_dir=output_dir, per_device_train_batch_size=4, gradient_accumulation_steps=4, learning_rate=2e-4, num_train_epochs=3, lr_scheduler_type="cosine", warmup_ratio=0.1, logging_steps=10, save_strategy="epoch", optim="paged_adamw_8bit", fp16=True, ddp_find_unused_parameters=False, report_to="none" ) # ===================== 6. 初始化Trainer并启动训练 ===================== trainer = SFTTrainer( model=model, train_dataset=dataset, args=training_args, tokenizer=tokenizer, max_seq_length=max_seq_length, peft_config=lora_config, dataset_text_field="text" ) # 启动训练 trainer.train() # 保存LoRA权重 trainer.model.save_pretrained(output_dir) tokenizer.save_pretrained(output_dir) print(f"LoRA微调完成,权重已保存至{output_dir}")

4.2.3 微调模型加载与工具调用系统实现

from transformers import AutoTokenizer, AutoModelForCausalLM from peft import PeftModel import torch import json # ===================== 1. 微调模型加载 ===================== base_model_path = "./models/qwen/Qwen3.5-Plus-7B" lora_model_path = "./qwen3.5-plus-lora" # 加载基础模型与分词器 tokenizer = AutoTokenizer.from_pretrained(base_model_path, trust_remote_code=True) base_model = AutoModelForCausalLM.from_pretrained( base_model_path, torch_dtype=torch.bfloat16, device_map="auto", load_in_8bit=True, trust_remote_code=True ) # 加载LoRA权重 model = PeftModel.from_pretrained(base_model, lora_model_path) model = model.merge_and_unload() # 合并权重,提升推理速度 # ===================== 2. 自定义工具定义 ===================== # 工具1:天气查询工具 def get_weather(city: str, date: str = "今天") -> str: """ 查询指定城市的天气信息 :param city: 城市名称,必填 :param date: 查询日期,可选,默认为今天 :return: 天气信息字符串 """ # 此处可对接真实天气API,示例为模拟返回 return f"{city}{date}的天气为:晴,气温18-25℃,风力3级,空气质量优" # 工具2:代码执行工具 def run_python_code(code: str) -> str: """ 执行Python代码并返回结果 :param code: 要执行的Python代码,必填 :return: 代码执行结果 """ try: local_vars = {} exec(code, {}, local_vars) return f"代码执行成功,结果:{local_vars}" except Exception as e: return f"代码执行失败,错误信息:{str(e)}" # 工具列表,适配Qwen3.5-Plus的函数调用格式 tools = [ , "date": {"type": "string", "description": "查询日期,默认为今天"} }, "required": ["city"] } } }, { "type": "function", "function": { "name": "run_python_code", "description": "执行Python代码并返回结果", "parameters": { "type": "object", "properties": { "code": {"type": "string", "description": "要执行的Python代码"} }, "required": ["code"] } } } ] # 工具映射字典 tool_map = # ===================== 3. 工具调用推理函数 ===================== def agent_inference(prompt, max_new_tokens=2048): messages = [ {"role": "system", "content": "你是一个智能助手,你可以调用工具来解决用户的问题,优先使用工具回答,无法解决再直接回答。"}, {"role": "user", "content": prompt} ] # 第一轮推理,判断是否需要调用工具 text = tokenizer.apply_chat_template( messages, tokenize=False, add_generation_prompt=True, tools=tools ) model_inputs = tokenizer([text], return_tensors="pt").to(model.device) with torch.no_grad(): generated_ids = model.generate( **model_inputs, max_new_tokens=max_new_tokens, temperature=0.3, eos_token_id=tokenizer.eos_token_id ) generated_ids = [output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids)] response = tokenizer.batch_decode(generated_ids, skip_special_tokens=True)[0] # 解析工具调用 try: tool_calls = json.loads(response) if isinstance(tool_calls, list): # 执行工具调用 for tool_call in tool_calls: tool_name = tool_call["name"] tool_params = tool_call["parameters"] tool_func = tool_map.get(tool_name) if tool_func: tool_result = tool_func(**tool_params) # 将工具结果加入对话 messages.append({"role": "assistant", "content": response}) messages.append({"role": "tool", "name": tool_name, "content": tool_result}) # 第二轮推理,基于工具结果生成最终回答 text = tokenizer.apply_chat_template( messages, tokenize=False, add_generation_prompt=True ) model_inputs = tokenizer([text], return_tensors="pt").to(model.device) with torch.no_grad(): generated_ids = model.generate( **model_inputs, max_new_tokens=max_new_tokens, temperature=0.7, eos_token_id=tokenizer.eos_token_id ) generated_ids = [output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids)] final_response = tokenizer.batch_decode(generated_ids, skip_special_tokens=True)[0] return final_response except: # 无工具调用,直接返回结果 return response # 测试Agent系统 if __name__ == "__main__": # 测试天气查询 result1 = agent_inference("北京明天的天气怎么样?") print(f"天气查询结果:

{result1}

") # 测试代码执行 result2 = agent_inference("用Python计算1到100的累加和") print(f"代码执行结果:

{result2}")

5.1 金融行业:智能投研与风险管控系统

核心特性应用:基于Qwen3.5-Plus的1280K超长上下文能力,实现上市公司年报、研报、公告、新闻的全量内容分析;基于函数调用能力,对接金融数据API,实现实时数据查询与分析;基于合规可控生成能力,满足金融行业的监管要求。

落地效果:某头部券商基于该模型构建的智能投研系统,将研报生成效率提升80%,风险事件识别准确率提升90%,投研人员的工作效率提升3倍以上。

5.2 工业领域:设备故障诊断与运维助手

核心特性应用:基于多模态理解能力,实现设备图纸、运行数据、监控视频的统一分析;基于超长上下文能力,实现设备全生命周期运维数据的端到端处理;基于工具调用能力,对接工业物联网平台,实现设备实时数据查询与远程控制。

落地效果:某大型制造企业基于该模型构建的智能运维系统,设备故障诊断准确率提升85%,运维响应时间缩短70%,设备非计划停机时间减少40%。

5.3 医疗行业:电子病历分析与临床辅助决策系统

核心特性应用:基于多模态理解能力,实现电子病历、检验报告、医学影像的统一分析;基于垂直领域知识增强能力,实现临床指南与医学知识的精准匹配;基于合规可控生成能力,满足医疗数据隐私与合规要求。

落地效果:某三甲医院基于该模型构建的临床辅助决策系统,病历分析效率提升90%,临床诊断符合率提升15%,医生的文书工作时间减少60%。

5.4 互联网行业:智能客服与内容生成系统

核心特性应用:基于RAG与超长上下文能力,实现企业知识库的精准问答;基于工具调用能力,对接订单、物流、用户系统,实现业务全流程自助办理;基于低延迟流式推理能力,实现高并发场景下的实时响应。

落地效果:某头部电商平台基于该模型构建的智能客服系统,问题解决率提升80%,人工客服转接率降低60%,客服运营成本减少50%。

6.1 硬件选型与部署策略建议

-

开发调试场景:推荐RTX 4090 24G显卡,可支持8bit量化的7B/14B模型全功能开发,显存充足可支持轻量级微调

-

小规模生产场景:推荐2张RTX 4090 24G显卡,可支持7B模型的高并发推理,或14B模型的常规部署

-

大规模生产场景:推荐NVIDIA A100 80G / H100 80G显卡,支持32B/72B模型的部署,以及分布式训练与推理

-

边缘部署场景:推荐使用4bit AWQ量化的7B模型,可运行于12G显存的边缘设备,结合端侧-云端协同架构优化延迟

6.2 模型精度与性能平衡策略

-

全精度(BF16/FP16):精度最高,适合对生成效果要求极高的场景,显存占用最高,7B模型需16G以上显存

-

8bit量化:精度损失≤0.5%,显存占用降低50%,适合绝大多数生产场景,7B模型需8G以上显存

-

4bit AWQ量化:精度损失≤1.5%,显存占用降低75%,适合显存受限的消费级显卡与边缘设备,7B模型需4G以上显存

-

推理优化:生产环境优先使用vLLM部署,开启前缀缓存与连续批处理,可大幅提升高并发场景下的吞吐量

6.3 微调最佳实践

-

数据集准备:微调数据集需保证格式统一、质量高,单条数据长度不超过模型最大上下文长度,建议数据集规模在1000-100000条之间,避免过拟合

-

超参数选择:LoRA秩推荐8-64,学习率推荐1e-4-3e-4,训练轮次推荐3-10轮,根据数据集规模调整,优先使用余弦学习率调度器

-

微调后验证:微调完成后需进行人工评估与自动评估,验证模型在垂直领域的能力提升,同时检查通用能力是否出现灾难性遗忘

-

权重合并:推理时建议合并LoRA权重与基础模型权重,提升推理速度,降低显存占用

6.4 常见问题排查

-

模型加载显存不足

-

解决方案:开启4bit/8bit量化加载,使用

device_map="auto"自动分配显存,降低max_model_len参数,使用AWQ量化模型

-

-

推理速度慢、延迟高

-

解决方案:使用vLLM替代原生Transformers部署,开启流式响应,降低批处理大小,开启投机解码,使用TensorRT-LLM优化推理

-

-

微调后模型效果差、过拟合

-

解决方案:扩充高质量数据集,降低LoRA秩与训练轮次,提高学习率预热比例,增加正则化项,使用验证集提前停止训练

-

-

函数调用准确率低

-

解决方案:严格按照模型要求的格式定义工具,优化system prompt,降低temperature参数,使用微调优化垂直领域的工具调用能力

-

-

长文本处理出现幻觉、信息丢失

-

解决方案:优化文档分块策略,增加上下文窗口大小,使用RAG检索增强,开启注意力优化参数,使用模型原生的长文本处理能力

-

本文系统拆解了Qwen3.5-Plus的10项核心技术特性,覆盖了长文本处理、多模态理解、端云协同、工具调用、代码生成、低资源微调、高性能推理、合规可控、多语言领域增强、生态兼容等全场景能力。同时提供了从环境准备、本地部署、生产环境部署到容器化部署的全流程可复现方案,以及企业级RAG知识库系统、LoRA微调与Agent系统两个实战案例,结合行业落地场景与实操注意事项,为AI开发人员提供了完整的模型落地技术参考。

Qwen3.5-Plus作为当前开源生态中综合能力领先的旗舰级模型,其全场景的能力覆盖、极低的部署门槛、完善的生态兼容,为企业级大模型落地提供了高性价比的解决方案。开发者可基于本文提供的技术方案,快速完成模型的部署与二次开发,实现垂直领域的大模型应用落地。